OPV: Outcome-based Process Verifier for Efficient Long Chain-of-Thought Verification

作者: Zijian Wu, Lingkai Kong, Wenwei Zhang, Songyang Gao, Yuzhe Gu, Zhongrui Cai, Tianyou Ma, Yuhong Liu, Zhi Wang, Runyuan Ma, Guangyu Wang, Wei Li, Conghui He, Dahua Lin, Kai Chen

分类: cs.CL, cs.LG

发布日期: 2025-12-11

💡 一句话要点

提出基于结果的过程验证器OPV,用于高效验证长链思维推理过程

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 长链思维 推理验证 主动学习 强化学习 拒绝微调 大型语言模型 过程验证 结果验证

📋 核心要点

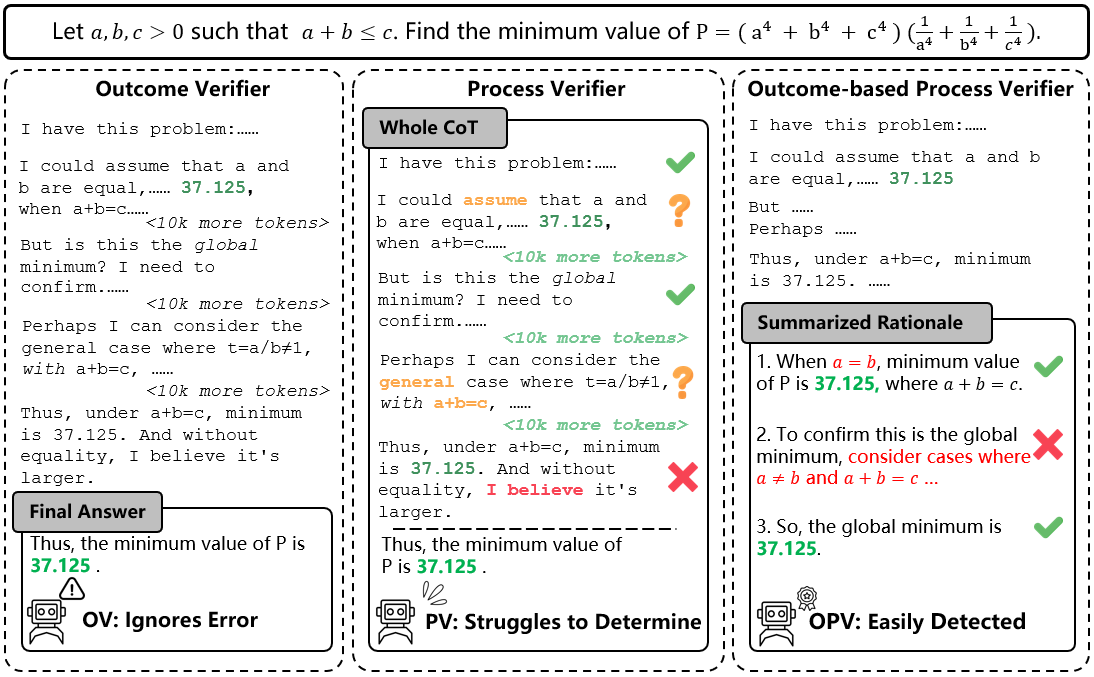

- 现有基于结果的验证器无法有效检查长链推理中不可靠的中间步骤,而基于过程的验证器受限于标注成本,难以处理复杂推理。

- OPV通过验证长链思维总结结果的推理过程,实现准确高效的验证,并采用迭代主动学习框架降低标注成本。

- 实验表明,OPV在OPV-Bench上取得了新的SOTA结果,并能有效检测假阳性,与策略模型结合使用时,性能得到显著提升。

📝 摘要(中文)

大型语言模型(LLMs)通过可验证奖励的强化学习(RLVR)在解决复杂推理任务方面取得了显著进展。这种进步也离不开可靠验证器的自动监督。然而,当前基于结果的验证器(OVs)无法检查长链思维(CoTs)中不可靠的中间步骤。同时,当前基于过程的验证器(PVs)难以可靠地检测复杂长CoTs中的错误,这受限于高质量标注的稀缺性,因为人工标注的成本过高。因此,我们提出了基于结果的过程验证器(OPV),它验证来自长CoTs的总结结果的推理过程,以实现准确和高效的验证,并支持大规模标注。为了增强所提出的验证器,我们采用了一种迭代主动学习框架,通过专家标注逐步提高OPV的验证能力,同时降低标注成本。具体来说,在每次迭代中,标注当前最佳OPV中最不确定的案例,然后将其用于通过拒绝微调(RFT)和RLVR训练新的OPV,以进行下一轮迭代。大量实验表明了OPV的卓越性能和广泛适用性。它在我们的保留OPV-Bench上取得了新的最先进的结果,优于更大的开源模型,例如Qwen3-Max-Preview,F1得分为83.1,而Qwen3-Max-Preview为76.3。此外,OPV有效地检测了合成数据集中的假阳性,与专家评估非常吻合。当与策略模型协作时,OPV始终产生性能提升,例如,在AIME2025上,随着计算预算的增加,DeepSeek-R1-Distill-Qwen-32B的准确率从55.2%提高到73.3%。

🔬 方法详解

问题定义:论文旨在解决长链思维推理过程中,现有验证器无法有效且经济地验证推理过程的正确性问题。基于结果的验证器(OVs)忽略了中间步骤的可靠性,而基于过程的验证器(PVs)需要大量高质量标注,成本高昂。

核心思路:论文的核心思路是结合基于结果和基于过程的验证方法的优点,提出Outcome-based Process Verifier (OPV)。OPV验证从长链思维中总结出的结果的推理过程,从而在保证验证准确性的同时,降低标注成本。通过迭代主动学习,逐步提升OPV的验证能力。

技术框架:OPV的整体框架包含以下几个主要阶段:1) 使用大型语言模型生成长链思维推理过程;2) 从长链思维中总结出结果;3) 使用OPV验证总结结果的推理过程;4) 使用迭代主动学习框架,选择最不确定的案例进行专家标注;5) 使用标注数据通过拒绝微调(RFT)和RLVR训练新的OPV。

关键创新:OPV的关键创新在于:1) 结合了基于结果和基于过程的验证方法,实现了准确和高效的验证;2) 提出了迭代主动学习框架,通过专家标注逐步提高OPV的验证能力,同时降低标注成本;3) 采用了拒绝微调(RFT)和RLVR技术,进一步提升了OPV的性能。

关键设计:OPV的关键设计包括:1) 如何从长链思维中总结出结果,需要设计合适的prompt和模型;2) 如何选择最不确定的案例进行专家标注,需要设计合适的选择策略;3) 如何使用拒绝微调(RFT)和RLVR技术训练OPV,需要设计合适的损失函数和奖励函数。

🖼️ 关键图片

📊 实验亮点

OPV在OPV-Bench上取得了新的SOTA结果,F1得分为83.1,优于Qwen3-Max-Preview(76.3)。OPV能够有效检测合成数据集中的假阳性,与专家评估结果高度一致。与策略模型DeepSeek-R1-Distill-Qwen-32B结合使用时,在AIME2025数据集上,准确率从55.2%提升至73.3%。

🎯 应用场景

OPV可应用于各种需要长链思维推理的场景,例如数学问题求解、代码生成、知识图谱推理等。通过提供可靠的验证,OPV可以提高LLM在这些任务中的性能,并降低人工干预的需求。此外,OPV还可以用于构建更安全、更可靠的AI系统。

📄 摘要(原文)

Large language models (LLMs) have achieved significant progress in solving complex reasoning tasks by Reinforcement Learning with Verifiable Rewards (RLVR). This advancement is also inseparable from the oversight automated by reliable verifiers. However, current outcome-based verifiers (OVs) are unable to inspect the unreliable intermediate steps in the long reasoning chains of thought (CoTs). Meanwhile, current process-based verifiers (PVs) have difficulties in reliably detecting errors in the complex long CoTs, limited by the scarcity of high-quality annotations due to the prohibitive costs of human annotations. Therefore, we propose the Outcome-based Process Verifier (OPV), which verifies the rationale process of summarized outcomes from long CoTs to achieve both accurate and efficient verification and enable large-scale annotation. To empower the proposed verifier, we adopt an iterative active learning framework with expert annotations to progressively improve the verification capability of OPV with fewer annotation costs. Specifically, in each iteration, the most uncertain cases of the current best OPV are annotated and then subsequently used to train a new OPV through Rejection Fine-Tuning (RFT) and RLVR for the next round. Extensive experiments demonstrate OPV's superior performance and broad applicability. It achieves new state-of-the-art results on our held-out OPV-Bench, outperforming much larger open-source models such as Qwen3-Max-Preview with an F1 score of 83.1 compared to 76.3. Furthermore, OPV effectively detects false positives within synthetic dataset, closely align with expert assessment. When collaborating with policy models, OPV consistently yields performance gains, e.g., raising the accuracy of DeepSeek-R1-Distill-Qwen-32B from 55.2% to 73.3% on AIME2025 as the compute budget scales.