PARAN: Persona-Augmented Review ANswering system on Food Delivery Review Dataset

作者: Moonsoo Park, Jeongseok Yun, Bohyung Kim

分类: cs.CL, cs.AI

发布日期: 2025-12-10

💡 一句话要点

提出PARAN:一种在食品配送评论数据集上基于用户画像增强的评论回复系统

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 个性化回复生成 用户画像 提示学习 大型语言模型 食品配送评论 自然语言处理 两阶段框架

📋 核心要点

- 现有方法在用户数据稀缺的场景下,难以生成个性化的评论回复,导致用户参与度降低。

- 论文提出一种两阶段提示框架,通过从评论文本中推断用户画像,增强LLM生成个性化回复的能力。

- 实验结果表明,该方法在精度、多样性和语义一致性方面均有提升,且无需模型微调。

📝 摘要(中文)

个性化评论回复生成在用户数据有限的领域(如食品配送平台)中面临巨大挑战。大型语言模型(LLM)虽然拥有强大的文本生成能力,但当缺乏上下文用户数据时,往往会产生通用回复,降低用户参与度和有效性。本文提出了一种两阶段提示框架,直接从简短的评论文本中推断显式(例如,用户声明的偏好)和隐式(例如,人口统计或风格线索)用户画像属性。然后,将这些推断出的用户画像属性整合到回复生成提示中,以生成用户定制的回复。为了鼓励多样化且忠实的生成,我们在推理过程中调整解码温度。我们使用从韩国食品配送应用程序收集的真实数据集评估了我们的方法,并评估了其对精度、多样性和语义一致性的影响。研究结果突出了用户画像增强提示在增强自动回复的相关性和个性化方面的有效性,而无需模型微调。

🔬 方法详解

问题定义:论文旨在解决食品配送平台等用户数据有限场景下,自动生成个性化评论回复的问题。现有方法,特别是直接使用大型语言模型(LLM),在缺乏用户上下文信息时,往往生成通用、缺乏针对性的回复,无法有效提升用户参与度。因此,如何利用有限的评论文本,挖掘用户偏好和特征,生成更具个性化的回复,是本研究要解决的核心问题。

核心思路:论文的核心思路是通过从评论文本中推断用户的显式和隐式画像信息,并将这些画像信息融入到LLM的提示(Prompt)中,从而引导LLM生成更符合用户偏好和需求的个性化回复。这种方法的核心在于利用用户画像作为桥梁,连接有限的评论文本和LLM的强大生成能力。

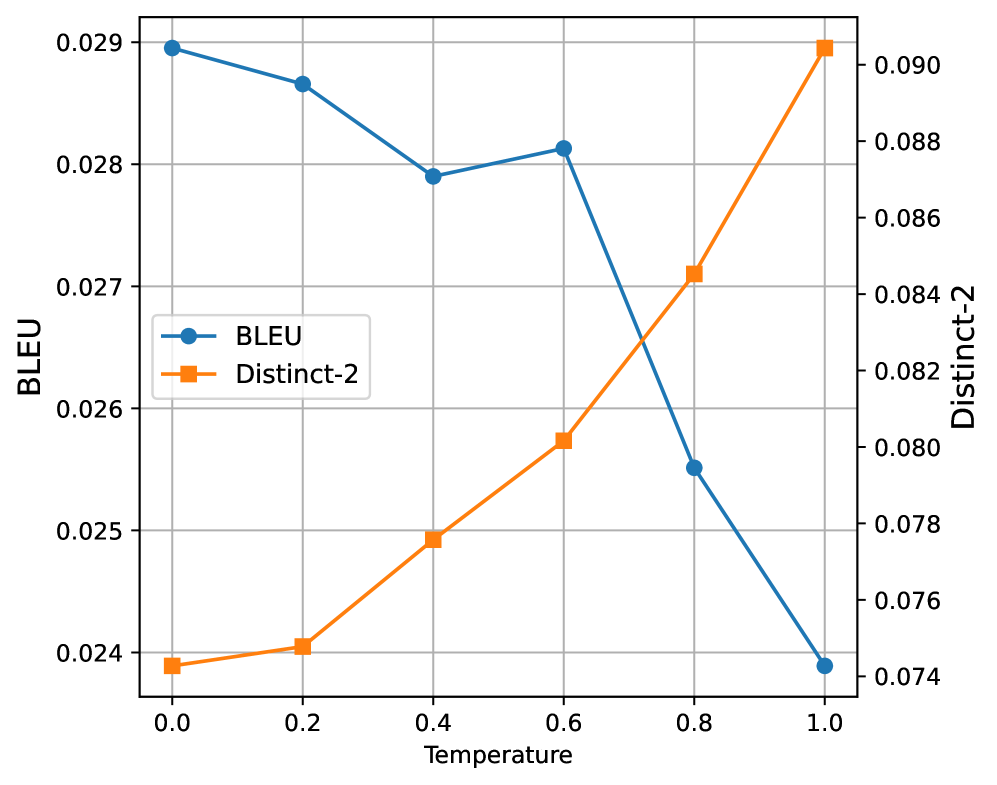

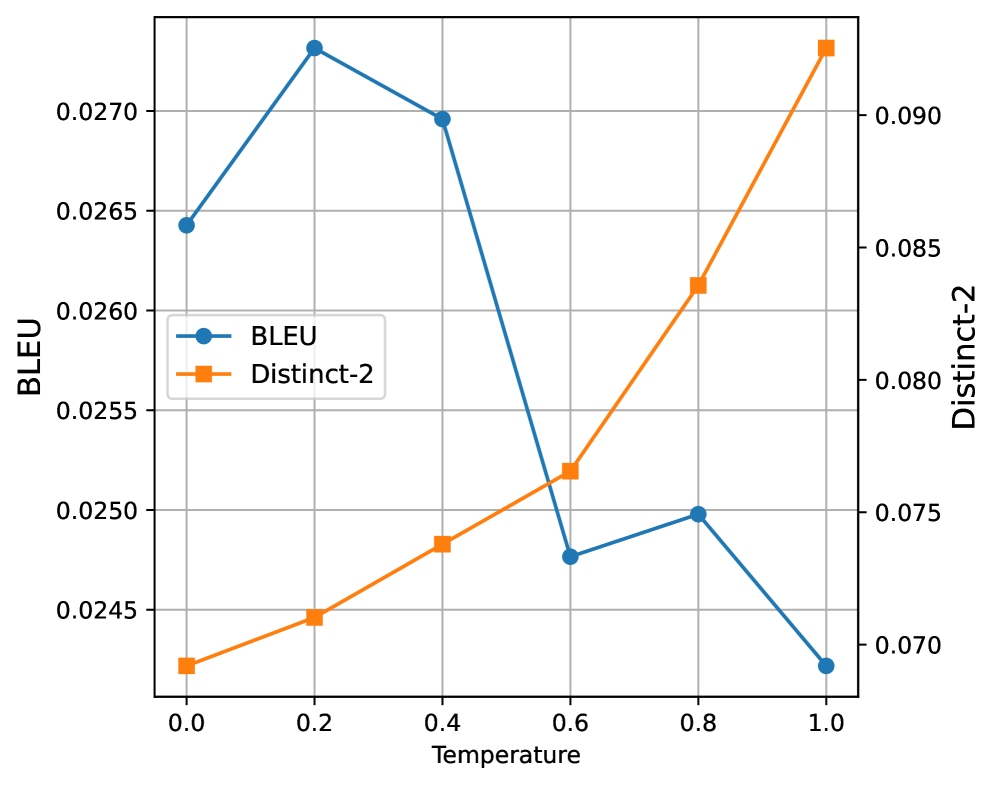

技术框架:该方法采用两阶段提示框架:第一阶段是用户画像推断阶段,该阶段从评论文本中提取显式(如用户明确表达的偏好)和隐式(如人口统计学特征或写作风格)的用户画像属性。第二阶段是回复生成阶段,该阶段将推断出的用户画像属性整合到LLM的提示中,引导LLM生成个性化的回复。此外,为了鼓励生成更多样化的回复,该方法在推理过程中调整了LLM的解码温度。

关键创新:该方法最重要的技术创新点在于提出了用户画像增强的提示框架,该框架能够有效地利用有限的评论文本,推断用户的个性化特征,并将其融入到LLM的提示中,从而生成更具个性化和相关性的回复。与直接使用LLM生成回复的方法相比,该方法能够更好地捕捉用户的偏好和需求,从而提升回复的质量和用户满意度。

关键设计:在用户画像推断阶段,具体如何提取显式和隐式用户画像属性,论文中可能使用了特定的自然语言处理技术或模型。在回复生成阶段,如何将用户画像属性有效地融入到LLM的提示中,可能涉及到特定的提示工程技巧。此外,解码温度的调整策略也是一个关键设计,需要在多样性和语义一致性之间进行权衡。具体的技术细节需要参考论文原文。

🖼️ 关键图片

📊 实验亮点

论文使用从韩国食品配送应用程序收集的真实数据集进行了评估,实验结果表明,该方法在精度、多样性和语义一致性方面均有显著提升。具体性能数据(如精度提升百分比、多样性指标数值等)需要参考论文原文。重要的是,该方法无需对LLM进行微调,即可实现个性化回复生成,降低了应用成本。

🎯 应用场景

该研究成果可广泛应用于各种需要自动生成个性化回复的场景,例如电商平台的商品评论回复、在线客服系统、社交媒体互动等。通过自动生成更具个性化和相关性的回复,可以有效提升用户参与度、满意度和忠诚度,从而为企业带来更大的商业价值。未来,该技术还可以与其他自然语言处理技术相结合,实现更智能化的用户交互。

📄 摘要(原文)

Personalized review response generation presents a significant challenge in domains where user information is limited, such as food delivery platforms. While large language models (LLMs) offer powerful text generation capabilities, they often produce generic responses when lacking contextual user data, reducing engagement and effectiveness. In this work, we propose a two-stage prompting framework that infers both explicit (e.g., user-stated preferences) and implicit (e.g., demographic or stylistic cues) personas directly from short review texts. These inferred persona attributes are then incorporated into the response generation prompt to produce user-tailored replies. To encourage diverse yet faithful generations, we adjust decoding temperature during inference. We evaluate our method using a real-world dataset collected from a Korean food delivery app, and assess its impact on precision, diversity, and semantic consistency. Our findings highlight the effectiveness of persona-augmented prompting in enhancing the relevance and personalization of automated responses without requiring model fine-tuning.