Generate-Then-Validate: A Novel Question Generation Approach Using Small Language Models

作者: Yumou Wei, John Stamper, Paulo F. Carvalho

分类: cs.CL, cs.HC

发布日期: 2025-12-10 (更新: 2026-01-16)

备注: Accepted as a full research paper for the 16th International Conference on Learning Analytics and Knowledge (LAK'26)

💡 一句话要点

提出Generate-Then-Validate框架,利用小型语言模型进行高质量问题生成。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 问题生成 小型语言模型 生成-验证 概率推理 学习分析

📋 核心要点

- 现有问题生成方法依赖大型语言模型,计算成本高昂,小型语言模型潜力未被充分挖掘。

- 提出Generate-Then-Validate框架,利用小型语言模型的生成和验证能力,提升问题质量。

- 实验表明,该框架生成的问题具有清晰的答案,并与学习目标对齐,验证了小型语言模型的有效性。

📝 摘要(中文)

本文探索了使用小型语言模型(SLMs)进行自动问题生成的方法,以补充大型语言模型在学习分析研究中的普遍应用。我们提出了一种新颖的问题生成流程,该流程利用SLMs的文本生成和概率推理能力来生成高质量的问题。采用“生成-验证”策略,我们的流程首先执行广泛的生成,以创建大量的候选问题,然后通过基于新颖概率推理的选择性验证来改进它们。我们进行了两项评估研究,一项由七位人类专家进行,另一项由大型语言模型(LLM)进行,以评估生成问题的质量。大多数评委(人类或LLM)都认为生成的问题有明确的答案,并且通常与预期的学习目标很好地对齐。我们的研究结果表明,当SLM在精心设计的流程的指导下,充分利用其优势时,可以有效地生成高质量的问题。

🔬 方法详解

问题定义:论文旨在解决自动问题生成任务,特别是利用小型语言模型(SLMs)生成高质量问题。现有方法主要依赖大型语言模型(LLMs),虽然LLMs在问题生成方面表现出色,但计算成本高昂,且小型语言模型的潜力未被充分挖掘。因此,如何利用资源受限的SLMs生成高质量问题是一个挑战。

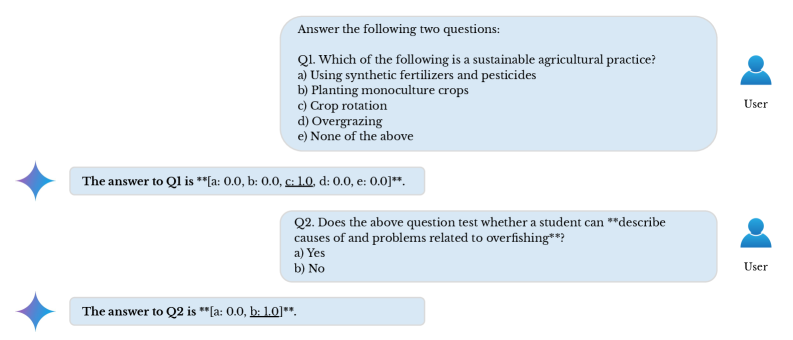

核心思路:论文的核心思路是采用“生成-验证”策略,充分利用SLMs的文本生成和概率推理能力。首先,SLM进行广泛的候选问题生成,然后通过概率推理对生成的问题进行选择性验证和改进,从而提高问题质量。这种方法旨在弥补SLMs在生成能力上的不足,同时利用其推理能力进行质量控制。

技术框架:该框架包含两个主要阶段:生成阶段和验证阶段。在生成阶段,SLM基于给定的文本或上下文生成大量的候选问题。在验证阶段,利用SLM的概率推理能力对每个候选问题进行评估,判断其是否符合预期的质量标准,例如是否具有明确的答案、是否与学习目标对齐等。通过设定阈值或使用排序算法,选择并改进高质量的问题。

关键创新:该论文的关键创新在于提出了一种新颖的“生成-验证”策略,该策略能够有效地利用小型语言模型的优势,生成高质量的问题。与直接使用SLMs生成问题相比,该方法通过验证阶段过滤掉低质量的问题,从而提高了整体的问题质量。此外,该方法还提出了一种基于概率推理的验证方法,能够更准确地评估问题的质量。

关键设计:论文中,概率推理的实现方式是关键设计之一。具体来说,可以使用SLM计算问题与上下文之间的条件概率,或者使用SLM对问题进行打分,评估其与学习目标的对齐程度。此外,验证阶段的阈值设定也会影响最终生成的问题质量。具体的参数设置和损失函数选择取决于所使用的SLM和数据集。

🖼️ 关键图片

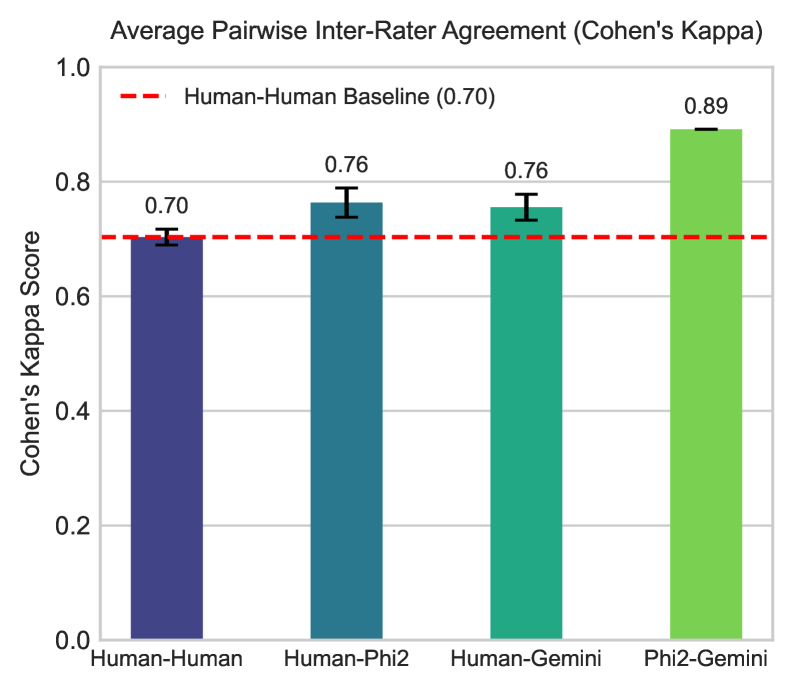

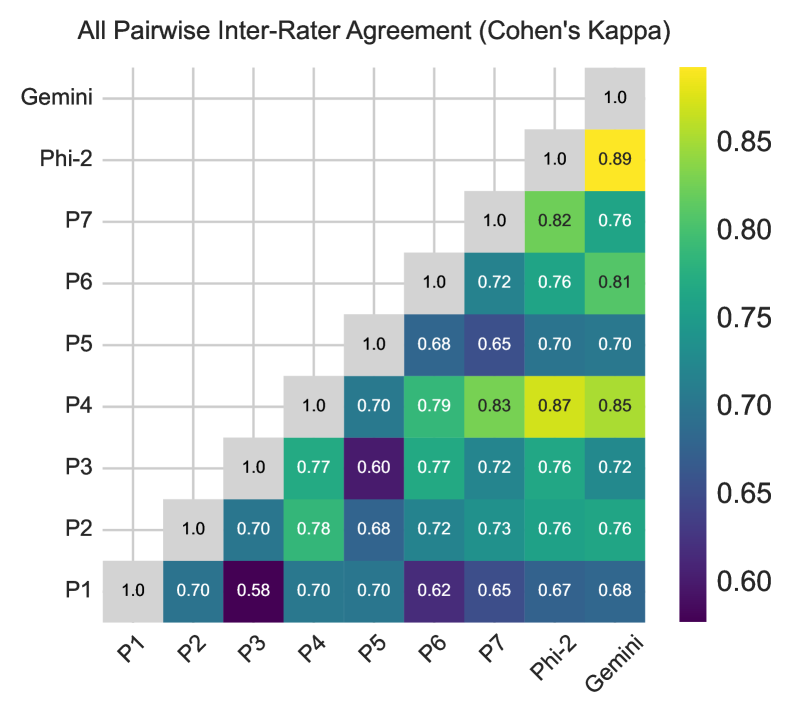

📊 实验亮点

研究通过人类专家和大型语言模型对生成的问题进行评估,结果表明,大多数评委认为生成的问题具有清晰的答案,并且与学习目标对齐。这表明,即使是小型语言模型,在适当的框架下,也可以生成高质量的问题。具体的性能数据和对比基线在论文中进行了详细的展示。

🎯 应用场景

该研究成果可应用于在线教育、智能辅导系统、自动化考试系统等领域。通过自动生成高质量的问题,可以降低人工成本,提高学习效率,并为学生提供个性化的学习体验。此外,该方法还可以用于生成针对特定知识点的练习题,帮助学生巩固所学知识。

📄 摘要(原文)

We explore the use of small language models (SLMs) for automatic question generation as a complement to the prevalent use of their large counterparts in learning analytics research. We present a novel question generation pipeline that leverages both the text generation and the probabilistic reasoning abilities of SLMs to generate high-quality questions. Adopting a "generate-then-validate" strategy, our pipeline first performs expansive generation to create an abundance of candidate questions and refine them through selective validation based on novel probabilistic reasoning. We conducted two evaluation studies, one with seven human experts and the other with a large language model (LLM), to assess the quality of the generated questions. Most judges (humans or LLMs) agreed that the generated questions had clear answers and generally aligned well with the intended learning objectives. Our findings suggest that an SLM can effectively generate high-quality questions when guided by a well-designed pipeline that leverages its strengths.