Systematic Framework of Application Methods for Large Language Models in Language Sciences

作者: Kun Sun, Rong Wang

分类: cs.CL

发布日期: 2025-12-10

💡 一句话要点

提出LLM在语言科学中应用的系统性框架,提升研究可复现性和可靠性。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 语言科学 方法论框架 提示工程 微调 嵌入提取 研究范式

📋 核心要点

- 现有LLM在语言科学应用中存在方法碎片化和缺乏系统性,阻碍了研究的可靠性和可复现性。

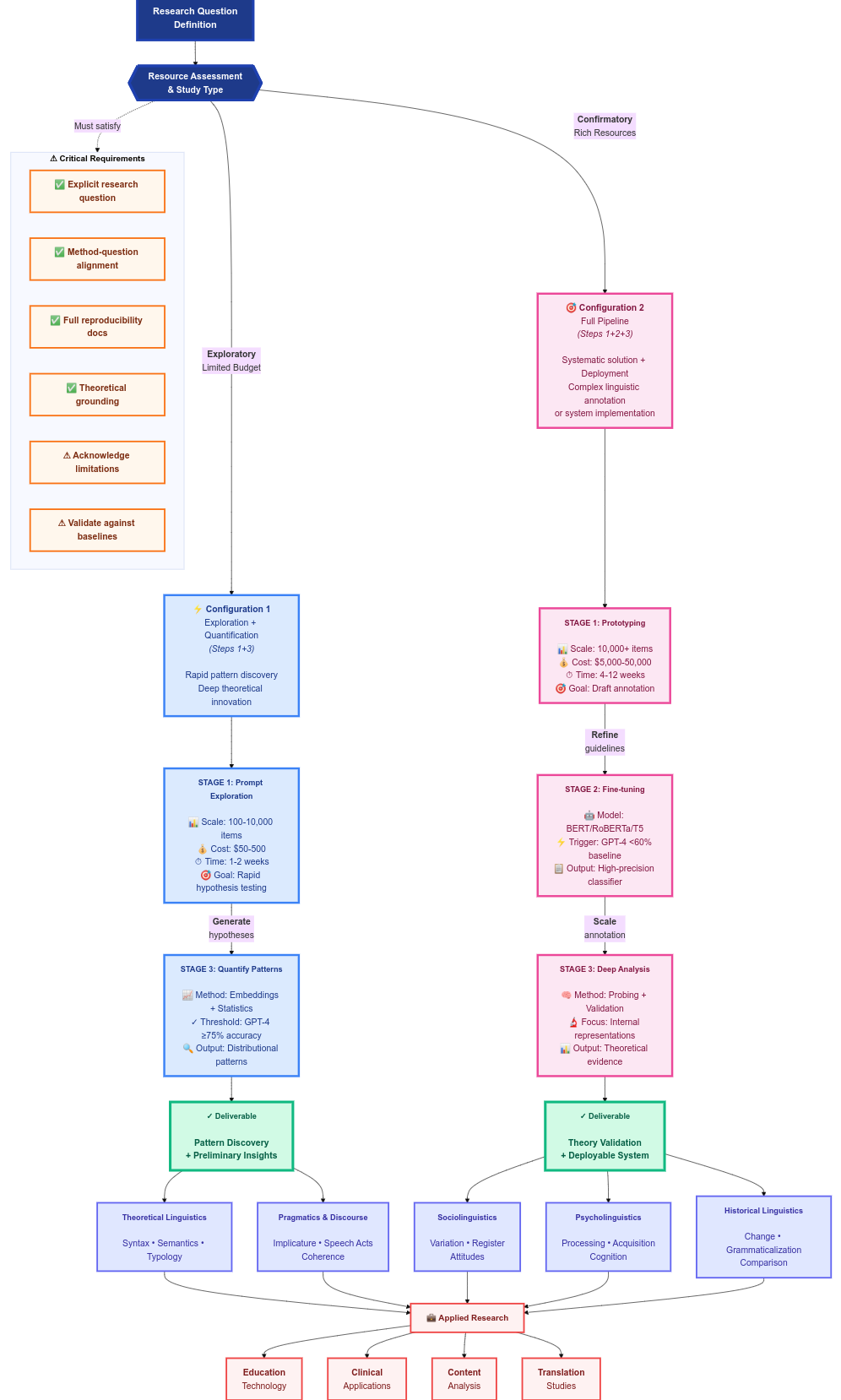

- 论文提出方法选择框架和系统框架,指导LLM在语言科学中的战略性应用,确保研究问题与合适方法对齐。

- 通过回顾性分析、前瞻性应用和专家评估,验证了框架的有效性,提升了研究范式的严谨性。

📝 摘要(中文)

大型语言模型(LLM)正在变革语言科学。然而,目前LLM的广泛应用面临方法论碎片化和缺乏系统性健全性的问题。本研究提出了两个全面的方法论框架,旨在指导LLM在语言科学中的战略性和负责任的应用。第一个方法选择框架定义并系统化了三种不同的、互补的方法,每种方法都与特定的研究目标相关联:(1)与通用模型进行基于提示的交互,用于探索性分析和假设生成;(2)微调开源模型,用于验证性的、理论驱动的研究和高质量的数据生成;(3)提取上下文嵌入,用于进一步的定量分析和模型内部机制的探测。我们详细介绍了每种方法的技术实现和固有的权衡,并辅以实证案例研究。基于方法选择框架,提出的第二个系统框架提供了构建的配置,指导基于这些方法的多阶段研究流程的实际实施。然后,我们进行了一系列实证实验来验证我们提出的框架,采用回顾性分析、前瞻性应用和专家评估调查。通过强制研究问题与适当的LLM方法论的战略对齐,这些框架实现了语言科学研究中的关键范式转变。我们认为该系统对于确保可重复性、促进LLM机制的批判性评估以及提供必要的结构以将传统语言学从临时效用转变为可验证的、稳健的科学至关重要。

🔬 方法详解

问题定义:现有方法在语言科学领域应用LLM时,缺乏统一的方法论指导,导致研究结果难以复现和验证。不同的研究目标需要不同的LLM应用策略,但现有研究往往缺乏对这些策略的系统性区分和选择依据。这阻碍了LLM在语言科学领域的深入应用和理论发展。

核心思路:论文的核心思路是构建一个系统性的框架,将语言科学的研究目标与合适的LLM应用方法联系起来。通过定义不同的研究目标(如探索性分析、验证性研究、机制探测),并为每个目标提供相应的LLM应用策略(如prompt-based interaction, fine-tuning, embedding extraction),从而指导研究者选择最合适的方法。

技术框架:该框架包含两个主要部分:方法选择框架和系统框架。方法选择框架定义了三种LLM应用方法:1) prompt-based interaction,用于探索性分析和假设生成;2) fine-tuning,用于验证性研究和高质量数据生成;3) embedding extraction,用于定量分析和模型内部机制探测。系统框架则指导如何将这些方法组合成多阶段的研究流程。研究者首先根据研究目标选择合适的方法,然后按照系统框架的指导进行实验设计和数据分析。

关键创新:该论文的关键创新在于提出了一个系统性的框架,将LLM应用方法与语言科学的研究目标联系起来。这使得研究者能够更加有针对性地选择和应用LLM,从而提高研究的效率和可靠性。此外,该框架还强调了不同方法之间的权衡,帮助研究者更好地理解每种方法的优缺点。

关键设计:论文的关键设计在于对三种LLM应用方法的明确定义和区分,以及对每种方法的技术实现和权衡的详细描述。例如,对于prompt-based interaction,论文强调了prompt的设计和选择的重要性;对于fine-tuning,论文讨论了数据集的选择和模型结构的调整;对于embedding extraction,论文介绍了不同的embedding提取方法和分析技术。此外,论文还通过案例研究展示了如何将这些方法应用于具体的语言科学问题。

🖼️ 关键图片

📊 实验亮点

论文通过回顾性分析、前瞻性应用和专家评估验证了所提出框架的有效性。专家评估表明,该框架能够显著提高LLM在语言科学研究中的应用效率和可靠性。具体性能数据未知,但实验结果表明该框架能够指导研究者选择更合适的LLM应用方法。

🎯 应用场景

该研究成果可广泛应用于语言学、心理语言学、计算语言学等领域。通过该框架,研究者可以更有效地利用LLM进行语言现象的探索、理论验证和模型机制的理解。该框架有助于推动语言科学研究的规范化和可重复性,促进该领域的发展。

📄 摘要(原文)

Large Language Models (LLMs) are transforming language sciences. However, their widespread deployment currently suffers from methodological fragmentation and a lack of systematic soundness. This study proposes two comprehensive methodological frameworks designed to guide the strategic and responsible application of LLMs in language sciences. The first method-selection framework defines and systematizes three distinct, complementary approaches, each linked to a specific research goal: (1) prompt-based interaction with general-use models for exploratory analysis and hypothesis generation; (2) fine-tuning of open-source models for confirmatory, theory-driven investigation and high-quality data generation; and (3) extraction of contextualized embeddings for further quantitative analysis and probing of model internal mechanisms. We detail the technical implementation and inherent trade-offs of each method, supported by empirical case studies. Based on the method-selection framework, the second systematic framework proposed provides constructed configurations that guide the practical implementation of multi-stage research pipelines based on these approaches. We then conducted a series of empirical experiments to validate our proposed framework, employing retrospective analysis, prospective application, and an expert evaluation survey. By enforcing the strategic alignment of research questions with the appropriate LLM methodology, the frameworks enable a critical paradigm shift in language science research. We believe that this system is fundamental for ensuring reproducibility, facilitating the critical evaluation of LLM mechanisms, and providing the structure necessary to move traditional linguistics from ad-hoc utility to verifiable, robust science.