Toward Faithful Retrieval-Augmented Generation with Sparse Autoencoders

作者: Guangzhi Xiong, Zhenghao He, Bohan Liu, Sanchit Sinha, Aidong Zhang

分类: cs.CL, cs.AI

发布日期: 2025-12-09

🔗 代码/项目: GITHUB

💡 一句话要点

提出RAGLens,利用稀疏自编码器提升检索增强生成的事实性检测。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 检索增强生成 幻觉检测 稀疏自编码器 可解释性 大型语言模型

📋 核心要点

- 现有RAG幻觉检测方法依赖大规模训练或外部LLM,成本高且准确率有限。

- RAGLens利用稀疏自编码器解耦LLM内部激活,识别幻觉触发特征,实现轻量级检测。

- RAGLens在幻觉检测上优于现有方法,提供可解释的理由,并揭示LLM内部幻觉信号分布。

📝 摘要(中文)

检索增强生成(RAG)通过在检索到的证据中 grounding 输出,提高了大型语言模型(LLM)的事实性。然而,真实性失败,即生成的内容与提供的来源相矛盾或超出范围,仍然是一个关键挑战。现有的RAG幻觉检测方法通常依赖于大规模检测器训练(需要大量标注数据)或查询外部LLM判断器(导致高推理成本)。虽然一些方法试图利用LLM的内部表示进行幻觉检测,但其准确性仍然有限。受机制可解释性最新进展的启发,我们采用稀疏自编码器(SAE)来解耦内部激活,成功识别出在RAG幻觉期间被专门触发的特征。基于信息特征选择和加性特征建模的系统流程,我们引入了RAGLens,这是一种轻量级的幻觉检测器,它使用LLM内部表示来准确地标记不真实的RAG输出。RAGLens不仅实现了优于现有方法的检测性能,而且为其决策提供了可解释的理由,从而能够有效地事后缓解不真实的RAG。最后,我们证明了我们的设计选择的合理性,并揭示了LLM中与幻觉相关的信号分布的新见解。代码可在https://github.com/Teddy-XiongGZ/RAGLens 获取。

🔬 方法详解

问题定义:论文旨在解决检索增强生成(RAG)中生成内容不真实的问题,即生成的内容与检索到的证据相矛盾或超出范围。现有方法,如大规模检测器训练和查询外部LLM判断器,存在需要大量标注数据和推理成本过高的痛点;而利用LLM内部表示的方法准确率有限。

核心思路:论文的核心思路是利用稀疏自编码器(SAE)来解耦LLM的内部激活,从而识别出与RAG幻觉相关的特定特征。通过识别这些特征,可以构建一个轻量级的幻觉检测器,并为检测结果提供可解释的理由。这种方法旨在提高检测准确率,降低计算成本,并提供对LLM内部运作的更深入理解。

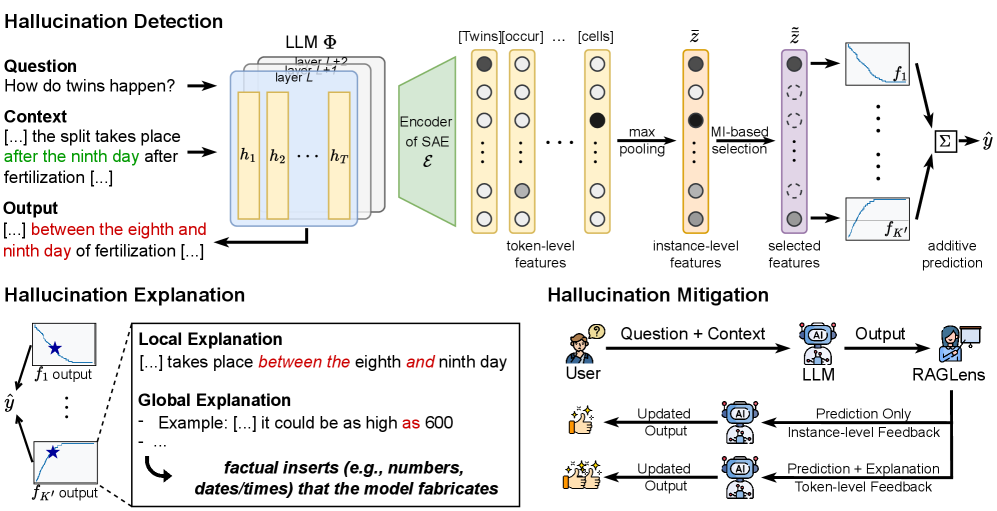

技术框架:RAGLens的整体框架包含以下几个主要阶段:1) 使用RAG生成数据,并标记是否存在幻觉;2) 使用稀疏自编码器训练,以解耦LLM的内部激活;3) 基于信息量的特征选择,选择与幻觉相关的特征;4) 构建加性特征模型,用于预测RAG输出的真实性;5) 对检测结果进行解释,并进行事后缓解。

关键创新:论文最重要的技术创新点在于使用稀疏自编码器来解耦LLM的内部表示,从而能够更精确地识别与幻觉相关的特征。与现有方法相比,RAGLens不需要大规模的标注数据或外部LLM,因此更加轻量级和高效。此外,RAGLens还提供了可解释的检测结果,有助于理解和缓解RAG中的幻觉问题。

关键设计:RAGLens的关键设计包括:1) 稀疏自编码器的结构和训练方式,旨在提取LLM内部激活的稀疏表示;2) 基于信息量的特征选择方法,用于选择与幻觉相关的特征;3) 加性特征模型的构建方式,用于预测RAG输出的真实性;4) 用于解释检测结果的方法,例如,展示哪些特征对检测结果产生了影响。

🖼️ 关键图片

📊 实验亮点

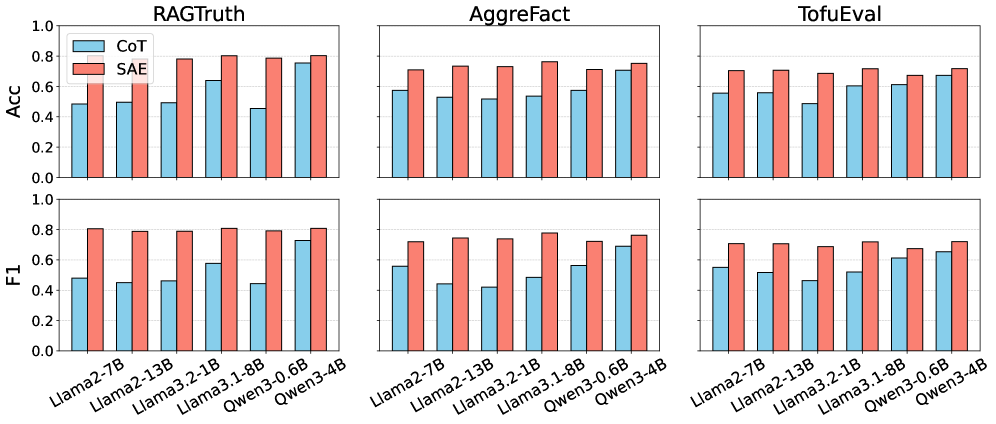

RAGLens在幻觉检测任务上取得了优于现有方法的性能。具体而言,RAGLens在多个数据集上显著提高了检测准确率,同时降低了计算成本。此外,RAGLens还提供了可解释的检测结果,为理解和缓解RAG中的幻觉问题提供了新的视角。

🎯 应用场景

RAGLens可应用于各种需要事实性保证的检索增强生成场景,例如问答系统、知识图谱构建、内容生成等。该研究有助于提高LLM在这些应用中的可靠性和可信度,并为开发更安全、更可控的LLM系统提供指导。

📄 摘要(原文)

Retrieval-Augmented Generation (RAG) improves the factuality of large language models (LLMs) by grounding outputs in retrieved evidence, but faithfulness failures, where generations contradict or extend beyond the provided sources, remain a critical challenge. Existing hallucination detection methods for RAG often rely either on large-scale detector training, which requires substantial annotated data, or on querying external LLM judges, which leads to high inference costs. Although some approaches attempt to leverage internal representations of LLMs for hallucination detection, their accuracy remains limited. Motivated by recent advances in mechanistic interpretability, we employ sparse autoencoders (SAEs) to disentangle internal activations, successfully identifying features that are specifically triggered during RAG hallucinations. Building on a systematic pipeline of information-based feature selection and additive feature modeling, we introduce RAGLens, a lightweight hallucination detector that accurately flags unfaithful RAG outputs using LLM internal representations. RAGLens not only achieves superior detection performance compared to existing methods, but also provides interpretable rationales for its decisions, enabling effective post-hoc mitigation of unfaithful RAG. Finally, we justify our design choices and reveal new insights into the distribution of hallucination-related signals within LLMs. The code is available at https://github.com/Teddy-XiongGZ/RAGLens.