QSTN: A Modular Framework for Robust Questionnaire Inference with Large Language Models

作者: Maximilian Kreutner, Jens Rupprecht, Georg Ahnert, Ahmed Salem, Markus Strohmaier

分类: cs.CL, cs.CY

发布日期: 2025-12-09

备注: The Python package is available at https://github.com/dess-mannheim/QSTN/

💡 一句话要点

QSTN:一个用于大型语言模型稳健问卷推断的模块化框架

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 问卷调查 提示工程 稳健性评估 开源框架

📋 核心要点

- 现有方法在利用大型语言模型进行问卷调查和标注任务时,缺乏系统性的评估和控制框架,难以保证结果的稳健性和可靠性。

- QSTN框架通过模块化的设计,支持对问卷呈现、提示扰动和回复生成方法进行系统性的评估,从而提高LLM生成回复的质量。

- 实验结果表明,问题结构和回复生成方法对LLM生成回复与人类答案的一致性有显著影响,并且QSTN框架降低了计算成本。

📝 摘要(中文)

我们介绍了QSTN,一个开源Python框架,用于系统地从问卷式提示生成回复,以支持使用大型语言模型(LLM)的计算机内调查和标注任务。QSTN能够对问卷呈现方式、提示扰动和回复生成方法进行稳健的评估。我们的大规模评估(超过4000万份调查回复)表明,问题结构和回复生成方法对生成的调查回复与人类答案的一致性有显著影响,并且可以用一小部分的计算成本获得。此外,我们提供了一个无需编码的用户界面,允许研究人员在没有编码知识的情况下使用LLM设置稳健的实验。我们希望QSTN能够在未来支持基于LLM的研究的可重复性和可靠性。

🔬 方法详解

问题定义:论文旨在解决利用大型语言模型(LLM)进行问卷调查和标注任务时,缺乏系统性评估和控制框架的问题。现有方法难以评估问卷呈现方式、提示扰动和回复生成方法对结果的影响,导致LLM生成回复的质量难以保证,且计算成本较高。

核心思路:论文的核心思路是构建一个模块化的框架,允许研究人员系统地控制和评估问卷呈现、提示工程和回复生成方法。通过对这些因素进行细粒度的控制和评估,可以优化LLM的回复质量,并降低计算成本。

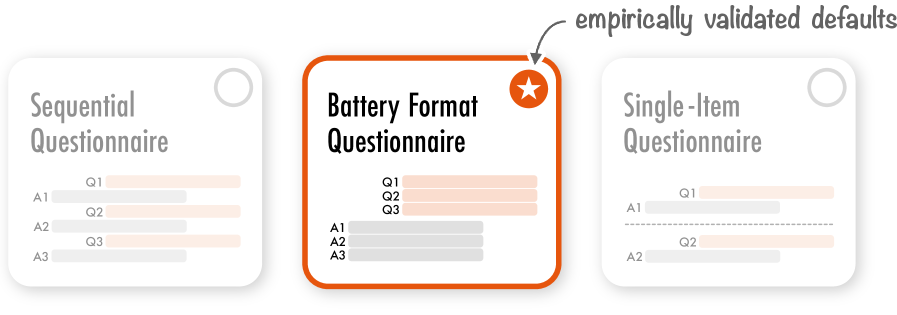

技术框架:QSTN框架包含以下主要模块:1) 问卷生成模块:用于生成不同结构的问卷;2) 提示工程模块:用于对提示进行扰动,例如改变提示的措辞或添加上下文信息;3) 回复生成模块:用于选择不同的LLM和回复生成策略;4) 评估模块:用于评估LLM生成回复的质量,例如与人类答案的一致性。整个流程包括:研究人员定义问卷结构和提示策略,QSTN框架自动生成大量问卷和提示,然后使用LLM生成回复,最后使用评估模块评估回复质量。

关键创新:QSTN的关键创新在于其模块化的设计和对问卷调查流程的系统性控制。它允许研究人员在无需编写大量代码的情况下,对LLM在问卷调查中的应用进行稳健的实验和评估。与现有方法相比,QSTN提供了一个更加灵活和可控的平台,可以更好地理解和优化LLM在问卷调查中的表现。

关键设计:QSTN框架的关键设计包括:1) 模块化的架构,允许研究人员轻松地定制和扩展框架的功能;2) 无需编码的用户界面,降低了研究人员的使用门槛;3) 丰富的评估指标,用于全面评估LLM生成回复的质量;4) 对提示扰动的支持,可以评估LLM对不同提示的鲁棒性。具体参数设置和损失函数取决于所使用的LLM和评估指标,框架本身提供灵活的配置选项。

🖼️ 关键图片

📊 实验亮点

该研究通过超过4000万份调查回复的大规模评估,证明了问题结构和回复生成方法对LLM生成回复与人类答案的一致性有显著影响。此外,QSTN框架提供了一个无需编码的用户界面,降低了研究人员的使用门槛,并显著降低了计算成本。

🎯 应用场景

QSTN框架可应用于各种需要使用LLM进行问卷调查和标注的任务,例如社会科学研究、市场调研、用户反馈收集等。它能够帮助研究人员更可靠地利用LLM获取数据,并降低研究成本。未来,QSTN可以扩展到支持更多类型的问卷和LLM,并集成更高级的评估方法。

📄 摘要(原文)

We introduce QSTN, an open-source Python framework for systematically generating responses from questionnaire-style prompts to support in-silico surveys and annotation tasks with large language models (LLMs). QSTN enables robust evaluation of questionnaire presentation, prompt perturbations, and response generation methods. Our extensive evaluation ($>40 $ million survey responses) shows that question structure and response generation methods have a significant impact on the alignment of generated survey responses with human answers, and can be obtained for a fraction of the compute cost. In addition, we offer a no-code user interface that allows researchers to set up robust experiments with LLMs without coding knowledge. We hope that QSTN will support the reproducibility and reliability of LLM-based research in the future.