Adaptation of Embedding Models to Financial Filings via LLM Distillation

作者: Eliot Brenner, Dominic Seyler, Manjunath Hegde, Andrei Simion, Koustuv Dasgupta, Bing Xiang

分类: cs.CL

发布日期: 2025-12-08

备注: In proceedings of LLM-Finance 2025 : The 2nd IEEE International Workshop on Large Language Models for Finance

💡 一句话要点

提出一种基于LLM蒸馏的金融文档嵌入模型自适应方法,提升金融领域信息检索性能。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 金融文档检索 嵌入模型 知识蒸馏 大语言模型 领域自适应

📋 核心要点

- 现有嵌入模型在金融等专业领域信息检索性能不足,无法满足实际应用需求。

- 利用通用检索嵌入模型作为基础,通过LLM蒸馏,训练领域自适应的专业模型。

- 实验表明,该方法在金融文档检索任务中显著提升了MRR@5和DCG@5等指标。

📝 摘要(中文)

尽管生成式大语言模型(LLM)取得了进展,但专业对话式AI代理的实际应用仍然受到计算成本、延迟要求以及对精确的领域特定相关性度量的需求的限制。现有的嵌入模型虽然解决了前两个约束,但在金融等专业领域的信息检索方面表现不佳。本文提出了一种可扩展的pipeline,该pipeline使用通用检索嵌入模型作为基础,从无标签语料库中训练专业模型。我们的方法在21,800个查询-文档对上测量的14种金融文档类型中,平均MRR@5提高了27.7%,平均DCG@5提高了44.6%,并且在FinanceBench的4个文档类别中的3个上提高了NDCG。我们使用LLM判断的相关性来将领域知识提炼到紧凑的检索器中,从而为RAG调整检索嵌入(双编码器),而不是LLM生成器。先前的工作将合成生成的查询与真实段落配对,以直接微调检索模型。我们的pipeline与之不同之处在于,它引入了学生模型和教师模型之间的交互,该交互将基于检索的从无标签语料库中挖掘困难正/负样本与使用这些样本迭代地重新训练学生模型的权重交织在一起。每次检索迭代都使用改进后的学生模型来挖掘语料库,以获得后续训练迭代的难度逐渐增加的训练样本。该方法提供了一种经济高效的解决方案,可以弥合通用模型和专业领域之间的差距,而无需耗费人力的手动标注。

🔬 方法详解

问题定义:论文旨在解决通用嵌入模型在金融等专业领域信息检索性能不足的问题。现有方法依赖人工标注数据或合成数据,成本高昂且效果有限。论文关注如何利用无标签数据,通过知识蒸馏的方式,提升嵌入模型在金融领域的检索能力。

核心思路:论文的核心思路是利用LLM作为教师模型,指导学生模型学习金融领域的知识。通过迭代地挖掘困难样本,并利用这些样本训练学生模型,逐步提升学生模型的检索能力。这种方法避免了人工标注,降低了成本,同时能够有效地利用无标签数据。

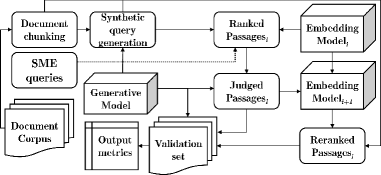

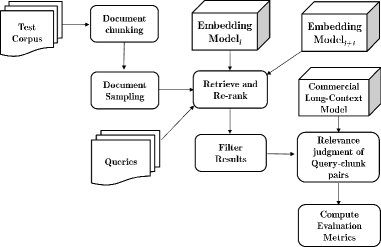

技术框架:整体框架包含以下几个主要阶段:1) 使用通用检索嵌入模型初始化学生模型;2) 利用学生模型从无标签语料库中检索相关文档;3) 使用LLM判断检索结果的相关性,生成训练数据;4) 利用生成的训练数据训练学生模型;5) 重复步骤2-4,迭代优化学生模型。

关键创新:论文的关键创新在于引入了学生模型和教师模型之间的交互式训练过程。通过迭代地挖掘困难样本,并利用这些样本训练学生模型,使得学生模型能够逐步适应金融领域的特点。这种方法不同于传统的知识蒸馏方法,它能够更有效地利用无标签数据,并提升学生模型的性能。

关键设计:论文的关键设计包括:1) 使用通用检索嵌入模型作为初始化的学生模型,保证了模型的泛化能力;2) 使用LLM判断检索结果的相关性,生成高质量的训练数据;3) 迭代地挖掘困难样本,并利用这些样本训练学生模型,提升了模型的鲁棒性;4) 损失函数的设计,需要考虑正负样本的比例,以及难样本挖掘策略。

🖼️ 关键图片

📊 实验亮点

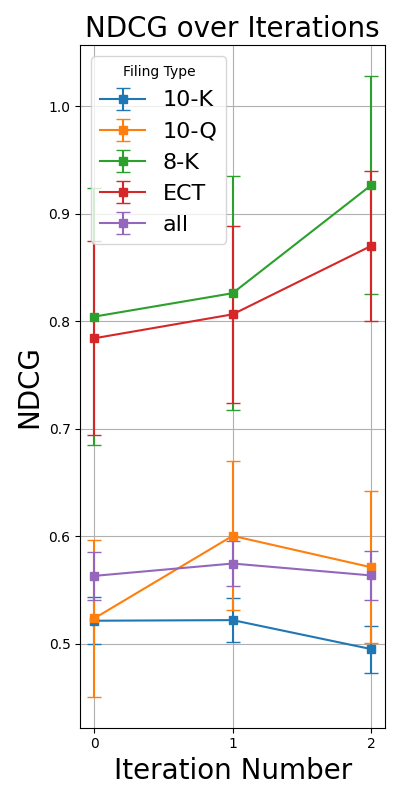

实验结果表明,该方法在14种金融文档类型中,平均MRR@5提高了27.7%,平均DCG@5提高了44.6%,并且在FinanceBench的4个文档类别中的3个上提高了NDCG。这些结果表明,该方法能够显著提升嵌入模型在金融领域的检索性能,优于现有方法。

🎯 应用场景

该研究成果可应用于金融领域的智能搜索、风险管理、合规审查等场景。通过提升金融文档的检索效率和准确性,可以帮助金融机构更好地利用海量数据,提高决策效率,降低运营成本。未来,该方法还可以推广到其他专业领域,例如医疗、法律等。

📄 摘要(原文)

Despite advances in generative large language models (LLMs), practical application of specialized conversational AI agents remains constrained by computation costs, latency requirements, and the need for precise domain-specific relevance measures. While existing embedding models address the first two constraints, they underperform on information retrieval in specialized domains like finance. This paper introduces a scalable pipeline that trains specialized models from an unlabeled corpus using a general purpose retrieval embedding model as foundation. Our method yields an average of 27.7% improvement in MRR$\texttt{@}$5, 44.6% improvement in mean DCG$\texttt{@}$5 across 14 financial filing types measured over 21,800 query-document pairs, and improved NDCG on 3 of 4 document classes in FinanceBench. We adapt retrieval embeddings (bi-encoder) for RAG, not LLM generators, using LLM-judged relevance to distill domain knowledge into a compact retriever. There are prior works which pair synthetically generated queries with real passages to directly fine-tune the retrieval model. Our pipeline differs from these by introducing interaction between student and teacher models that interleaves retrieval-based mining of hard positive/negative examples from the unlabeled corpus with iterative retraining of the student model's weights using these examples. Each retrieval iteration uses the refined student model to mine the corpus for progressively harder training examples for the subsequent training iteration. The methodology provides a cost-effective solution to bridging the gap between general-purpose models and specialized domains without requiring labor-intensive human annotation.