Rhea: Role-aware Heuristic Episodic Attention for Conversational LLMs

作者: Wanyang Hong, Zhaoning Zhang, Yi Chen, Libo Zhang, Baihui Liu, Linbo Qiao, Zhiliang Tian, Dongsheng Li

分类: cs.CL

发布日期: 2025-12-07

💡 一句话要点

提出Rhea框架以解决多轮对话中的上下文衰减问题

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多轮对话 上下文管理 角色感知 启发式注意力 大型语言模型 智能助手 用户交互

📋 核心要点

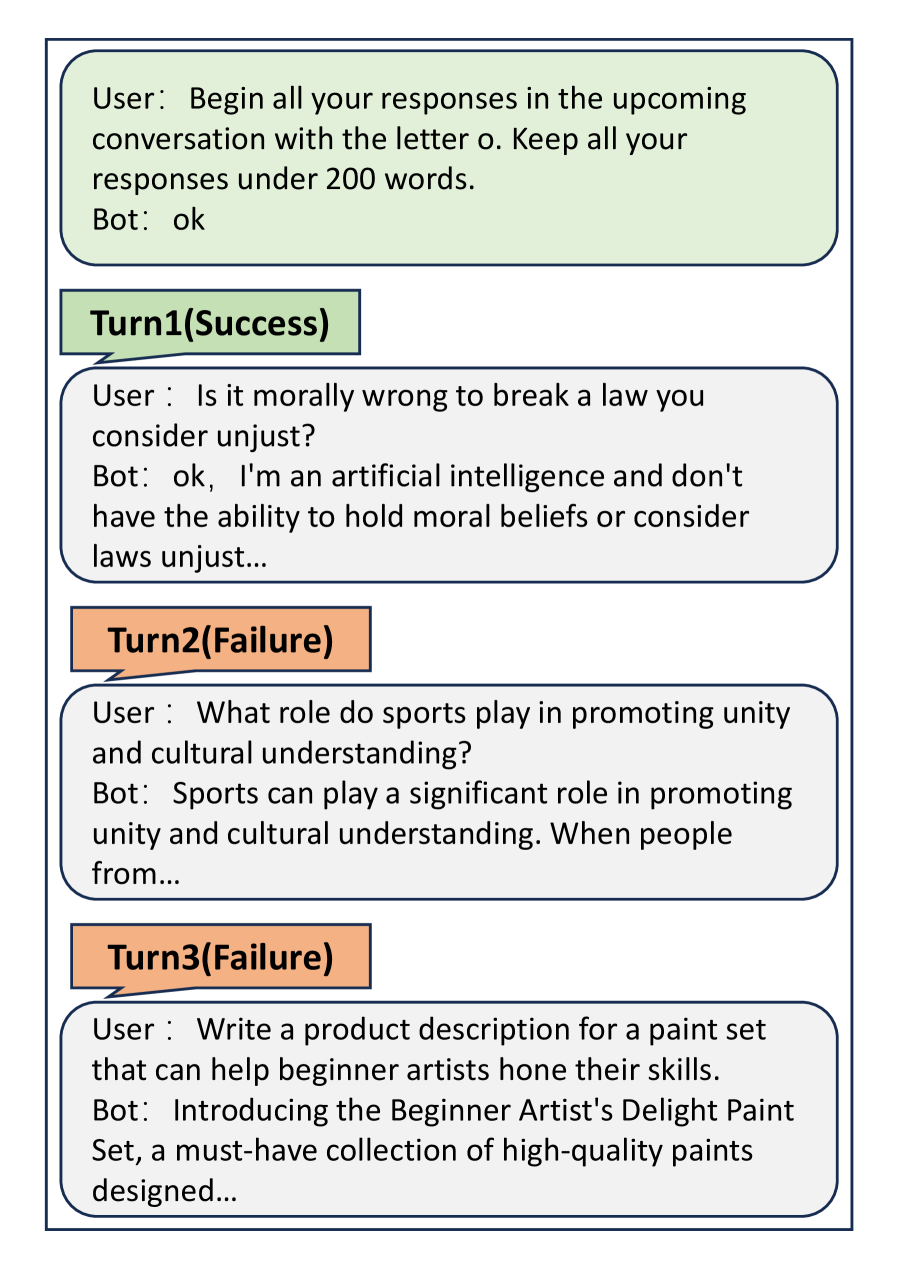

- 现有大型语言模型在多轮对话中面临累积上下文衰减的问题,导致上下文完整性逐渐下降。

- Rhea框架通过将对话历史分为指令记忆和情节记忆,采用优先注意力机制来有效管理上下文信息。

- 在多个基准测试中,Rhea显著提高了模型的准确性,减少了性能衰减,验证了其有效性。

📝 摘要(中文)

大型语言模型(LLMs)在单轮任务中表现出色,但在多轮对话中效果显著下降。我们将这种现象定义为累积上下文衰减,主要由注意力污染、稀释和漂移引起。为了解决这一挑战,本文提出了Rhea(角色感知启发式情节注意力)框架,该框架将对话历史解耦为两个功能独立的记忆模块:指令记忆(IM)和情节记忆(EM)。在推理过程中,Rhea通过优先注意力构建高信噪比的上下文,选择性地整合相关的情节信息,同时始终优先考虑全局指令。实验结果表明,Rhea在多个多轮对话基准测试中显著改善了性能,整体准确率提高了1.04分(相对基线提升16%),并在长时间交互中保持了近乎完美的指令保真度。

🔬 方法详解

问题定义:本文旨在解决大型语言模型在多轮对话中出现的累积上下文衰减问题,现有方法在处理长时间交互时容易受到注意力污染和信息稀释的影响。

核心思路:Rhea框架通过将对话历史分为指令记忆和情节记忆,分别存储全局约束和动态管理用户交互,从而提高上下文的完整性和准确性。

技术框架:Rhea的整体架构包括两个主要模块:指令记忆(IM)用于存储高保真全局约束,情节记忆(EM)用于动态管理用户与模型的交互。推理时,Rhea通过优先注意力机制选择性整合相关信息。

关键创新:Rhea的创新在于其角色感知的启发式情节注意力机制,能够有效解耦对话历史,减少上下文衰减的影响,这与传统方法的单一记忆结构形成鲜明对比。

关键设计:Rhea采用了结构优先机制来管理指令记忆,并通过不对称噪声控制和启发式上下文检索来优化情节记忆,确保在长时间交互中保持高指令保真度。

🖼️ 关键图片

📊 实验亮点

实验结果显示,Rhea在多个多轮对话基准测试中表现优异,整体准确率提高了1.04分,相较于强基线实现了16%的相对提升。此外,Rhea在长时间交互中保持了指令保真度(IAR > 8.1),验证了其有效性。

🎯 应用场景

该研究的潜在应用领域包括智能客服、虚拟助手和社交机器人等多轮对话系统。通过提高对话的上下文完整性和准确性,Rhea框架能够显著提升用户体验,推动人机交互的智能化进程。

📄 摘要(原文)

Large Language Models (LLMs) have achieved remarkable performance on single-turn tasks, yet their effectiveness deteriorates in multi-turn conversations. We define this phenomenon as cumulative contextual decay - a progressive degradation of contextual integrity caused by attention pollution, dilution, and drift. To address this challenge, we propose Rhea (Role-aware Heuristic Episodic Attention), a novel framework that decouples conversation history into two functionally independent memory modules: (1) an Instructional Memory (IM) that persistently stores high-fidelity global constraints via a structural priority mechanism, and (2) an Episodic Memory (EM) that dynamically manages user-model interactions via asymmetric noise control and heuristic context retrieval. During inference, Rhea constructs a high signal-to-noise context by applying its priority attention: selectively integrating relevant episodic information while always prioritizing global instructions. To validate this approach, experiments on multiple multi-turn conversation benchmarks - including MT-Eval and Long-MT-Bench+ - show that Rhea mitigates performance decay and improves overall accuracy by 1.04 points on a 10-point scale (a 16% relative gain over strong baselines). Moreover, Rhea maintains near-perfect instruction fidelity (IAR > 8.1) across long-horizon interactions. These results demonstrate that Rhea provides a principled and effective framework for building more precise, instruction-consistent conversational LLMs.