Optimizing Medical Question-Answering Systems: A Comparative Study of Fine-Tuned and Zero-Shot Large Language Models with RAG Framework

作者: Tasnimul Hassan, Md Faisal Karim, Haziq Jeelani, Elham Behnam, Robert Green, Fayeq Jeelani Syed

分类: cs.CL, cs.AI

发布日期: 2025-12-05

💡 一句话要点

提出基于RAG的医学问答系统,结合微调LLM提升准确率并减少幻觉

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 医学问答系统 检索增强生成 大型语言模型 微调 LoRA PubMedQA MedMCQA

📋 核心要点

- 现有医学问答系统面临事实准确性不足和产生幻觉的挑战,直接应用LLM效果不佳。

- 提出基于RAG的医学问答系统,通过检索相关医学文献来增强LLM的回答,提高准确性。

- 实验表明,该方法在PubMedQA数据集上将LLaMA~2的准确率从55.4%提升至71.8%,显著减少幻觉。

📝 摘要(中文)

医学问答系统可以受益于大型语言模型(LLMs)的进步,但直接将LLMs应用于临床领域面临着保持事实准确性和避免幻觉等挑战。本文提出了一种基于检索增强生成(RAG)的医学问答系统,该系统结合了领域特定的知识检索和开源LLMs来回答医学问题。我们使用低秩适应(LoRA)微调了两个最先进的开源LLMs(LLaMA~2和Falcon),以实现高效的领域专业化。该系统检索相关的医学文献来支持LLM的答案,从而提高事实正确性并减少幻觉。我们在基准数据集(PubMedQA和MedMCQA)上评估了该方法,结果表明,与单独使用LLMs相比,检索增强在答案准确性方面产生了可衡量的改进。我们微调的LLaMA~2模型在PubMedQA上实现了71.8%的准确率,大大高于55.4%的零样本基线,同时通过提供来源参考文献来保持透明度。我们还详细介绍了系统设计和微调方法,表明将答案建立在检索到的证据基础上可减少约60%的不受支持内容。这些结果突出了RAG增强的开源LLMs在可靠的生物医学QA方面的潜力,指向了实际的临床信息学应用。

🔬 方法详解

问题定义:医学问答系统需要准确且可靠地回答医学问题。现有方法,特别是直接应用大型语言模型(LLMs),容易产生不准确或虚构的信息(即幻觉),缺乏对医学知识的有效利用和验证。因此,如何提高医学问答系统的准确性和可靠性,减少幻觉,是一个关键问题。

核心思路:论文的核心思路是利用检索增强生成(RAG)框架,将LLM与外部医学知识库相结合。通过检索与问题相关的医学文献,为LLM提供上下文信息,从而引导LLM生成更准确、更可靠的答案。同时,通过对LLM进行领域特定微调,进一步提升其在医学领域的表现。

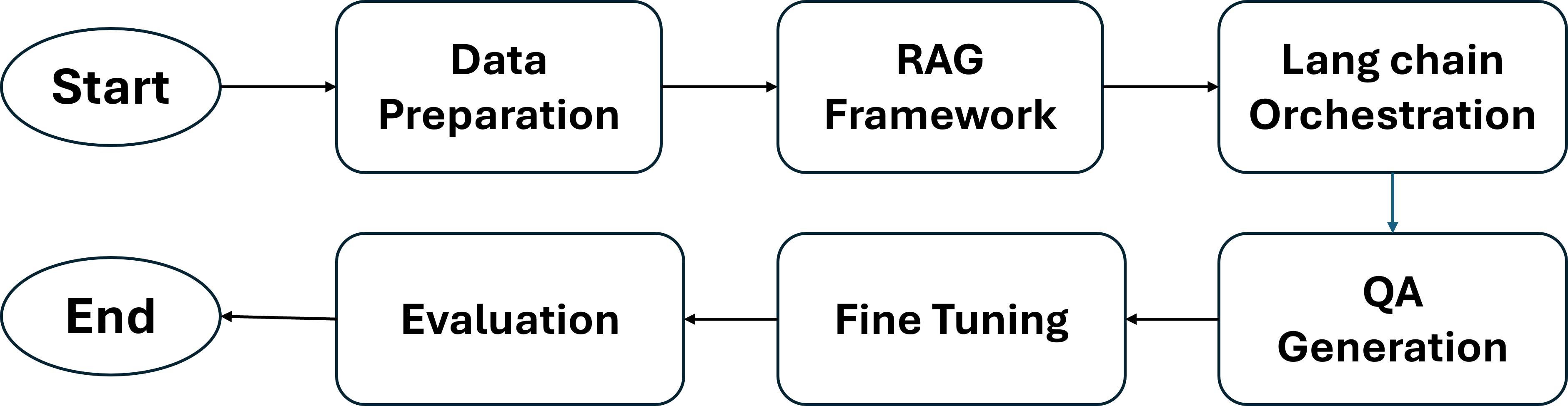

技术框架:该医学问答系统主要包含以下几个模块:1) 问题输入模块:接收用户提出的医学问题。2) 文档检索模块:根据问题检索相关的医学文献。3) LLM生成模块:利用检索到的文献作为上下文,生成答案。4) 微调模块:使用LoRA方法对LLM进行微调。整体流程是:用户输入问题 -> 系统检索相关医学文献 -> 微调后的LLM基于检索结果生成答案 -> 输出答案和参考文献。

关键创新:该论文的关键创新在于将RAG框架与领域特定微调相结合,应用于医学问答系统。与直接使用LLM相比,RAG框架能够提供外部知识支持,减少幻觉;与传统的RAG方法相比,领域特定微调能够提升LLM在医学领域的表现。此外,论文还采用了LoRA方法进行高效微调,降低了计算成本。

关键设计:在微调方面,论文采用了LoRA(Low-Rank Adaptation)方法,这是一种参数高效的微调技术,通过学习低秩矩阵来更新LLM的权重,从而减少了计算资源的需求。具体来说,作者使用PubMedQA和MedMCQA数据集对LLaMA~2和Falcon模型进行了微调。在检索方面,使用了基于向量相似度的检索方法,将问题和医学文献都编码为向量,然后通过计算向量之间的相似度来选择相关的文献。

🖼️ 关键图片

📊 实验亮点

实验结果表明,基于RAG的医学问答系统在PubMedQA和MedMCQA数据集上取得了显著的性能提升。微调后的LLaMA~2模型在PubMedQA上达到了71.8%的准确率,相比于零样本基线(55.4%)有显著提升。此外,该系统能够将LLM生成的不受支持内容减少约60%,显著提高了答案的可靠性。这些结果表明,RAG框架和领域特定微调是提高医学问答系统性能的有效方法。

🎯 应用场景

该研究成果可应用于临床决策支持系统、医学知识库构建、患者咨询服务等领域。通过提供准确可靠的医学问答,可以辅助医生进行诊断和治疗,帮助患者更好地了解自己的病情,并促进医学知识的传播和普及。未来,该技术有望进一步发展,实现个性化的医学问答服务,并与其他医疗信息系统集成,提升医疗服务的效率和质量。

📄 摘要(原文)

Medical question-answering (QA) systems can benefit from advances in large language models (LLMs), but directly applying LLMs to the clinical domain poses challenges such as maintaining factual accuracy and avoiding hallucinations. In this paper, we present a retrieval-augmented generation (RAG) based medical QA system that combines domain-specific knowledge retrieval with open-source LLMs to answer medical questions. We fine-tune two state-of-the-art open LLMs (LLaMA~2 and Falcon) using Low-Rank Adaptation (LoRA) for efficient domain specialization. The system retrieves relevant medical literature to ground the LLM's answers, thereby improving factual correctness and reducing hallucinations. We evaluate the approach on benchmark datasets (PubMedQA and MedMCQA) and show that retrieval augmentation yields measurable improvements in answer accuracy compared to using LLMs alone. Our fine-tuned LLaMA~2 model achieves 71.8% accuracy on PubMedQA, substantially improving over the 55.4% zero-shot baseline, while maintaining transparency by providing source references. We also detail the system design and fine-tuning methodology, demonstrating that grounding answers in retrieved evidence reduces unsupported content by approximately 60%. These results highlight the potential of RAG-augmented open-source LLMs for reliable biomedical QA, pointing toward practical clinical informatics applications.