Enhancing Clinical Note Generation with ICD-10, Clinical Ontology Knowledge Graphs, and Chain-of-Thought Prompting Using GPT-4

作者: Ivan Makohon, Mohamad Najafi, Jian Wu, Mathias Brochhausen, Yaohang Li

分类: cs.CL, q-bio.QM

发布日期: 2025-12-04

💡 一句话要点

利用ICD-10、临床知识图谱和CoT提示,增强GPT-4的临床笔记生成能力

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 临床笔记生成 大型语言模型 思维链提示 知识图谱 语义搜索 GPT-4 电子健康记录

📋 核心要点

- 医生手动编写临床笔记耗时,影响效率和患者体验,亟需自动化解决方案。

- 论文提出结合CoT提示、语义搜索和临床知识图谱,提升LLM生成临床笔记的质量。

- 实验结果表明,该方法优于标准一次性提示,验证了其在临床笔记生成方面的有效性。

📝 摘要(中文)

过去十年,由于美国《2009年健康信息技术促进经济和临床健康法案》(HITECH)和《2016年21世纪医疗法案》所创造的有利政策环境,电子健康记录(EHR)数据量激增。医生们花费大量时间以自由文本的形式在EHR中记录患者的评估、诊断和治疗等临床笔记。手动编写临床笔记耗费医生大量宝贵时间,延长患者等待时间,并可能延误诊断。大型语言模型(LLM)具有生成与人工撰写的新闻文章非常相似的文章的能力。我们研究了使用思维链(CoT)提示工程来改进LLM在临床笔记生成中的响应。在我们的提示中,我们使用国际疾病分类(ICD)代码和基本患者信息作为输入。我们研究了一种将传统CoT与语义搜索结果相结合的策略,以提高生成的临床笔记的质量。此外,我们还注入了从临床本体构建的知识图谱(KG),以进一步丰富生成的临床笔记的领域特定知识。我们使用GPT-4在来自CodiEsp测试数据集的六个临床案例上测试了我们的提示技术,结果表明它优于标准一次性提示生成的临床笔记。

🔬 方法详解

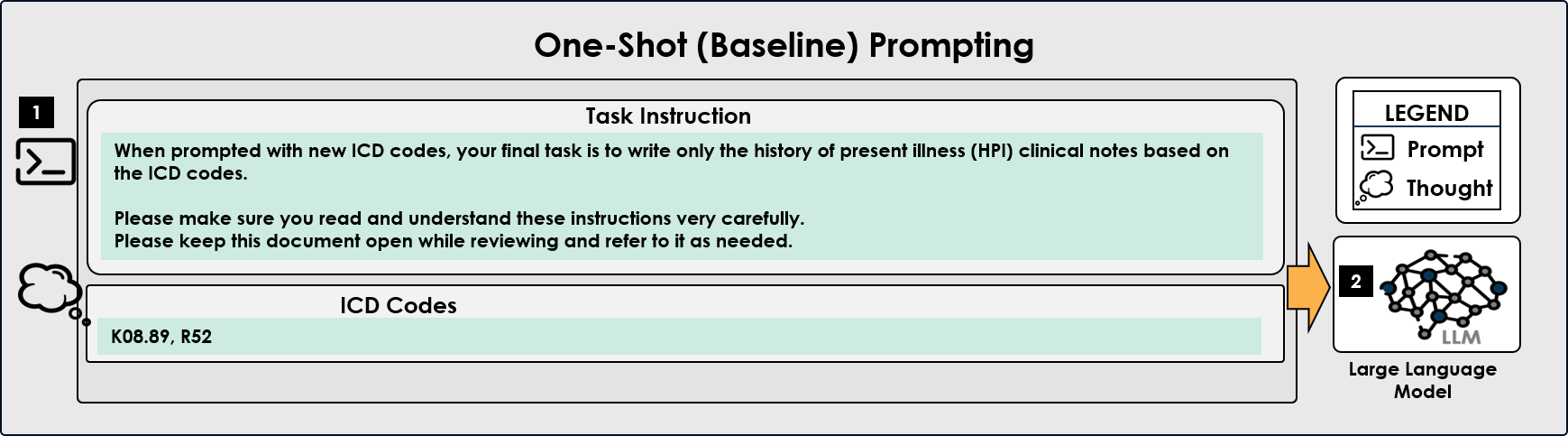

问题定义:临床医生花费大量时间手动编写临床笔记,这是一个耗时且容易出错的过程。现有的方法,例如简单的一次性提示,无法充分利用领域知识,导致生成的临床笔记质量不高,缺乏专业性和准确性。

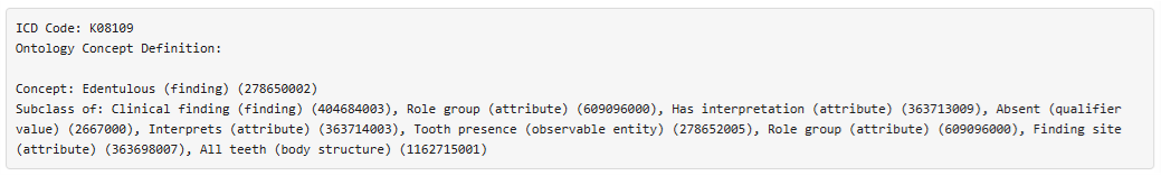

核心思路:论文的核心思路是利用Chain-of-Thought (CoT) 提示工程,结合语义搜索和临床知识图谱,来增强大型语言模型(LLM)在生成临床笔记时的能力。通过CoT提示,模型可以逐步推理,生成更连贯和合理的临床笔记。语义搜索用于检索相关的临床信息,而知识图谱则提供丰富的领域知识,从而提高生成笔记的质量和准确性。

技术框架:整体框架包括以下几个主要步骤:1) 输入ICD代码和患者基本信息;2) 使用CoT提示引导LLM进行推理;3) 利用语义搜索检索相关临床信息;4) 从临床本体构建知识图谱,并将其注入到提示中;5) 使用GPT-4生成临床笔记;6) 评估生成的临床笔记的质量。

关键创新:该论文的关键创新在于将CoT提示、语义搜索和临床知识图谱相结合,以增强LLM在临床笔记生成方面的能力。与传统的一次性提示相比,该方法能够更好地利用领域知识,生成更准确、更专业的临床笔记。此外,利用知识图谱来丰富LLM的领域知识也是一个重要的创新点。

关键设计:在提示工程方面,论文设计了详细的CoT提示,引导LLM逐步推理,生成临床笔记。在知识图谱构建方面,论文利用临床本体构建知识图谱,并将其注入到提示中,以提高生成笔记的质量。具体参数设置和损失函数等技术细节在论文中未详细说明,属于未知信息。

🖼️ 关键图片

📊 实验亮点

实验结果表明,结合CoT提示、语义搜索和临床知识图谱的方法,在使用GPT-4生成临床笔记时,优于标准的一次性提示。具体的性能数据和提升幅度在摘要中未明确给出,属于未知信息。但结论表明该方法在临床笔记生成方面具有显著优势。

🎯 应用场景

该研究成果可应用于临床辅助决策支持系统,帮助医生自动生成高质量的临床笔记,从而节省时间、提高效率、减少错误,并最终改善患者的医疗体验。未来,该技术可扩展到其他医疗文档生成任务,例如病历摘要、出院总结等。

📄 摘要(原文)

In the past decade a surge in the amount of electronic health record (EHR) data in the United States, attributed to a favorable policy environment created by the Health Information Technology for Economic and Clinical Health (HITECH) Act of 2009 and the 21st Century Cures Act of 2016. Clinical notes for patients' assessments, diagnoses, and treatments are captured in these EHRs in free-form text by physicians, who spend a considerable amount of time entering and editing them. Manually writing clinical notes takes a considerable amount of a doctor's valuable time, increasing the patient's waiting time and possibly delaying diagnoses. Large language models (LLMs) possess the ability to generate news articles that closely resemble human-written ones. We investigate the usage of Chain-of-Thought (CoT) prompt engineering to improve the LLM's response in clinical note generation. In our prompts, we use as input International Classification of Diseases (ICD) codes and basic patient information. We investigate a strategy that combines the traditional CoT with semantic search results to improve the quality of generated clinical notes. Additionally, we infuse a knowledge graph (KG) built from clinical ontology to further enrich the domain-specific knowledge of generated clinical notes. We test our prompting technique on six clinical cases from the CodiEsp test dataset using GPT-4 and our results show that it outperformed the clinical notes generated by standard one-shot prompts.