DAMASHA: Detecting AI in Mixed Adversarial Texts via Segmentation with Human-interpretable Attribution

作者: L. D. M. S. Sai Teja, N. Siva Gopala Krishna, Ufaq Khan, Muhammad Haris Khan, Atul Mishra

分类: cs.CL

发布日期: 2025-12-04 (更新: 2026-01-04)

备注: EACL 2026 Findings

💡 一句话要点

DAMASHA:通过可解释归因分割检测混合对抗文本中的AI生成内容

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 混合作者文本检测 对抗鲁棒性 可解释性AI 文本分割 文体特征

📋 核心要点

- 现有方法难以有效分割混合作者文本,尤其是在对抗性攻击下,鲁棒性不足,且缺乏可解释性。

- Info-Mask框架融合文体特征、困惑度信号和结构化边界建模,提升混合作者文本分割的准确性和鲁棒性。

- 实验表明,Info-Mask在对抗性条件下显著提高了分割的鲁棒性,并提供了人类可解释的归因信息。

📝 摘要(中文)

在大语言模型(LLMs)快速发展的时代,人类和AI生成的文本之间的界限变得越来越模糊。本文旨在解决混合作者文本的分割问题,即识别文本中作者身份从人类转变为AI或反之的转换点,这对于保证文本的真实性、信任度和人工监督至关重要。我们提出了一种名为Info-Mask的新框架,用于混合作者身份检测,该框架集成了文体线索、困惑度驱动的信号和结构化边界建模,以准确分割人类与AI协作生成的内容。为了评估系统在对抗性扰动下的鲁棒性,我们构建并发布了一个对抗性基准数据集MAS,旨在探测现有检测器的极限。除了分割准确性之外,我们还引入了人类可解释的归因(HIA)覆盖,突出显示文体特征如何影响边界预测,并进行了一项小规模的人工研究来评估它们的有效性。在多种架构中,Info-Mask显著提高了对抗条件下的跨度级别鲁棒性,建立了新的基线,同时也揭示了剩余的挑战。我们的发现突出了对抗鲁棒、可解释的混合作者身份检测的希望和局限性,对人机协同创作中的信任和监督具有重要意义。

🔬 方法详解

问题定义:论文旨在解决混合作者文本分割问题,即在一段文本中,自动识别哪些部分是由人类撰写,哪些部分是由AI生成。现有方法在对抗性攻击下表现不佳,容易被精心设计的文本扰动所欺骗,并且缺乏对决策过程的解释性,难以让用户理解模型判断的依据。

核心思路:论文的核心思路是结合多种信息源(文体特征、困惑度)进行综合判断,并利用结构化建模来优化边界识别。通过引入Info-Mask机制,模型能够更关注文本中与作者身份相关的关键信息,从而提高分割的准确性和鲁棒性。同时,提供人类可解释的归因信息,增强用户对模型预测的信任度。

技术框架:DAMASHA框架主要包含以下几个模块:1) 文体特征提取模块,用于提取文本的文体特征,如词汇多样性、句法复杂度等;2) 困惑度计算模块,利用预训练语言模型计算文本的困惑度,反映文本的流畅度和自然度;3) 结构化边界建模模块,利用条件随机场(CRF)等模型对文本的边界进行建模,考虑相邻文本片段之间的依赖关系;4) Info-Mask融合模块,将文体特征、困惑度和边界信息进行融合,生成最终的分割结果。

关键创新:论文的关键创新在于Info-Mask机制和人类可解释的归因(HIA)。Info-Mask通过选择性地关注与作者身份相关的特征,提高了模型对对抗性攻击的鲁棒性。HIA则通过可视化文体特征对边界预测的影响,增强了模型的可解释性。

关键设计:在文体特征提取方面,论文采用了多种经典的文体特征,如平均句子长度、词汇多样性等。在困惑度计算方面,论文使用了预训练的语言模型,如GPT-2。在结构化边界建模方面,论文使用了条件随机场(CRF)模型。Info-Mask的具体实现方式未知,但推测是利用注意力机制或者门控机制来选择性地关注不同的特征。

🖼️ 关键图片

📊 实验亮点

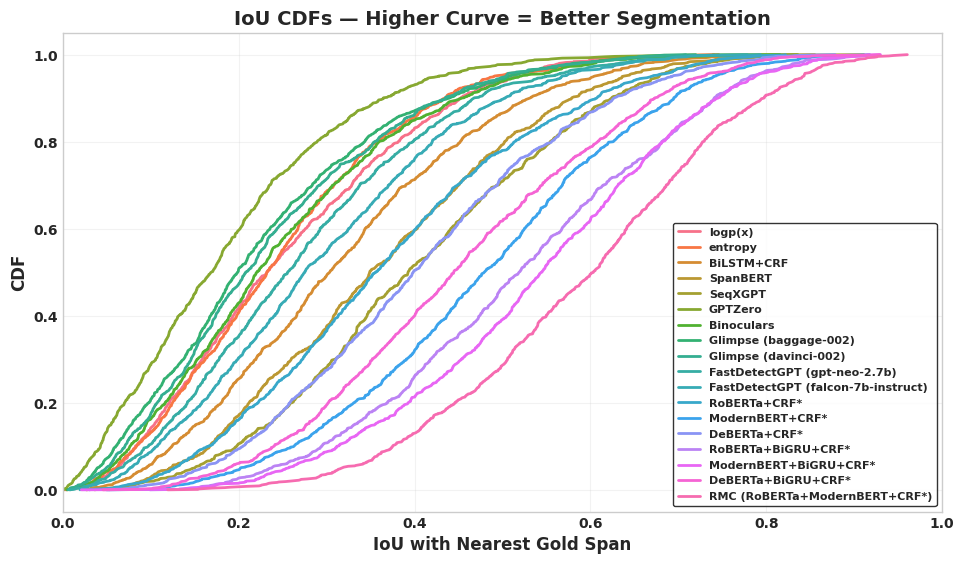

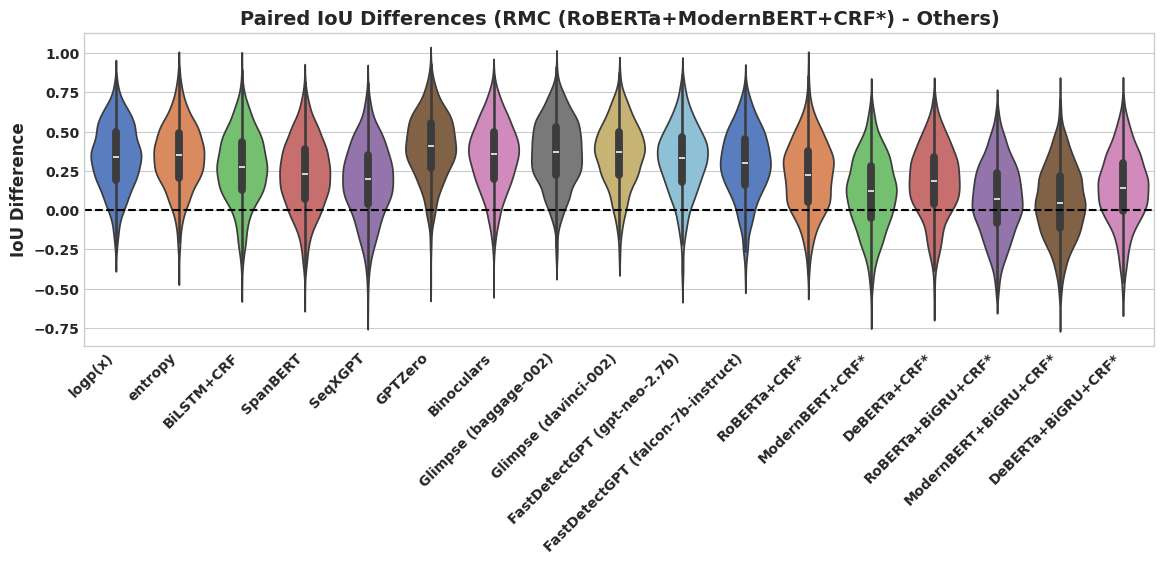

实验结果表明,Info-Mask在对抗性条件下显著提高了混合作者文本分割的鲁棒性,优于现有方法。在MAS数据集上,Info-Mask取得了最佳的性能,并提供了人类可解释的归因信息,增强了用户对模型预测的信任度。具体性能数据未知,但强调了在对抗环境下的显著提升。

🎯 应用场景

该研究成果可应用于检测AI代写、防止学术欺诈、识别虚假信息等领域。通过准确分割混合作者文本,可以提高内容的可信度,维护知识产权,并促进人机协作的健康发展。未来,该技术有望应用于更广泛的文本分析任务,如情感分析、主题识别等。

📄 摘要(原文)

In the age of advanced large language models (LLMs), the boundaries between human and AI-generated text are becoming increasingly blurred. We address the challenge of segmenting mixed-authorship text, that is identifying transition points in text where authorship shifts from human to AI or vice-versa, a problem with critical implications for authenticity, trust, and human oversight. We introduce a novel framework, called Info-Mask for mixed authorship detection that integrates stylometric cues, perplexity-driven signals, and structured boundary modeling to accurately segment collaborative human-AI content. To evaluate the robustness of our system against adversarial perturbations, we construct and release an adversarial benchmark dataset Mixed-text Adversarial setting for Segmentation (MAS), designed to probe the limits of existing detectors. Beyond segmentation accuracy, we introduce Human-Interpretable Attribution (HIA overlays that highlight how stylometric features inform boundary predictions, and we conduct a small-scale human study assessing their usefulness. Across multiple architectures, Info-Mask significantly improves span-level robustness under adversarial conditions, establishing new baselines while revealing remaining challenges. Our findings highlight both the promise and limitations of adversarially robust, interpretable mixed-authorship detection, with implications for trust and oversight in human-AI co-authorship.