From Hypothesis to Premises: LLM-based Backward Logical Reasoning with Selective Symbolic Translation

作者: Qingchuan Li, Mingyue Cheng, Zirui Liu, Daoyu Wang, Yuting Zeng, Tongxuan Liu

分类: cs.CL

发布日期: 2025-12-03

备注: Accepted by AAAI2026

💡 一句话要点

提出基于LLM的假设驱动逆向逻辑推理框架,提升推理准确性和效率。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 逻辑推理 大型语言模型 逆向推理 符号翻译 自然语言理解

📋 核心要点

- 现有基于LLM的逻辑推理方法依赖正向推理,存在推理路径冗余、幻觉步骤和语义漂移等问题。

- HBLR框架通过置信度感知的符号翻译和假设驱动的逆向推理,模拟人类演绎思维,提升推理的可靠性。

- 实验结果表明,HBLR在多个推理基准测试中,显著优于现有方法,提高了推理准确性和效率。

📝 摘要(中文)

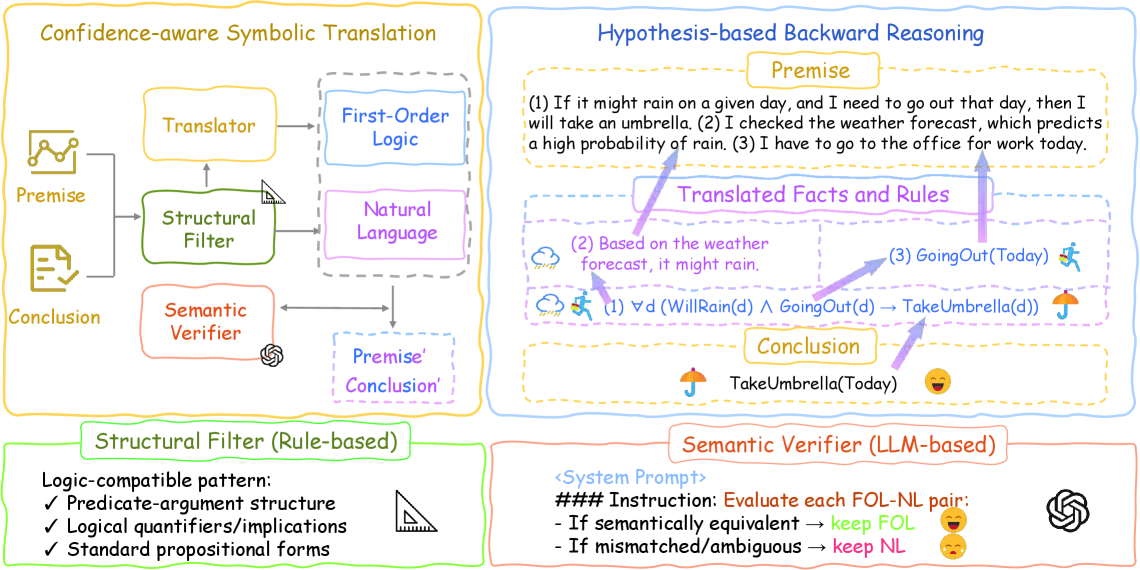

本文提出了一种新颖的框架,即假设驱动的逆向逻辑推理(HBLR),旨在解决自然语言理解中的逻辑推理难题。HBLR集成了置信度感知的符号翻译与假设驱动的逆向推理。在翻译阶段,只有高置信度的文本片段被转换为逻辑形式(如一阶逻辑FOL),而置信度较低的内容则保留为自然语言。翻译反射模块通过评估符号输出并将其在必要时恢复为文本来确保语义保真度。在推理阶段,HBLR通过假设结论为真并递归验证其前提来模拟人类的演绎思维。推理反射模块进一步识别和纠正有缺陷的推理步骤,从而增强逻辑连贯性。在五个推理基准上的大量实验表明,HBLR在准确性和效率方面均优于强大的基线模型。

🔬 方法详解

问题定义:论文旨在解决大型语言模型在逻辑推理任务中存在的不足,特别是现有方法依赖于从前提推导结论的正向推理模式,容易产生冗余的推理路径、幻觉步骤以及语义漂移,导致推理效率低下且结果不可靠。

核心思路:论文的核心思路是模拟人类的演绎推理过程,采用假设驱动的逆向推理。即首先假设结论是正确的,然后反向验证支持该结论的前提是否成立。这种方法可以避免不必要的推理路径,并专注于与结论相关的关键信息。

技术框架:HBLR框架包含两个主要阶段:置信度感知的符号翻译阶段和假设驱动的逆向推理阶段。在翻译阶段,利用置信度评估机制,将高置信度的文本片段转换为逻辑符号(如FOL),而低置信度的片段则保留为自然语言。翻译反射模块用于评估符号翻译的质量,并将有损翻译还原为文本。在推理阶段,从假设结论为真开始,递归地验证其前提。推理反射模块用于识别和纠正推理过程中的错误步骤。

关键创新:HBLR的关键创新在于将置信度感知的符号翻译与假设驱动的逆向推理相结合。传统的符号翻译往往会损失信息,而HBLR通过保留低置信度文本和使用翻译反射模块,尽可能地保留了原始语义。逆向推理则避免了正向推理中可能出现的冗余和幻觉。

关键设计:置信度评估模块用于评估每个文本片段转换为逻辑符号的置信度,只有超过阈值的片段才会被转换。翻译反射模块使用LLM来评估符号翻译的质量,如果LLM认为翻译后的符号与原始文本的语义不一致,则将该片段还原为文本。推理反射模块则使用LLM来检查每个推理步骤的逻辑有效性,并尝试纠正错误。

🖼️ 关键图片

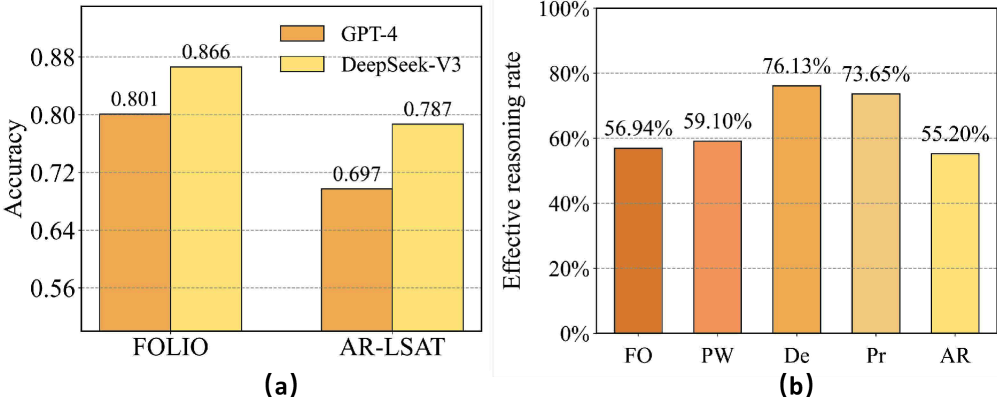

📊 实验亮点

HBLR在五个推理基准测试中均取得了显著的性能提升,证明了其有效性。具体数据需要在论文中查找,但摘要中明确指出HBLR在准确性和效率方面均优于强大的基线模型。这表明HBLR在解决复杂逻辑推理问题方面具有显著优势。

🎯 应用场景

该研究成果可应用于科学发现、数学定理证明和复杂决策制定等领域。通过提高逻辑推理的准确性和效率,HBLR有望在自动化推理、智能问答、知识图谱构建等任务中发挥重要作用,并推动人工智能在更广泛领域的应用。

📄 摘要(原文)

Logical reasoning is a core challenge in natural language understanding and a fundamental capability of artificial intelligence, underpinning scientific discovery, mathematical theorem proving, and complex decision-making. Despite the remarkable progress of large language models (LLMs), most current approaches still rely on forward reasoning paradigms, generating step-by-step rationales from premises to conclusions. However, such methods often suffer from redundant inference paths, hallucinated steps, and semantic drift, resulting in inefficient and unreliable reasoning. In this paper, we propose a novel framework, Hypothesis-driven Backward Logical Reasoning (HBLR). The core idea is to integrate confidence-aware symbolic translation with hypothesis-driven backward reasoning. In the translation phase, only high-confidence spans are converted into logical form, such as First-Order Logic (FOL), while uncertain content remains in natural language. A translation reflection module further ensures semantic fidelity by evaluating symbolic outputs and reverting lossy ones back to text when necessary. In the reasoning phase, HBLR simulates human deductive thinking by assuming the conclusion is true and recursively verifying its premises. A reasoning reflection module further identifies and corrects flawed inference steps, enhancing logical coherence. Extensive experiments on five reasoning benchmarks demonstrate that HBLR consistently outperforms strong baselines in both accuracy and efficiency.