PromptBridge: Cross-Model Prompt Transfer for Large Language Models

作者: Yaxuan Wang, Quan Liu, Zhenting Wang, Zichao Li, Wei Wei, Yang Liu, Yujia Bao

分类: cs.CL, cs.AI

发布日期: 2025-12-01

💡 一句话要点

PromptBridge:一种用于大型语言模型的跨模型Prompt迁移框架

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 Prompt工程 跨模型迁移 模型漂移 Prompt优化

📋 核心要点

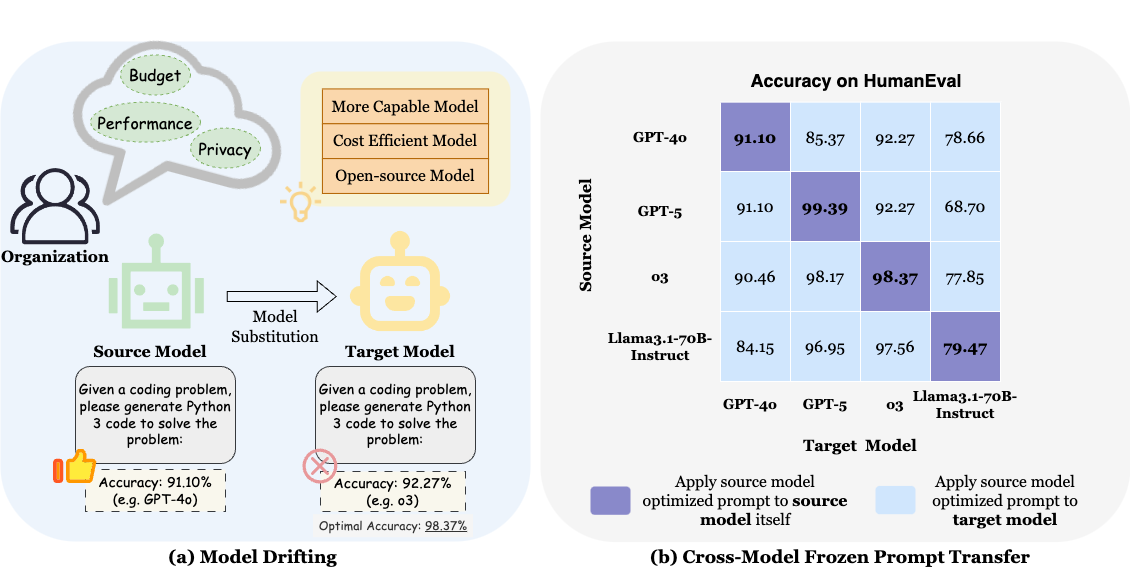

- 现有Prompt工程对特定模型高度敏感,在不同LLM间迁移时性能显著下降,即存在“模型漂移”问题。

- PromptBridge通过学习源模型和目标模型之间的Prompt映射,实现跨模型Prompt的有效迁移,无需重新优化。

- 实验表明,PromptBridge在单代理和多代理环境中均能提高下游任务的准确性,并降低模型迁移成本。

📝 摘要(中文)

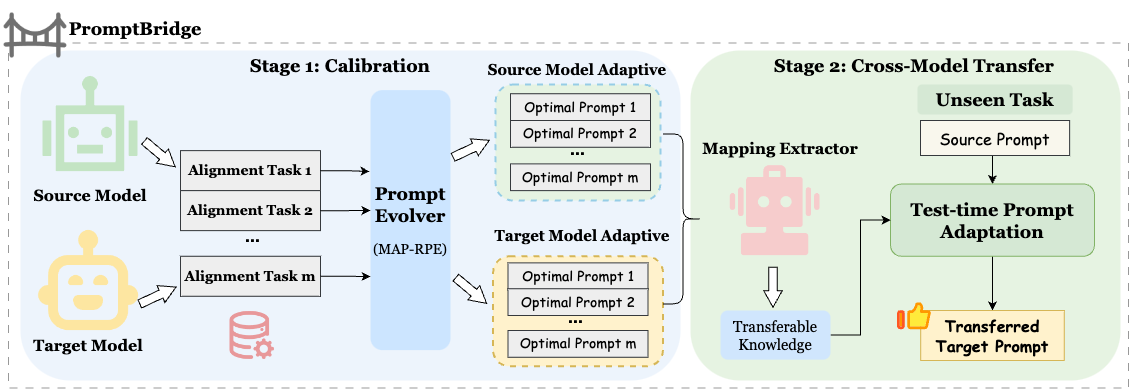

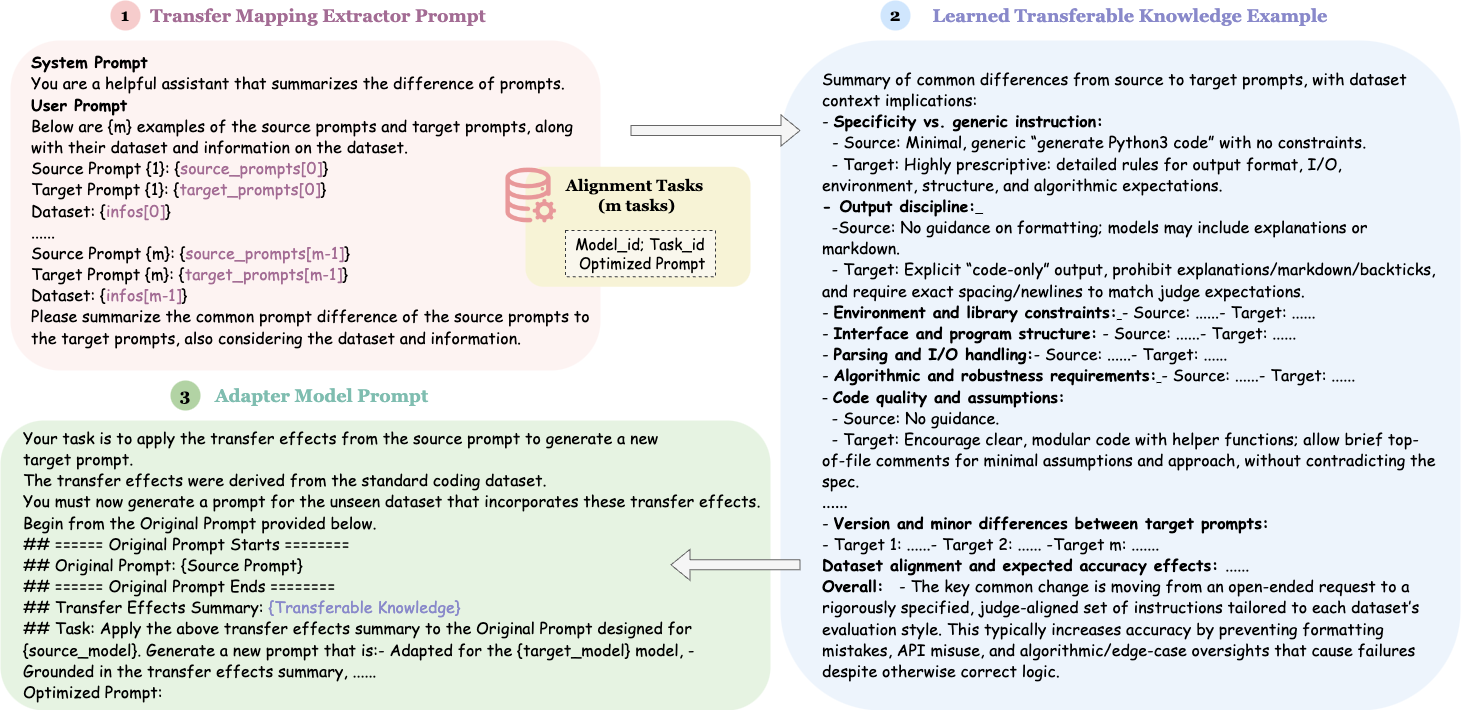

大型语言模型(LLMs)是代码生成、数学推理和基于代理的工作流程等应用的基础。实践中,系统通过商业API或开源部署访问LLM,并且模型格局(例如,GPT、Claude、Llama)迅速发展。这种快速发展迫使人们频繁地切换模型,这受到能力、成本、部署约束和隐私的驱动。然而,Prompt对模型高度敏感:在一个模型上精心设计的Prompt在另一个模型上重用时,通常会产生比针对目标模型优化的Prompt差得多的性能。我们将这种现象称为模型漂移。通过对各种LLM配置进行广泛的实证分析,我们表明模型漂移既普遍又严重。为了应对这一挑战,我们引入了PromptBridge,这是一个无需训练的框架,可以在模型切换下保持Prompt的有效性,从而实现跨模型Prompt迁移,而无需昂贵的每个任务或每个模型的重新优化。PromptBridge只需要一小部分对齐任务进行校准。它首先应用模型自适应反射Prompt进化(MAP-RPE),通过迭代反射细化和定量评估来获得任务和模型特定的最佳Prompt。使用源模型和目标模型的校准Prompt对,PromptBridge学习跨模型Prompt映射。在测试时,即对于未见过的任务,给定源模型Prompt,此映射直接生成目标模型的优化Prompt。在单代理和多代理设置中的实验表明,PromptBridge始终提高下游准确性,同时减少迁移工作。代码即将发布。

🔬 方法详解

问题定义:论文旨在解决大型语言模型(LLMs)之间Prompt迁移的问题。由于不同LLM的架构、训练数据和目标函数存在差异,针对特定模型设计的Prompt在其他模型上的表现往往不佳,即存在“模型漂移”现象。现有的Prompt工程方法通常需要针对每个模型和任务进行重新优化,成本高昂且效率低下。

核心思路:PromptBridge的核心思路是学习一个跨模型的Prompt映射,将针对源模型设计的Prompt自动转换为适用于目标模型的优化Prompt。通过这种方式,可以避免针对每个新模型进行Prompt重新设计的需要,从而降低迁移成本并提高效率。该方法基于一个假设:不同模型之间存在某种Prompt空间的对应关系,可以通过学习来捕捉这种关系。

技术框架:PromptBridge框架主要包含两个阶段:校准阶段和迁移阶段。在校准阶段,首先使用模型自适应反射Prompt进化(MAP-RPE)方法,针对源模型和目标模型,为一组对齐任务生成优化的Prompt对。然后,利用这些Prompt对训练一个跨模型Prompt映射。在迁移阶段,对于新的任务,给定源模型的Prompt,该映射直接生成目标模型的优化Prompt。

关键创新:PromptBridge的关键创新在于提出了一种无需训练的跨模型Prompt迁移方法。与传统的Prompt工程方法相比,PromptBridge不需要针对每个模型和任务进行重新优化,而是通过学习一个通用的Prompt映射来实现跨模型的Prompt迁移。此外,MAP-RPE方法能够有效地生成任务和模型特定的优化Prompt,为Prompt映射的学习提供了高质量的数据。

关键设计:模型自适应反射Prompt进化(MAP-RPE)是PromptBridge的关键组成部分。它通过迭代反射细化和定量评估来获得任务和模型特定的最佳Prompt。具体的实现细节包括:Prompt的表示形式、反射细化的策略、以及定量评估的指标。此外,跨模型Prompt映射的具体形式(例如,线性映射、神经网络)以及训练目标也是重要的设计选择。论文中可能还涉及一些超参数的设置,例如MAP-RPE的迭代次数、Prompt映射的训练轮数等。

🖼️ 关键图片

📊 实验亮点

论文通过在单代理和多代理环境中的实验验证了PromptBridge的有效性。实验结果表明,PromptBridge能够显著提高下游任务的准确性,同时降低模型迁移的成本。具体的性能提升数据和对比基线将在论文中详细展示。该研究为跨模型Prompt迁移提供了一种有效的解决方案。

🎯 应用场景

PromptBridge具有广泛的应用前景,可以应用于各种需要频繁切换LLM的场景,例如:企业内部使用不同LLM API进行任务处理、研究人员探索不同开源LLM的能力、以及在资源受限的设备上部署更轻量级的LLM。该研究有助于降低LLM的使用成本和迁移成本,促进LLM在更多领域的应用。

📄 摘要(原文)

Large language models (LLMs) underpin applications in code generation, mathematical reasoning, and agent-based workflows. In practice, systems access LLMs via commercial APIs or open-source deployments, and the model landscape (e.g., GPT, Claude, Llama) evolves rapidly. This rapid evolution forces frequent model switches driven by capability, cost, deployment constraints, and privacy. Yet prompts are highly model-sensitive: reusing a prompt engineered for one model on another often yields substantially worse performance than a prompt optimized for the target model. We term this phenomenon Model Drifting. Through extensive empirical analysis across diverse LLM configurations, we show that model drifting is both common and severe. To address this challenge, we introduce PromptBridge, a training-free framework that preserves prompt effectiveness under model switches, enabling cross-model prompt transfer without costly per-task or per-model re-optimization. PromptBridge requires only a small set of alignment tasks for calibration. It first applies Model-Adaptive Reflective Prompt Evolution (MAP-RPE) to obtain task- and model-specific optimal prompts via iterative reflective refinement and quantitative evaluation. Using the resulting calibrated prompt pairs for the source and target models, PromptBridge learns a cross-model prompt mapping. At test time, i.e., for an unseen task, given a source-model prompt, this mapping directly produces an optimized prompt for the target model. Experiments in single-agent and multi-agent settings show that PromptBridge consistently improves downstream accuracy while reducing migration effort. The code will be available soon.