W2S-AlignTree: Weak-to-Strong Inference-Time Alignment for Large Language Models via Monte Carlo Tree Search

作者: Zhenyu Ding, Yuhao Wang, Tengyue Xiao, Haoying Wang, Caigui Jiang, Ning Ding

分类: cs.CL

发布日期: 2025-11-14 (更新: 2026-01-01)

备注: AAAI 2026 Oral

💡 一句话要点

提出W2S-AlignTree,通过蒙特卡洛树搜索实现大语言模型推理时对齐。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大语言模型对齐 推理时对齐 蒙特卡洛树搜索 弱到强泛化 文本摘要

📋 核心要点

- 现有大语言模型对齐方法依赖昂贵的专家监督,且缺乏推理时的动态控制,限制了其可扩展性和适应性。

- W2S-AlignTree利用弱模型的实时信号作为对齐代理,结合蒙特卡洛树搜索,在推理时指导强模型的生成。

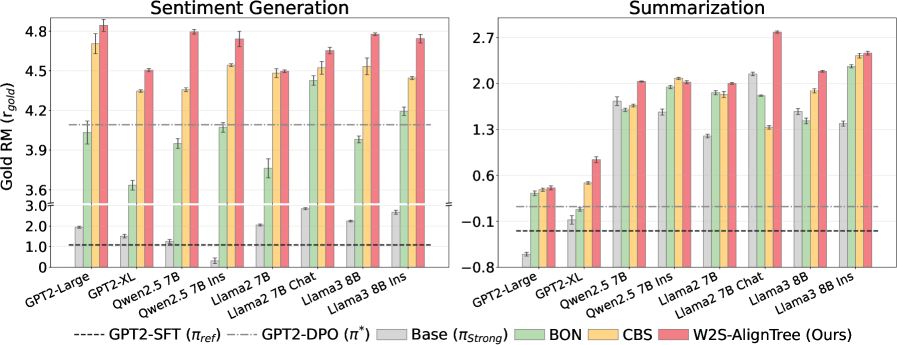

- 实验表明,W2S-AlignTree在情感生成、摘要和指令跟随任务上均优于现有基线,显著提升了模型性能。

📝 摘要(中文)

大型语言模型(LLMs)展现了令人印象深刻的能力,但由于弱监督的不足和缺乏细粒度的控制,其输出常常与人类偏好不一致。训练时对齐方法,如基于人类反馈的强化学习(RLHF),在专家监督方面面临着高昂的成本,并且存在固有的可扩展性限制,在推理过程中提供的动态控制有限。因此,迫切需要可扩展且适应性强的对齐机制。为了解决这个问题,我们提出了W2S-AlignTree,这是一个开创性的即插即用推理时对齐框架,首次将蒙特卡洛树搜索(MCTS)与弱到强泛化范式协同结合。W2S-AlignTree将LLM对齐问题转化为生成搜索树中的最优启发式搜索问题。通过利用弱模型的实时、步级信号作为对齐代理,并引入熵感知探索机制,W2S-AlignTree能够在不修改强模型参数的情况下,在强模型的生成过程中实现细粒度的指导。该方法动态地平衡了高维生成搜索树中的探索和利用。在受控的情感生成、摘要和指令跟随等方面的实验表明,W2S-AlignTree始终优于强大的基线。值得注意的是,W2S-AlignTree将Llama3-8B在摘要任务上的性能从1.89提高到2.19,相对提升了15.9%。

🔬 方法详解

问题定义:论文旨在解决大型语言模型(LLMs)的输出与人类偏好不对齐的问题。现有的对齐方法,如RLHF,依赖于大量的人工标注数据和强化学习训练,成本高昂且难以扩展。此外,这些方法主要在训练阶段进行对齐,缺乏在推理阶段进行动态调整的能力,难以适应不同的任务和用户需求。

核心思路:论文的核心思路是将LLM的对齐问题转化为一个搜索问题,利用蒙特卡洛树搜索(MCTS)在生成空间中寻找最优的生成路径。通过引入一个弱模型,利用其输出的实时信号作为对齐的代理,指导强模型的生成过程。这种弱到强的泛化范式可以在不修改强模型参数的情况下,实现细粒度的对齐控制。

技术框架:W2S-AlignTree框架主要包含以下几个模块:1) 生成树构建:以LLM的初始输出作为根节点,通过LLM的生成过程不断扩展树的节点。2) 弱模型评估:利用弱模型对每个节点的生成结果进行评估,得到一个对齐的奖励信号。3) 蒙特卡洛树搜索:利用MCTS算法,根据弱模型的奖励信号,在生成树中选择最优的节点进行扩展,平衡探索和利用。4) 强模型生成:最终选择的节点作为强模型的输出。

关键创新:W2S-AlignTree的关键创新在于:1) 推理时对齐:首次提出在推理时进行LLM对齐的方法,避免了昂贵的训练成本。2) 弱到强泛化:利用弱模型的信号指导强模型的生成,实现了细粒度的对齐控制。3) 蒙特卡洛树搜索:将LLM对齐问题转化为搜索问题,利用MCTS算法在生成空间中寻找最优解。4) 熵感知探索:引入熵感知机制,鼓励模型探索更多样化的生成路径。

关键设计:W2S-AlignTree的关键设计包括:1) 弱模型的选择:弱模型需要具备一定的对齐能力,但计算成本要远低于强模型。2) 奖励函数的设计:奖励函数需要能够准确反映生成结果与人类偏好之间的差距。3) MCTS的参数设置:需要合理设置MCTS的探索参数,平衡探索和利用。

🖼️ 关键图片

📊 实验亮点

实验结果表明,W2S-AlignTree在情感生成、摘要和指令跟随等任务上均取得了显著的性能提升。例如,在摘要任务中,W2S-AlignTree将Llama3-8B的性能从1.89提高到2.19,相对提升了15.9%。此外,W2S-AlignTree在不同任务和数据集上均表现出良好的泛化能力,证明了其有效性和鲁棒性。

🎯 应用场景

W2S-AlignTree具有广泛的应用前景,可用于各种需要与人类偏好对齐的LLM应用,例如:情感控制的文本生成、高质量的文本摘要、符合用户意图的指令跟随等。该方法能够提升LLM在实际应用中的可用性和用户满意度,并降低人工干预的需求。未来,该方法可以进一步扩展到其他模态,例如图像和语音生成。

📄 摘要(原文)

Large Language Models (LLMs) demonstrate impressive capabilities, yet their outputs often suffer from misalignment with human preferences due to the inadequacy of weak supervision and a lack of fine-grained control. Training-time alignment methods like Reinforcement Learning from Human Feedback (RLHF) face prohibitive costs in expert supervision and inherent scalability limitations, offering limited dynamic control during inference. Consequently, there is an urgent need for scalable and adaptable alignment mechanisms. To address this, we propose W2S-AlignTree, a pioneering plug-and-play inference-time alignment framework that synergistically combines Monte Carlo Tree Search (MCTS) with the Weak-to-Strong Generalization paradigm for the first time. W2S-AlignTree formulates LLM alignment as an optimal heuristic search problem within a generative search tree. By leveraging weak model's real-time, step-level signals as alignment proxies and introducing an Entropy-Aware exploration mechanism, W2S-AlignTree enables fine-grained guidance during strong model's generation without modifying its parameters. The approach dynamically balances exploration and exploitation in high-dimensional generation search trees. Experiments across controlled sentiment generation, summarization, and instruction-following show that W2S-AlignTree consistently outperforms strong baselines. Notably, W2S-AlignTree raises the performance of Llama3-8B from 1.89 to 2.19, a relative improvement of 15.9 on the summarization task.