LaoBench: A Large-Scale Multidimensional Lao Benchmark for Large Language Models

作者: Jian Gao, Richeng Xuan, Zhaolu Kang, Dingshi Liao, Wenxin Huang, Zongmou Huang, Yangdi Xu, Bowen Qin, Zheqi He, Xi Yang, Changjin Li, Yonghua Lin

分类: cs.CL

发布日期: 2025-11-14 (更新: 2026-01-14)

💡 一句话要点

LaoBench:首个大规模多维度老挝语基准评测,用于评估大语言模型的理解与推理能力

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 老挝语 大语言模型 基准评测 低资源语言 多语言评估

📋 核心要点

- 现有大语言模型在低资源语言,特别是老挝语等东南亚语言中的评估不足,限制了其在该地区的实际应用。

- LaoBench通过构建大规模、高质量、多维度的老挝语基准数据集,为评估和提升LLM在老挝语上的能力提供了基础。

- 实验结果表明,即使是强大的多语言模型在文化推理和翻译方面仍落后于人类专家,突显了LaoBench的价值。

📝 摘要(中文)

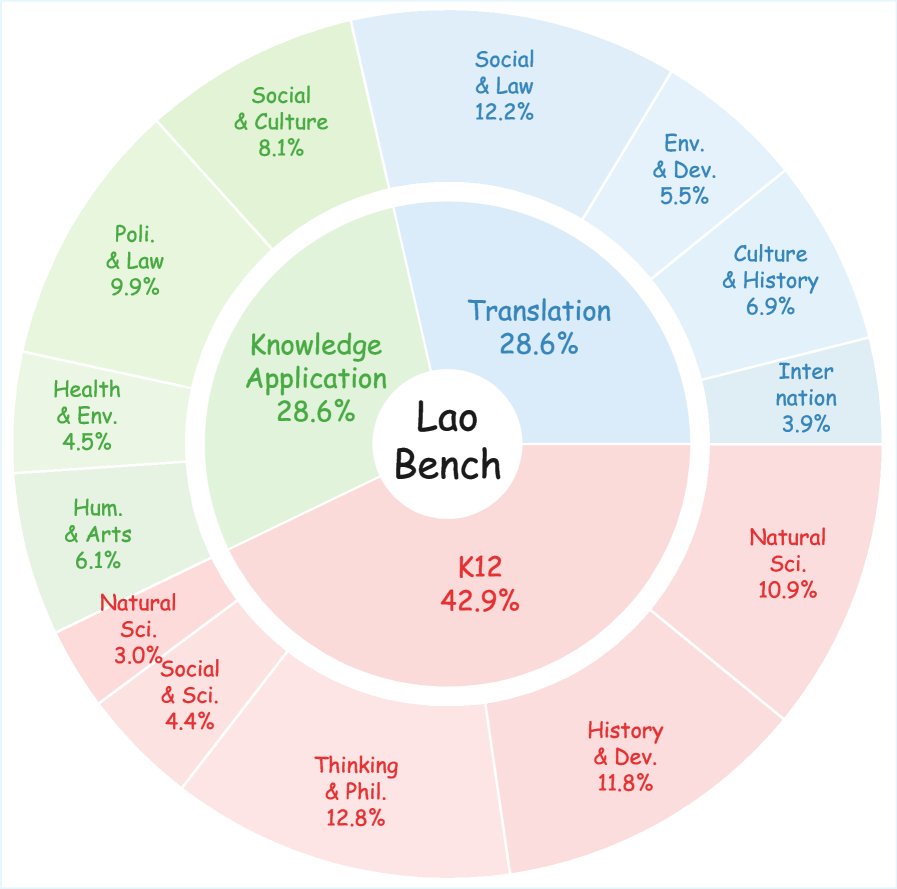

大语言模型(LLMs)的快速发展与它们在低资源语言(特别是老挝语等东南亚语言)中的评估不匹配。为了填补这一空白,我们推出了 extbf{LaoBench},这是第一个大规模、高质量和多维度的基准,用于评估LLM在老挝语中的语言理解和推理能力。LaoBench包含 extbf{17,000+}个由专家策划的样本,涵盖三个维度:文化基础知识应用、课程对齐的K12教育以及老挝语、汉语和英语之间的双语翻译。它包括开源和保留子集,其中保留部分通过受控服务实现安全的黑盒评估,以提高公平性和数据安全性。我们通过结合专家创作和代理辅助验证的混合流程构建LaoBench,确保语言准确性、文化相关性和教育有效性。我们评估了各种最先进的开源和闭源LLM,发现即使是强大的多语言模型也落后于人类专家,尤其是在文化基础推理和翻译保真度方面。我们希望LaoBench能够促进对老挝语和其他代表性不足的东南亚语言的研究,以实现更具包容性的多语言评估。

🔬 方法详解

问题定义:论文旨在解决大语言模型在老挝语等低资源语言上缺乏有效评估基准的问题。现有方法无法充分评估LLM在老挝语的语言理解、推理能力,尤其是在文化背景知识应用和翻译保真度方面,阻碍了LLM在该语言环境下的发展。

核心思路:论文的核心思路是构建一个大规模、高质量、多维度的老挝语基准数据集LaoBench,该数据集涵盖文化基础知识应用、K12教育和双语翻译三个维度,从而全面评估LLM在老挝语上的能力。通过专家创作和代理辅助验证的混合流程,确保数据的准确性、相关性和有效性。

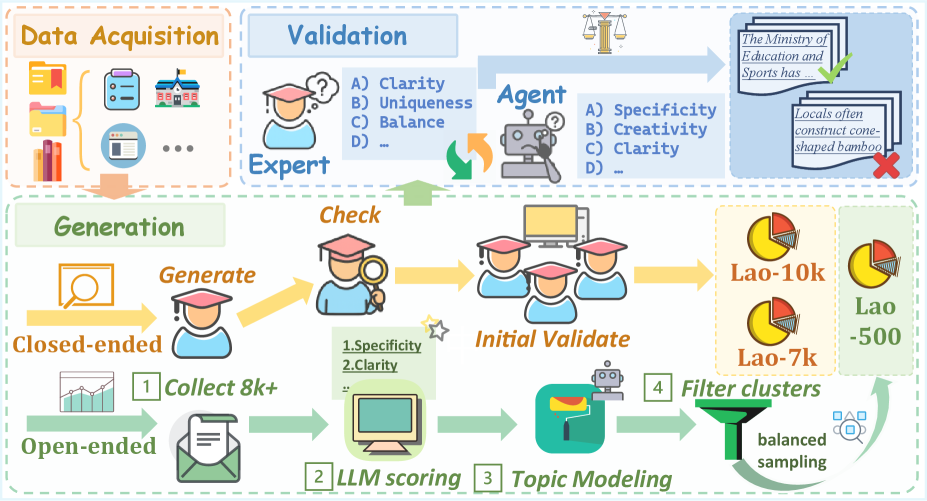

技术框架:LaoBench的构建流程主要包括以下几个阶段: 1. 数据收集与设计:确定三个评估维度,并设计相应的测试用例。 2. 专家创作:由老挝语专家编写高质量的测试样本。 3. 代理辅助验证:利用AI代理辅助验证样本的语言准确性、文化相关性和教育有效性。 4. 数据集划分:将数据集划分为开源和保留子集,保留子集用于安全的黑盒评估。 5. 模型评估:使用LaoBench评估各种开源和闭源LLM的性能。

关键创新:LaoBench的关键创新在于: 1. 大规模和多维度:提供超过17,000个样本,涵盖文化、教育和翻译三个维度,全面评估LLM的能力。 2. 高质量:采用专家创作和代理辅助验证的混合流程,确保数据的准确性和有效性。 3. 安全评估:提供保留子集,支持安全的黑盒评估,提高公平性和数据安全性。 4. 低资源语言:专注于老挝语,填补了低资源语言评估基准的空白。

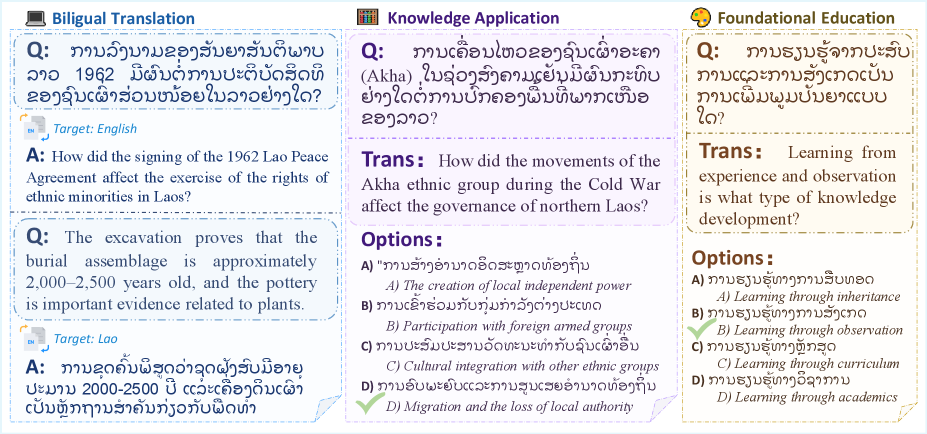

关键设计: 1. 数据维度设计:文化基础知识应用维度侧重于评估LLM对老挝文化习俗、历史事件等知识的理解和应用能力。 2. K12教育维度:涵盖老挝K12教育体系中的各个学科,评估LLM在教育领域的知识掌握和推理能力。 3. 双语翻译维度:包含老挝语、汉语和英语之间的翻译任务,评估LLM的翻译质量和语言理解能力。 4. 混合构建流程:结合专家创作和AI代理辅助验证,确保数据的质量和多样性。

🖼️ 关键图片

📊 实验亮点

实验结果表明,即使是强大的多语言模型在LaoBench上的表现也远低于人类专家,尤其是在文化基础推理和翻译保真度方面。这突显了现有LLM在低资源语言理解和文化适应方面的不足,并强调了LaoBench作为评估工具的重要性。具体性能数据未知,但整体差距明显。

🎯 应用场景

LaoBench的潜在应用领域包括:提升老挝语及其他东南亚低资源语言的机器翻译质量,改进面向老挝语用户的智能教育系统,增强LLM在老挝文化背景下的知识推理能力,促进更具包容性的多语言人工智能发展。该基准的发布将推动相关研究,并为实际应用提供有力支持。

📄 摘要(原文)

The rapid advancement of large language models (LLMs) has not been matched by their evaluation in low-resource languages, especially Southeast Asian languages like Lao. To fill this gap, we introduce \textbf{LaoBench}, the first large-scale, high-quality, and multidimensional benchmark for assessing LLM language understanding and reasoning in Lao. LaoBench contains \textbf{17,000+} expert-curated samples across three dimensions: culturally grounded knowledge application, curriculum-aligned K12 education, and bilingual translation among Lao, Chinese, and English. It includes open-source and held-out subsets, where the held-out portion enables secure black-box evaluation via a controlled service to improve fairness and data security. We construct LaoBench with a hybrid pipeline that combines expert authoring with agent-assisted verification, ensuring linguistic accuracy, cultural relevance, and educational validity. We evaluate diverse state-of-the-art open-source and closed-source LLMs, and find that even strong multilingual models lag behind human experts, particularly in culturally grounded reasoning and translation fidelity. We hope LaoBench will catalyze research on Lao and other underrepresented Southeast Asian languages for more inclusive multilingual evaluation.