KGQuest: Template-Driven QA Generation from Knowledge Graphs with LLM-Based Refinement

作者: Sania Nayab, Marco Simoni, Giulio Rossolini, Andrea Saracino

分类: cs.CL, cs.AI

发布日期: 2025-11-14

💡 一句话要点

KGQuest:提出一种基于知识图谱和LLM优化的模板驱动QA生成方法

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 知识图谱 问答生成 大型语言模型 模板生成 自然语言处理

📋 核心要点

- 现有知识图谱问答生成方法在可扩展性、语言质量和事实一致性方面存在不足。

- 该论文提出了一种基于知识图谱三元组聚类和LLM优化的模板生成方法,以提高QA质量。

- 实验结果表明,该方法能够高效地生成高质量的QA对,兼顾可扩展性、流畅性和语言精确性。

📝 摘要(中文)

本文提出了一种可扩展且确定性的流程,用于从知识图谱(KG)生成自然语言问答(QA),并使用大型语言模型(LLM)进行额外的优化,以进一步提高语言质量。该方法首先基于关系对KG三元组进行聚类,通过从对象和关系的实体类型派生的自然语言规则创建可重用的模板。然后,一个模块利用LLM来优化这些模板,在保持事实准确性的同时提高清晰度和连贯性。最后,通过一种选择策略来实现答案选项的实例化,该策略从KG中引入干扰项。实验表明,这种混合方法有效地生成高质量的QA对,将可扩展性与流畅性和语言精确性相结合。

🔬 方法详解

问题定义:现有知识图谱问答(QA)生成方法面临可扩展性、语言质量和事实一致性方面的挑战。具体来说,大规模知识图谱的QA生成需要高效的模板构建和实例化方法,同时保证生成的问题和答案在语法上流畅、语义上准确,并且与知识图谱中的事实保持一致。

核心思路:该论文的核心思路是结合基于模板的方法和大型语言模型(LLM)的优化能力。首先,通过聚类知识图谱中的三元组,并基于实体类型和关系生成自然语言模板,实现高效的模板构建。然后,利用LLM对模板进行优化,提高语言质量和流畅性,同时确保事实一致性。

技术框架:该方法包含以下几个主要模块:1) KG三元组聚类:根据关系类型对KG三元组进行聚类。2) 模板生成:基于聚类后的三元组,利用自然语言规则生成可重用的模板。3) LLM优化:使用LLM对模板进行优化,提高语言质量和连贯性。4) 答案选项实例化:从KG中选择合适的实体作为答案选项,并引入干扰项。

关键创新:该方法最重要的创新点在于将基于模板的方法与LLM的优化能力相结合。传统的基于模板的方法虽然可扩展性好,但生成的QA语言质量不高。而直接使用LLM生成QA虽然语言质量高,但难以保证事实一致性。该方法通过LLM优化模板,在保证事实一致性的前提下,显著提高了语言质量。

关键设计:在模板生成阶段,论文根据实体类型和关系设计了一系列自然语言规则,用于将KG三元组转换为自然语言描述。在LLM优化阶段,论文使用了prompt engineering技术,引导LLM在不改变语义的前提下,对模板进行润色和改进。在答案选项实例化阶段,论文设计了一种选择策略,从KG中选择与正确答案相关的实体作为干扰项,提高QA的难度。

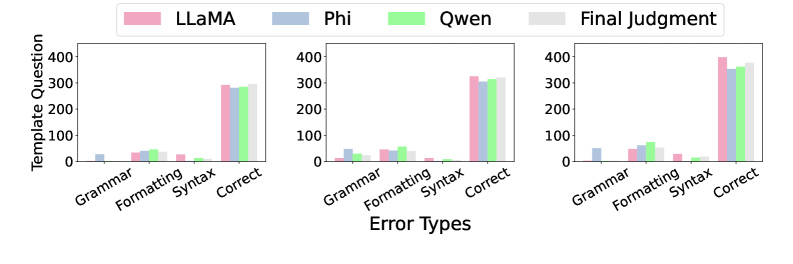

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法能够高效地生成高质量的QA对,在可扩展性、流畅性和语言精确性方面都取得了良好的效果。通过LLM优化,生成的QA在语言质量上显著优于传统的基于模板的方法,同时保持了较高的事实一致性。具体的性能数据(如BLEU score、ROUGE score等)和对比基线(如人工标注数据、其他自动生成方法)的详细结果未知。

🎯 应用场景

该研究成果可应用于教育平台、知识传播工具和大型语言模型的开发与测试。通过自动生成高质量的问答对,可以降低人工标注成本,提高平台的知识覆盖率和用户体验。此外,生成的QA数据还可以用于训练和评估LLM,提高其知识推理和问答能力。

📄 摘要(原文)

The generation of questions and answers (QA) from knowledge graphs (KG) plays a crucial role in the development and testing of educational platforms, dissemination tools, and large language models (LLM). However, existing approaches often struggle with scalability, linguistic quality, and factual consistency. This paper presents a scalable and deterministic pipeline for generating natural language QA from KGs, with an additional refinement step using LLMs to further enhance linguistic quality. The approach first clusters KG triplets based on their relations, creating reusable templates through natural language rules derived from the entity types of objects and relations. A module then leverages LLMs to refine these templates, improving clarity and coherence while preserving factual accuracy. Finally, the instantiation of answer options is achieved through a selection strategy that introduces distractors from the KG. Our experiments demonstrate that this hybrid approach efficiently generates high-quality QA pairs, combining scalability with fluency and linguistic precision.