Automated Analysis of Learning Outcomes and Exam Questions Based on Bloom's Taxonomy

作者: Ramya Kumar, Dhruv Gulwani, Sonit Singh

分类: cs.CL, cs.AI

发布日期: 2025-11-14

备注: 7 Pages

💡 一句话要点

基于Bloom分类法的考试题目与学习成果自动分析方法研究

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: Bloom分类法 机器学习 自然语言处理 文本分类 数据增强 支持向量机 大型语言模型

📋 核心要点

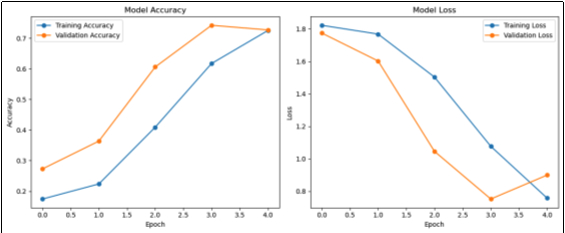

- 现有方法在小数据集上训练复杂深度模型时,容易出现过拟合,影响Bloom分类法的准确性。

- 论文探索了传统机器学习模型、循环神经网络和大型语言模型在Bloom分类任务中的应用,并结合数据增强策略。

- 实验结果表明,数据增强的SVM模型在小数据集上表现优异,而大型语言模型在零样本评估中也展现出一定潜力。

📝 摘要(中文)

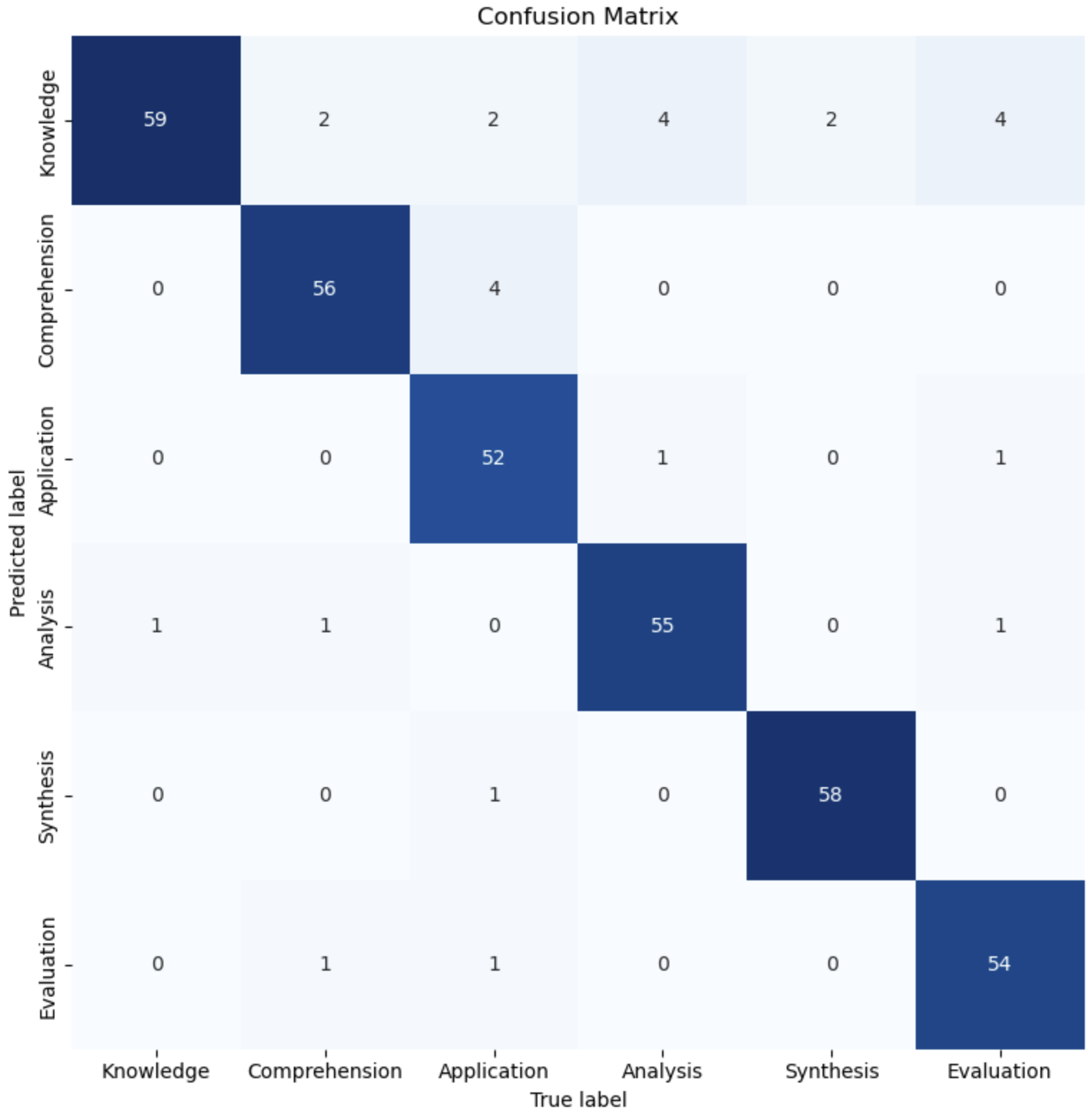

本文探讨了基于Bloom分类法自动分类考试题目和学习成果的方法。使用包含600个句子的数据集,这些句子被标记为六个认知类别——知识、理解、应用、分析、综合和评估。数据集被用于训练传统机器学习模型(朴素贝叶斯、逻辑回归、支持向量机)、循环神经网络架构(LSTM、BiLSTM、GRU、BiGRU)、基于Transformer的模型(BERT和RoBERTa)以及大型语言模型(OpenAI、Gemini、Ollama、Anthropic)。每个模型都在不同的预处理和数据增强策略下进行了评估(例如,同义词替换、词嵌入等)。在传统机器学习方法中,采用数据增强的支持向量机(SVM)取得了最佳的整体性能,在最小过拟合的情况下达到了94%的准确率、召回率和F1分数。相比之下,RNN模型和BERT模型出现了严重的过拟合,而RoBERTa模型最初克服了过拟合,但随着训练的进行也开始出现过拟合的迹象。最后,大型语言模型(LLM)的零样本评估表明,OpenAI和Gemini在测试的LLM中表现最佳,达到了约0.72-0.73的准确率和相当的F1分数。这些发现突出了在有限数据上训练复杂深度模型的挑战,并强调了仔细的数据增强和更简单的算法(如增强的SVM)对于Bloom分类法分类的价值。

🔬 方法详解

问题定义:论文旨在解决考试题目和学习成果的自动分类问题,依据Bloom分类法将其划分为知识、理解、应用、分析、综合和评估六个认知类别。现有方法,特别是深度学习模型,在小规模数据集上容易出现过拟合,导致分类精度下降。

核心思路:论文的核心思路是探索不同类型的机器学习模型(包括传统机器学习、循环神经网络和大型语言模型)在Bloom分类任务中的性能,并结合数据增强技术来缓解小数据集带来的过拟合问题。通过对比不同模型的表现,找到最适合该任务的模型和数据处理策略。

技术框架:整体流程包括数据预处理、模型训练和评估三个主要阶段。数据预处理包括文本清洗、分词等操作。模型训练阶段,分别训练了朴素贝叶斯、逻辑回归、支持向量机、LSTM、BiLSTM、GRU、BiGRU、BERT、RoBERTa以及大型语言模型(OpenAI、Gemini、Ollama、Anthropic)。评估阶段,使用准确率、召回率和F1分数等指标来评估模型的性能。

关键创新:论文的关键创新在于对多种机器学习模型在Bloom分类任务中的全面评估,并强调了数据增强在小数据集上的重要性。实验结果表明,在数据增强的加持下,传统的支持向量机模型可以达到与深度学习模型相媲美的性能,甚至优于某些深度学习模型。

关键设计:论文采用了多种数据增强策略,如同义词替换等,以扩充数据集规模,缓解过拟合问题。对于大型语言模型,采用了零样本评估的方式,直接评估模型在未见过的数据上的泛化能力。对于支持向量机,使用了线性核函数,并调整了正则化参数以防止过拟合。

🖼️ 关键图片

📊 实验亮点

实验结果表明,经过数据增强的支持向量机(SVM)模型在Bloom分类任务中取得了最佳的整体性能,达到了94%的准确率、召回率和F1分数,且过拟合现象较轻。大型语言模型(如OpenAI和Gemini)在零样本评估中也表现出一定的竞争力,准确率约为0.72-0.73。

🎯 应用场景

该研究成果可应用于教育领域,例如自动评估考试题目的难度和类型,辅助教师设计更合理的教学计划,以及为学生提供个性化的学习建议。此外,该方法还可以用于分析课程大纲和学习材料,确保其覆盖各个认知层次,从而提高教学质量。

📄 摘要(原文)

This paper explores the automatic classification of exam questions and learning outcomes according to Bloom's Taxonomy. A small dataset of 600 sentences labeled with six cognitive categories - Knowledge, Comprehension, Application, Analysis, Synthesis, and Evaluation - was processed using traditional machine learning (ML) models (Naive Bayes, Logistic Regression, Support Vector Machines), recurrent neural network architectures (LSTM, BiLSTM, GRU, BiGRU), transformer-based models (BERT and RoBERTa), and large language models (OpenAI, Gemini, Ollama, Anthropic). Each model was evaluated under different preprocessing and augmentation strategies (for example, synonym replacement, word embeddings, etc.). Among traditional ML approaches, Support Vector Machines (SVM) with data augmentation achieved the best overall performance, reaching 94 percent accuracy, recall, and F1 scores with minimal overfitting. In contrast, the RNN models and BERT suffered from severe overfitting, while RoBERTa initially overcame it but began to show signs as training progressed. Finally, zero-shot evaluations of large language models (LLMs) indicated that OpenAI and Gemini performed best among the tested LLMs, achieving approximately 0.72-0.73 accuracy and comparable F1 scores. These findings highlight the challenges of training complex deep models on limited data and underscore the value of careful data augmentation and simpler algorithms (such as augmented SVM) for Bloom's Taxonomy classification.