Effectiveness of Chain-of-Thought in Distilling Reasoning Capability from Large Language Models

作者: Cong-Thanh Do, Rama Doddipatla, Kate Knill

分类: cs.CL

发布日期: 2025-11-07

备注: In proceedings of the 18th International Natural Language Generation Conference (INLG 2025)

💡 一句话要点

利用思维链蒸馏提升小模型在自然语言推理任务上的性能

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 思维链 知识蒸馏 大型语言模型 自然语言推理 白盒蒸馏

📋 核心要点

- 大型语言模型推理能力强大,但计算成本高昂,如何将这些能力迁移到小型模型是一个挑战。

- 论文采用白盒知识蒸馏,利用思维链(CoT)数据,将大型模型的推理能力迁移到小型模型。

- 实验表明,使用CoT数据进行蒸馏,能有效提升小型模型在自然语言推理任务上的性能。

📝 摘要(中文)

本文研究了思维链(CoT)提示在知识蒸馏(KD)中,将大型语言模型(LLM)的推理能力迁移到小型LLM上的有效性。通过白盒KD,分析了CoT在提升蒸馏模型在各种自然语言推理和理解任务上的性能的作用。我们使用Qwen和Llama2系列的LLM进行了白盒KD实验,并采用了来自CoT-Collection数据集的CoT数据。然后,在BIG-Bench-Hard(BBH)基准测试中的自然语言推理和理解任务上评估了蒸馏模型,该基准测试对较小的LLM提出了复杂的挑战。实验结果表明,CoT在提高白盒KD有效性方面发挥了作用,使蒸馏模型能够在BBH中的自然语言推理和理解任务中获得更好的平均性能。

🔬 方法详解

问题定义:论文旨在解决如何有效地将大型语言模型(LLM)的推理能力迁移到小型LLM的问题。现有方法在知识蒸馏过程中,可能无法充分利用LLM的推理过程信息,导致小型模型性能提升有限。

核心思路:论文的核心思路是利用思维链(Chain-of-Thought, CoT)作为桥梁,将大型LLM的推理过程显式地传递给小型LLM。CoT提供了一种逐步推理的路径,使得小型模型能够学习到大型模型解决问题的中间步骤,从而更好地理解和模仿其推理能力。

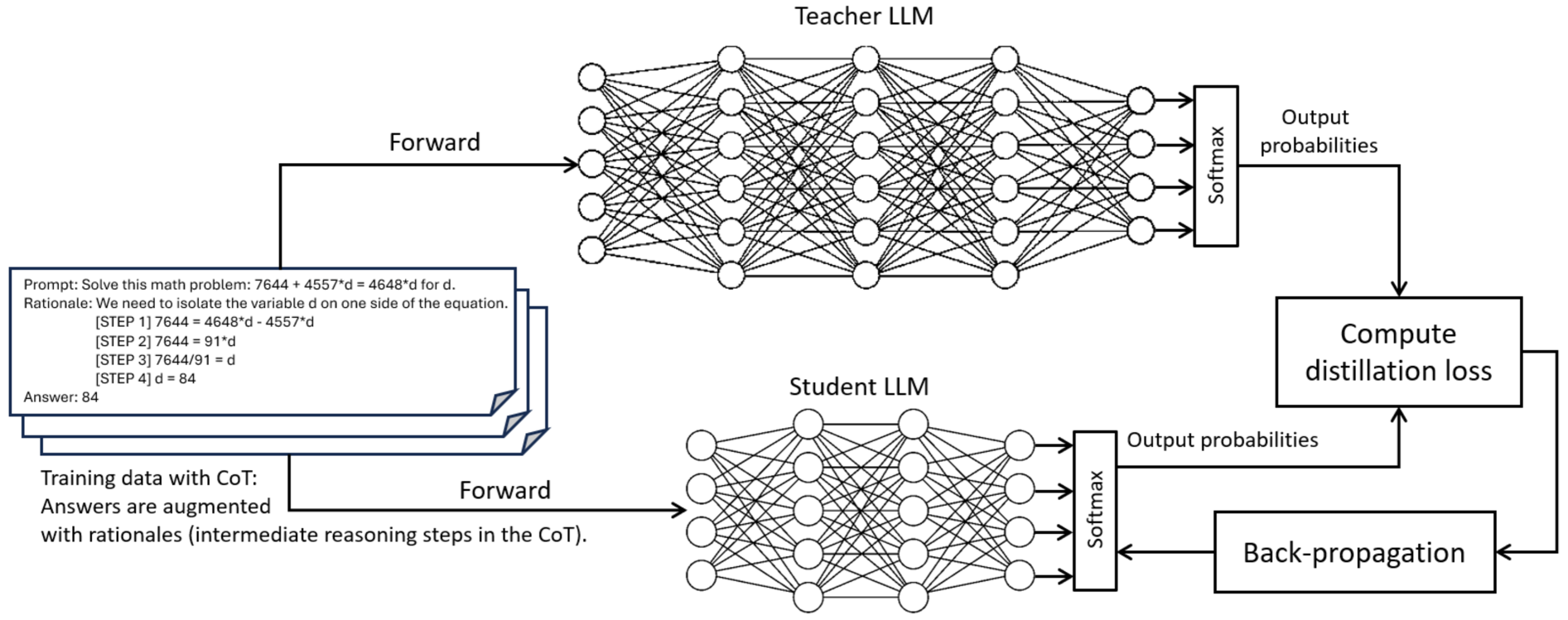

技术框架:整体框架包括以下几个阶段:1) 使用大型LLM生成CoT数据,即针对特定任务,生成包含推理步骤的文本;2) 使用生成的CoT数据,通过白盒知识蒸馏训练小型LLM;3) 在BIG-Bench-Hard (BBH) 基准测试上评估蒸馏后的小型LLM的性能。框架中主要涉及大型LLM(教师模型)、小型LLM(学生模型)和CoT数据。

关键创新:论文的关键创新在于将CoT与白盒知识蒸馏相结合,用于提升小型LLM的推理能力。与传统的知识蒸馏方法相比,该方法不仅传递了最终的预测结果,还传递了推理过程,使得小型模型能够更好地学习到大型模型的推理策略。

关键设计:论文使用了来自CoT-Collection数据集的CoT数据,并选择了Qwen和Llama2系列的大型LLM和小型LLM进行实验。白盒知识蒸馏的具体实现细节(如损失函数、训练参数等)在论文中可能有所描述,但摘要中未明确提及。关键在于如何有效地利用CoT数据来指导小型模型的训练,使其能够模仿大型模型的推理过程。

🖼️ 关键图片

📊 实验亮点

实验结果表明,利用CoT进行白盒知识蒸馏能够有效提升小型模型在BBH基准测试上的性能。具体提升幅度未在摘要中给出,但强调了CoT在提高蒸馏有效性方面的作用,使得蒸馏模型在自然语言推理和理解任务中取得了更好的平均性能。

🎯 应用场景

该研究成果可应用于各种需要自然语言推理和理解能力的场景,例如智能客服、问答系统、文本摘要、机器翻译等。通过将大型模型的推理能力蒸馏到小型模型,可以在资源受限的环境中部署高性能的AI应用,降低计算成本和延迟,并促进AI技术的普及。

📄 摘要(原文)

Chain-of-Thought (CoT) prompting is a widely used method to improve the reasoning capability of Large Language Models (LLMs). More recently, CoT has been leveraged in Knowledge Distillation (KD) to transfer reasoning capability from a larger LLM to a smaller one. This paper examines the role of CoT in distilling the reasoning capability from larger LLMs to smaller LLMs using white-box KD, analysing its effectiveness in improving the performance of the distilled models for various natural language reasoning and understanding tasks. We conduct white-box KD experiments using LLMs from the Qwen and Llama2 families, employing CoT data from the CoT-Collection dataset. The distilled models are then evaluated on natural language reasoning and understanding tasks from the BIG-Bench-Hard (BBH) benchmark, which presents complex challenges for smaller LLMs. Experimental results demonstrate the role of CoT in improving white-box KD effectiveness, enabling the distilled models to achieve better average performance in natural language reasoning and understanding tasks from BBH.