Mind the Gap... or Not? How Translation Errors and Evaluation Details Skew Multilingual Results

作者: Jan-Thorsten Peter, David Vilar, Tobias Domhan, Dan Malkin, Markus Freitag

分类: cs.CL

发布日期: 2025-11-07

💡 一句话要点

揭示多语言LLM数学能力评估偏差:翻译错误与答案提取影响显著

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多语言LLM 机器翻译 数据质量 评估偏差 数学问题 自动质量保证 答案提取

📋 核心要点

- 现有研究表明LLM在多语言数学问题上存在性能差距,但未充分考虑数据质量和评估方法的影响。

- 本研究通过分析MGSM数据集中的翻译错误和答案提取方式,揭示了这些因素对评估结果的潜在偏差。

- 通过自动质量保证和标准化答案提取,显著缩小了LLM在不同语言上的性能差距,并发布了修正后的数据集。

📝 摘要(中文)

当前的大型语言模型(LLM)除了英语外,还支持多种语言,包括高资源语言(如德语、中文、法语)和低资源语言(如斯瓦希里语、泰卢固语)。 它们在编码、科学和数学等不同领域也表现出令人印象深刻的能力。 本文以数学为例,研究了不同LLM在各种语言中的性能。 实验结果表明,模型在不同语言之间的性能存在不可忽略且一致的差距。 有趣的是,与预期相反,这种差距在高资源和低资源语言中都存在。 我们希望这些结果能够影响下一代LLM的跨语言能力泛化研究。 然而,事实并非如此! 通过分析一个标准的Multilingual Grade School Math (MGSM)基准,我们发现数据中存在多个翻译错误。 此外,缺乏从LLM输出中标准化答案提取方法进一步影响了最终结果。 我们提出了一种自动质量保证方法来大规模解决第一个问题,并为解决第二个问题提供建议。 结合这两种方法,我们表明上述语言差距基本消失,从而得出与我们研究完全不同的结论。 我们还向社区发布了更正后的数据集。

🔬 方法详解

问题定义:论文旨在解决多语言LLM在数学问题上的性能评估偏差问题。现有方法在评估LLM的跨语言能力时,往往忽略了数据集本身的质量问题,例如翻译错误,以及评估流程中答案提取方式的不一致性,导致评估结果失真。

核心思路:论文的核心思路是,通过识别并纠正多语言数学数据集中的翻译错误,并采用标准化的答案提取方法,来消除评估偏差,从而更准确地评估LLM的跨语言数学能力。论文认为,数据质量和评估方法是影响多语言LLM性能评估的关键因素。

技术框架:论文的技术框架主要包含两个部分:一是自动质量保证方法,用于检测和纠正数据集中的翻译错误;二是标准化答案提取方法,用于从LLM的输出中提取答案。具体流程包括:1) 对多语言数学数据集进行自动翻译质量评估,识别潜在的翻译错误;2) 人工审核并纠正识别出的翻译错误;3) 设计并实施标准化的答案提取方法,确保从LLM输出中提取答案的一致性;4) 使用修正后的数据集和标准化的答案提取方法,重新评估LLM的跨语言数学能力。

关键创新:论文的关键创新在于,它强调了数据质量和评估方法对多语言LLM性能评估的重要性,并提出了相应的解决方案。与现有方法相比,论文不仅关注LLM本身的能力,还关注数据集的质量和评估流程的合理性,从而更全面地评估LLM的跨语言能力。

关键设计:论文提出了一个自动质量保证流程,用于检测和纠正翻译错误。具体实现细节未知,但可以推测可能使用了机器翻译质量评估指标(如BLEU、METEOR等)或基于规则的方法来识别潜在的翻译错误。此外,论文还强调了标准化答案提取的重要性,但具体的标准化方法细节未知,可能包括正则表达式匹配、规则提取等。

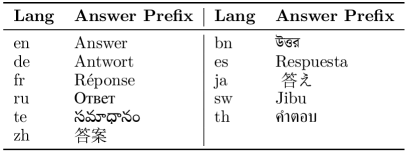

🖼️ 关键图片

📊 实验亮点

通过修正MGSM数据集中的翻译错误并采用标准化的答案提取方法,论文表明原本观察到的LLM在不同语言上的性能差距显著缩小,甚至基本消失。这表明先前报告的性能差距可能很大程度上是由于数据质量和评估方法造成的,而非LLM本身的能力差异。

🎯 应用场景

该研究成果可应用于更可靠地评估和提升多语言LLM的性能,尤其是在数学、科学等需要精确理解的领域。修正后的数据集和评估方法有助于推动跨语言LLM的研究,并为开发更公平、更准确的多语言AI系统提供参考。

📄 摘要(原文)

Most current large language models (LLMs) support a wide variety of languages in addition to English, including high-resource languages (e.g. German, Chinese, French), as well as low-resource ones (e.g. Swahili, Telugu). In addition they have also shown impressive capabilities in different domains, like coding, science and math. In this short paper, taking math as an example domain, we study the performance of different LLMs across languages. Experimental results show that there exists a non-negligible and consistent gap in the performance of the models across languages. Interestingly, and somewhat against expectations, the gap exists for both high- and low-resource languages. We hope that these results influence further research into cross-lingual capability generalization for next generation LLMs. If it weren't for the fact that they are false! By analyzing one of the standard multilingual math benchmarks (MGSM), we determine that several translation errors are present in the data. Furthermore, the lack of standardized answer extraction from LLM outputs further influences the final results. We propose a method for automatic quality assurance to address the first issue at scale, and give recommendations to address the second one. Combining these two approaches we show that the aforementioned language gap mostly disappears, leading to completely different conclusions from our research. We additionally release the corrected dataset to the community.