Iterative Layer-wise Distillation for Efficient Compression of Large Language Models

作者: Grigory Kovalev, Mikhail Tikhomirov

分类: cs.CL, cs.LG

发布日期: 2025-11-07

💡 一句话要点

提出迭代层蒸馏方法,用于高效压缩大型语言模型,在性能损失可控下显著减少模型层数。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型压缩 模型蒸馏 层重要性评估 迭代优化 知识迁移

📋 核心要点

- 现有LLM蒸馏方法在压缩模型的同时,难以维持高性能,尤其是在层数大幅减少的情况下。

- 提出迭代层蒸馏方法,通过迭代评估并移除不重要的层,结合KL散度和MSE损失进行微调。

- 实验表明,该方法能在Qwen2.5-3B模型上有效减少层数,同时将性能损失控制在可接受范围内。

📝 摘要(中文)

本文研究了大型语言模型(LLMs)的蒸馏方法,旨在开发保持高性能的紧凑模型。回顾了几种现有方法,并讨论了它们各自的优点和局限性。在ShortGPT方法的基础上,开发了一种改进的方法,该方法结合了层重要性的迭代评估。在每个步骤中,通过测量移除单个层时的性能下降来评估重要性,使用一组具有代表性的数据集。此过程与使用基于KL散度和均方误差的联合损失函数的进一步训练相结合。在Qwen2.5-3B模型上的实验表明,层数可以从36层减少到28层(从而产生一个24.7亿参数的模型),而质量损失仅为9.7%,减少到24层时损失为18%。研究结果表明,中间Transformer层对推理的贡献较小,突出了所提出的方法在创建高效模型方面的潜力。结果证明了迭代蒸馏和微调的有效性,使该方法适用于资源受限的部署环境。

🔬 方法详解

问题定义:论文旨在解决大型语言模型(LLMs)压缩的问题,即如何在显著减少模型参数量(特别是层数)的同时,尽可能地保持模型的性能。现有的蒸馏方法通常难以在压缩率较高的情况下维持性能,或者需要复杂的训练策略。

核心思路:论文的核心思路是通过迭代地评估每一层的重要性,并移除那些对性能影响较小的层,从而实现模型的压缩。这种迭代评估能够更精确地识别冗余层,避免一次性移除可能导致性能急剧下降的关键层。同时,结合蒸馏和微调,进一步提升压缩后模型的性能。

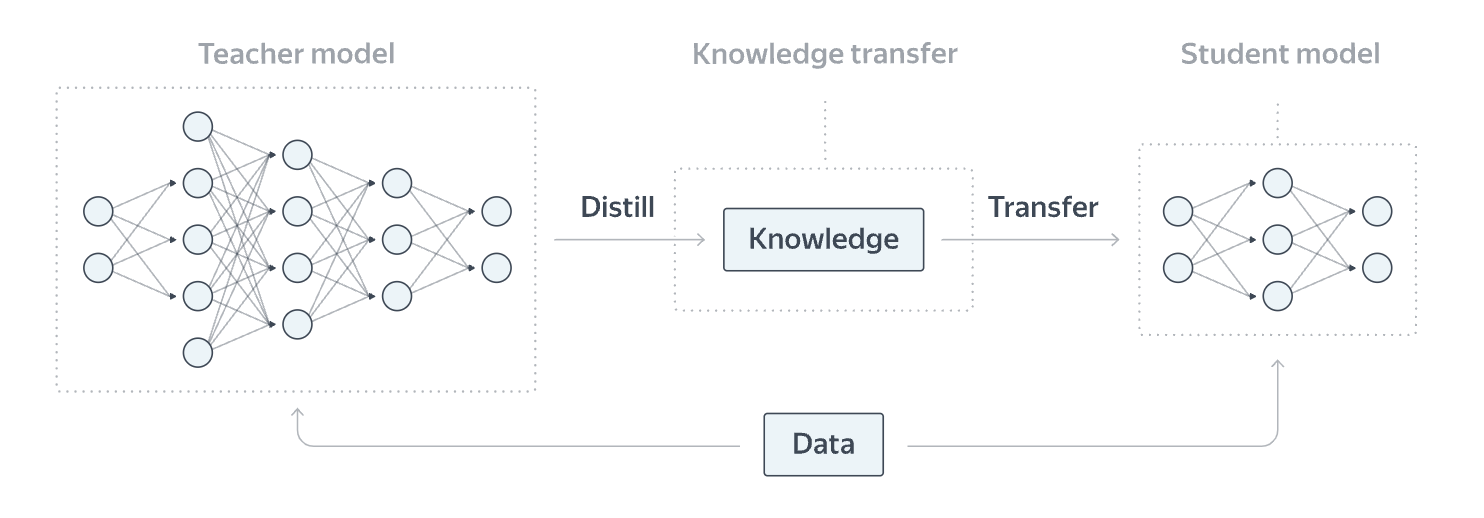

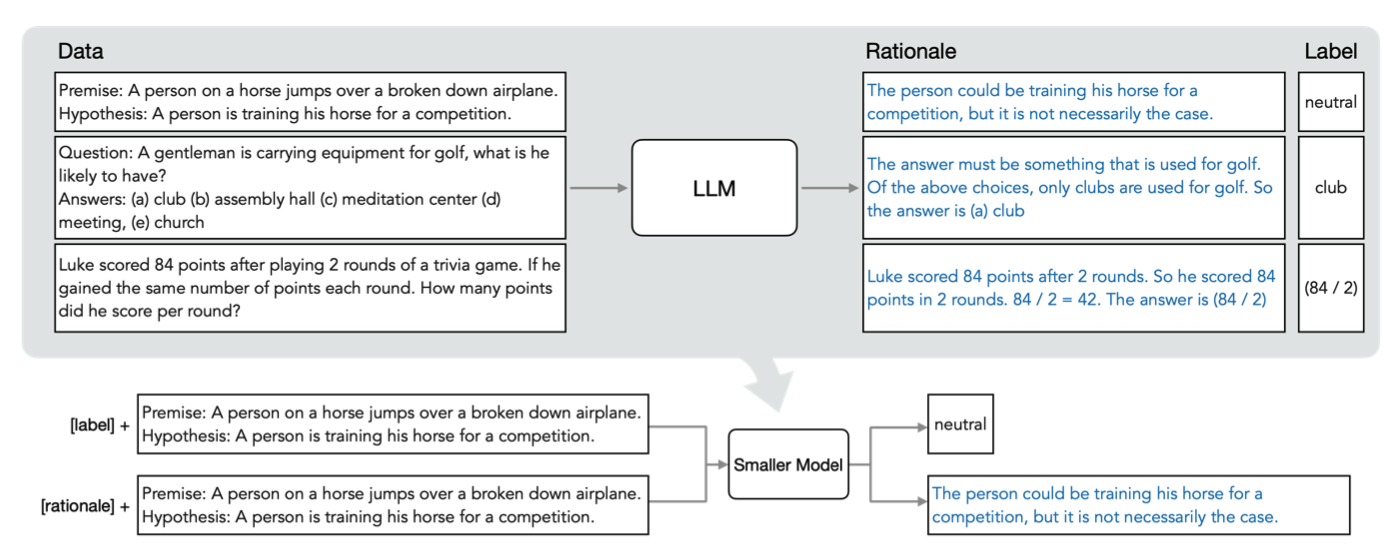

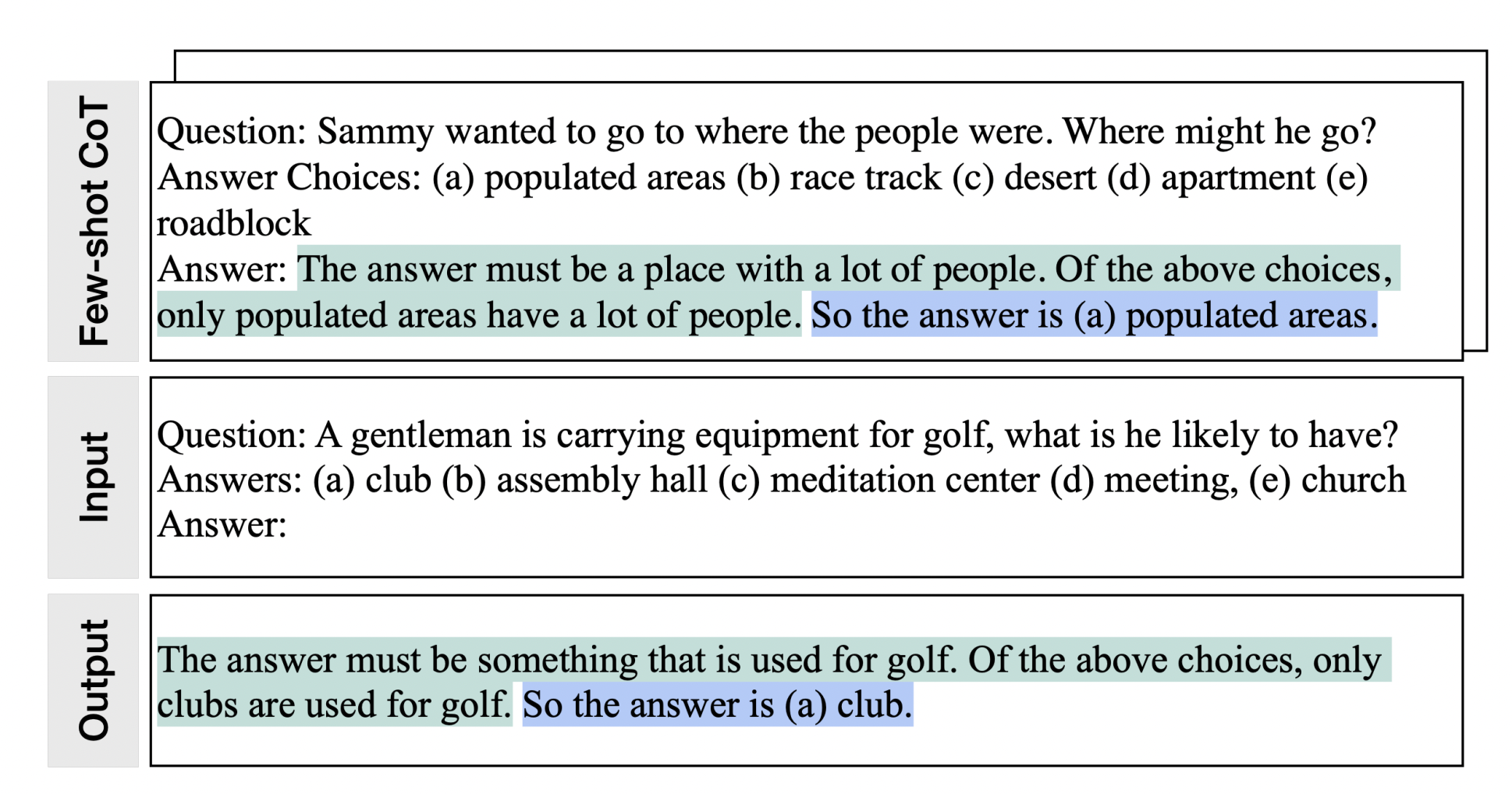

技术框架:整体流程包括以下几个主要阶段:1) 初始化: 使用预训练的LLM作为教师模型。2) 迭代层评估: 循环执行以下步骤:a) 移除单个层,评估模型在验证集上的性能下降;b) 根据性能下降程度,计算每一层的重要性得分;c) 移除重要性最低的层。3) 蒸馏与微调: 使用KL散度和均方误差(MSE)作为联合损失函数,对压缩后的模型进行蒸馏和微调,使其模仿教师模型的行为。

关键创新:最重要的技术创新点在于迭代的层重要性评估方法。与传统的单次评估或启发式规则相比,迭代评估能够更准确地识别冗余层,并允许在移除层后进行微调,从而更好地保持模型性能。此外,结合KL散度和MSE损失的联合损失函数也有助于提升蒸馏效果。

关键设计:在层重要性评估中,使用一组具有代表性的数据集来测量移除单个层时的性能下降。KL散度损失用于使学生模型的输出分布接近教师模型的输出分布,而MSE损失用于使学生模型的隐藏层表示接近教师模型的隐藏层表示。具体的层移除策略和微调的超参数(如学习率、batch size等)需要根据具体模型和数据集进行调整。

🖼️ 关键图片

📊 实验亮点

实验结果表明,在Qwen2.5-3B模型上,使用该方法可以将层数从36层减少到28层,参数量减少至24.7亿,而质量损失仅为9.7%。进一步减少到24层时,损失为18%。这表明该方法能够在显著压缩模型的同时,保持相对较高的性能水平,优于一些现有的蒸馏方法。

🎯 应用场景

该研究成果可应用于资源受限的场景,例如移动设备、边缘计算等,使得大型语言模型能够在这些平台上高效部署。此外,压缩后的模型可以降低推理成本,提高服务效率,适用于在线问答、文本生成等应用。未来,该方法可以进一步扩展到其他类型的深度学习模型,并与其他模型压缩技术相结合。

📄 摘要(原文)

This work investigates distillation methods for large language models (LLMs) with the goal of developing compact models that preserve high performance. Several existing approaches are reviewed, with a discussion of their respective strengths and limitations. An improved method based on the ShortGPT approach has been developed, building upon the idea of incorporating iterative evaluation of layer importance. At each step, importance is assessed by measuring performance degradation when individual layers are removed, using a set of representative datasets. This process is combined with further training using a joint loss function based on KL divergence and mean squared error. Experiments on the Qwen2.5-3B model show that the number of layers can be reduced from 36 to 28 (resulting in a 2.47 billion parameter model) with only a 9.7% quality loss, and to 24 layers with an 18% loss. The findings suggest that the middle transformer layers contribute less to inference, underscoring the potential of the proposed method for creating efficient models. The results demonstrate the effectiveness of iterative distillation and fine-tuning, making the approach suitable for deployment in resource-limited settings.