LoPT: Lossless Parallel Tokenization Acceleration for Long Context Inference of Large Language Model

作者: Wei Shao, Lingchao Zheng, Pengyu Wang, Peizhen Zheng, Jun Li, Yuwei Fan

分类: cs.CL

发布日期: 2025-11-07

💡 一句话要点

LoPT:面向大语言模型长文本推理的无损并行分词加速框架

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 并行分词 长文本推理 大语言模型 无损加速 Tokenization 字符位置匹配 动态分块

📋 核心要点

- 现有并行分词方法在加速长文本处理时,由于分块边界效应,合并后的分词结果与串行分词不一致。

- LoPT框架通过字符位置匹配和动态调整分块长度,保证并行分词结果与串行分词结果完全一致,实现无损加速。

- 实验表明,LoPT在多种长文本数据集上实现了显著的加速效果,并提供了理论证明和分析验证其鲁棒性。

📝 摘要(中文)

针对大语言模型长文本推理中计算延迟问题,本文提出了一种新颖的无损并行分词框架LoPT,旨在解决现有并行分词方法因边界伪影导致结果不一致的问题。LoPT通过基于字符位置的匹配和动态块长度调整,确保分词结果与标准串行分词完全一致。大量长文本数据集上的实验表明,LoPT在保证无损分词的同时,显著提高了分词速度。此外,本文还提供了理论一致性证明和全面的分析研究,以验证该方法的鲁棒性。

🔬 方法详解

问题定义:论文旨在解决大语言模型长文本推理过程中,tokenization环节存在的性能瓶颈问题。现有的并行tokenization方法虽然能够加速处理过程,但由于文本分段引入的边界效应,导致最终的tokenization结果与标准的串行tokenization结果不一致,影响了模型的推理精度。

核心思路:LoPT的核心思路是保证并行tokenization的无损性,即确保其输出结果与串行tokenization完全一致。为此,LoPT通过精确控制分块边界,并采用基于字符位置的匹配策略,来消除边界效应带来的影响。动态调整chunk长度进一步优化了并行效率。

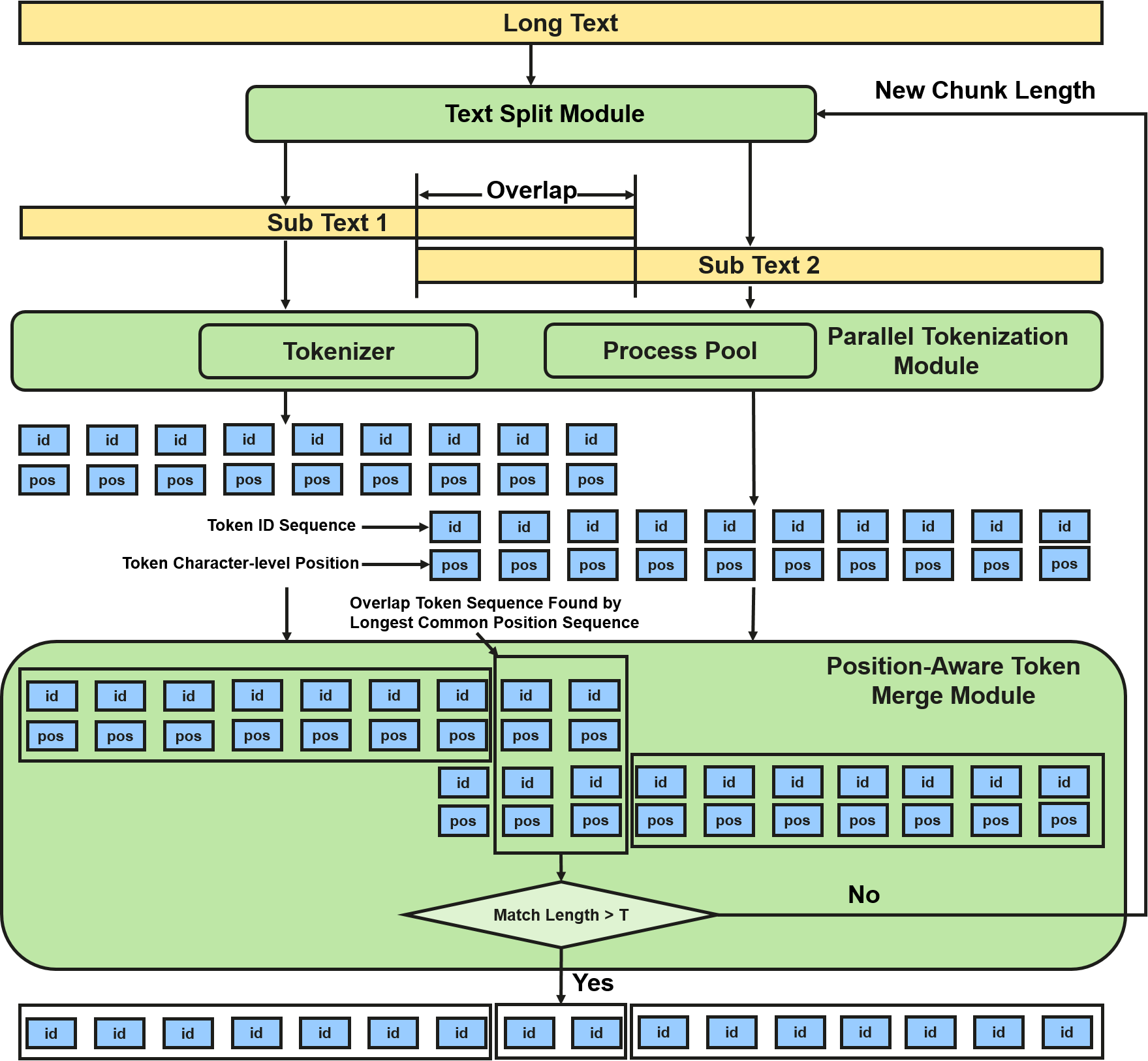

技术框架:LoPT框架主要包含以下几个阶段:1) 文本分块:将输入文本分割成多个chunk,以便进行并行处理。2) 并行Tokenization:对每个chunk独立进行tokenization。3) 边界对齐:通过字符位置匹配,对相邻chunk的tokenization结果进行对齐,消除边界效应。4) 结果合并:将对齐后的token序列合并成最终的token序列。

关键创新:LoPT的关键创新在于其无损性保证。与现有并行tokenization方法不同,LoPT通过字符位置匹配和动态chunk长度调整,确保最终的token序列与串行tokenization的结果完全一致。这种无损性保证了模型的推理精度,避免了因tokenization差异带来的性能损失。

关键设计:LoPT的关键设计包括:1) 字符位置匹配:在合并相邻chunk的token序列时,LoPT会根据字符位置信息,精确匹配相邻token,消除边界效应。2) 动态chunk长度调整:LoPT会根据文本的特点,动态调整chunk的长度,以优化并行效率。具体调整策略未知,论文中可能未详细描述。

🖼️ 关键图片

📊 实验亮点

LoPT在多种长文本数据集上进行了实验,结果表明,LoPT能够在保证tokenization结果无损的前提下,显著提高tokenization的速度。具体的加速比例和对比基线未知,但摘要中提到实现了“significant speedup”,表明性能提升较为明显。理论分析也验证了LoPT的一致性和鲁棒性。

🎯 应用场景

LoPT可广泛应用于需要处理长文本的大语言模型推理场景,例如长文档摘要、长篇小说生成、代码生成等。通过加速tokenization过程,LoPT能够显著降低推理延迟,提高用户体验。此外,LoPT的无损性保证了模型的推理精度,使其能够更好地应用于对精度要求较高的场景。未来,LoPT有望成为大语言模型推理加速的重要组成部分。

📄 摘要(原文)

Long context inference scenarios have become increasingly important for large language models, yet they introduce significant computational latency. While prior research has optimized long-sequence inference through operators, model architectures, and system frameworks, tokenization remains an overlooked bottleneck. Existing parallel tokenization methods accelerate processing through text segmentation and multi-process tokenization, but they suffer from inconsistent results due to boundary artifacts that occur after merging. To address this, we propose LoPT, a novel Lossless Parallel Tokenization framework that ensures output identical to standard sequential tokenization. Our approach employs character-position-based matching and dynamic chunk length adjustment to align and merge tokenized segments accurately. Extensive experiments across diverse long-text datasets demonstrate that LoPT achieves significant speedup while guaranteeing lossless tokenization. We also provide theoretical proof of consistency and comprehensive analytical studies to validate the robustness of our method.