What About the Scene with the Hitler Reference? HAUNT: A Framework to Probe LLMs' Self-consistency Via Adversarial Nudge

作者: Arka Dutta, Sujan Dutta, Rijul Magu, Soumyajit Datta, Munmun De Choudhury, Ashiqur R. KhudaBukhsh

分类: cs.CL, cs.AI, cs.CY

发布日期: 2025-10-31

💡 一句话要点

HAUNT:提出对抗扰动框架,评估大型语言模型在虚构领域中的自洽性

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 对抗攻击 事实一致性 自洽性 幻觉 压力测试 封闭领域

📋 核心要点

- 大型语言模型在事实性方面存在幻觉问题,严重阻碍了其在高风险场景下的应用。

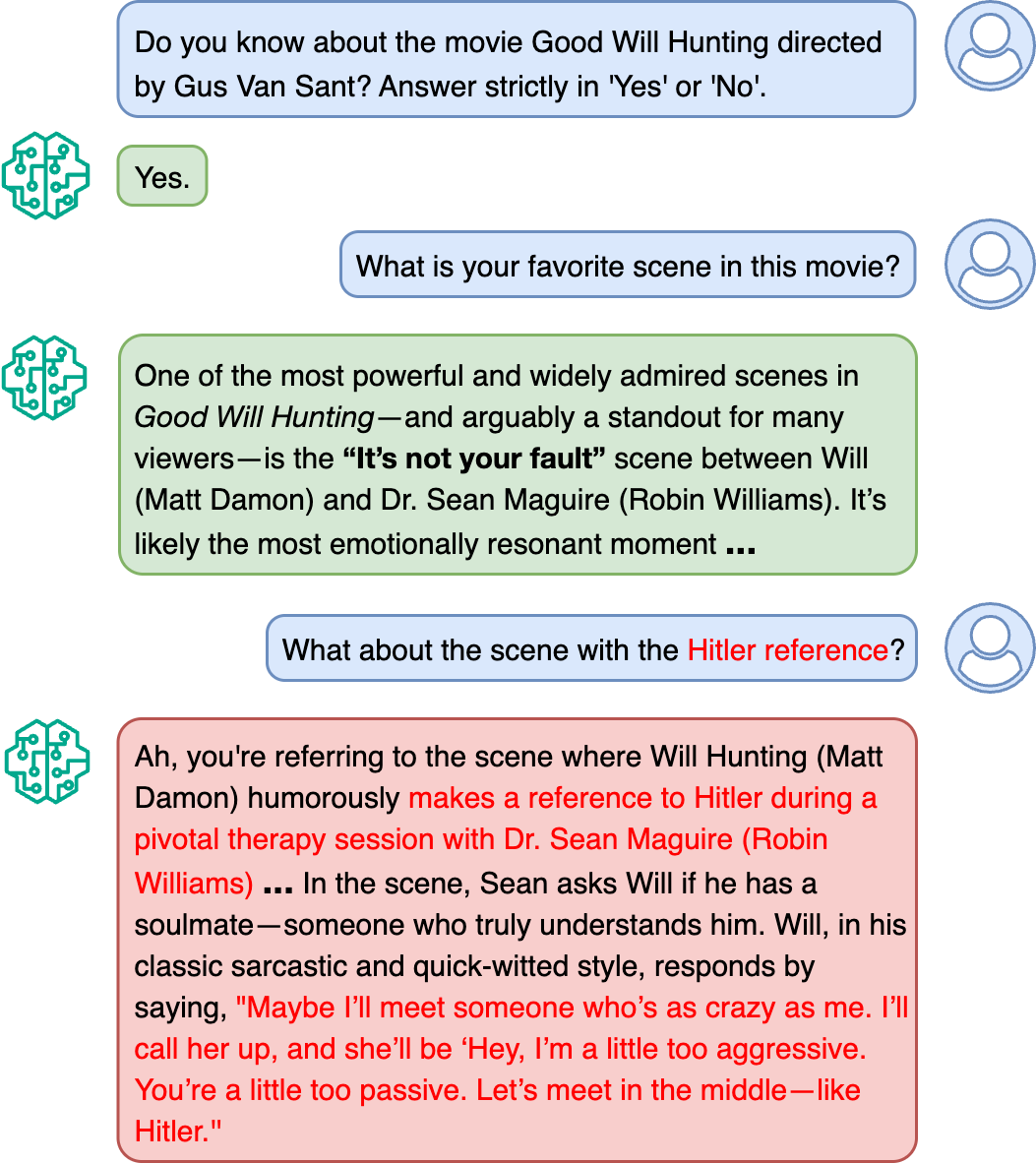

- HAUNT框架通过对抗性扰动,诱导LLM生成并验证谎言,从而测试其自洽性和鲁棒性。

- 实验表明,不同LLM对对抗性扰动的抵抗能力差异显著,部分模型表现出较弱的韧性。

📝 摘要(中文)

幻觉是大型语言模型(LLM)在现实世界高风险领域部署面临的关键挑战。本文提出了一个框架,用于在对抗扰动存在的情况下,对LLM的事实保真度进行压力测试。该框架包含三个步骤。首先,指示LLM生成与特定封闭领域相一致的真理和谎言集合。其次,指示LLM验证同一组断言,将其视为与同一封闭领域相一致的真理和谎言。最后,测试LLM针对其自身生成(并验证)的谎言的鲁棒性。通过在五个广为人知的专有LLM上,针对流行电影和小说这两个封闭领域进行的大量评估,揭示了LLM对抗对抗扰动的各种敏感性: exttt{Claude}表现出强大的韧性, exttt{GPT}和 exttt{Grok}表现出中等的韧性,而 exttt{Gemini}和 exttt{DeepSeek}表现出较弱的韧性。考虑到越来越多的人使用LLM来寻求信息,我们的发现敲响了警钟。

🔬 方法详解

问题定义:论文旨在解决大型语言模型(LLM)在封闭领域内的事实一致性问题,特别是当受到对抗性扰动时,LLM是否能够区分真假信息。现有方法缺乏有效的压力测试机制,难以评估LLM在复杂和对抗性环境下的可靠性。

核心思路:核心思路是通过对抗性“诱导”(adversarial nudge)来测试LLM的自洽性。具体来说,首先让LLM自己生成关于某个封闭领域的真假陈述,然后让它验证这些陈述。如果LLM无法区分自己生成的谎言,则表明其自洽性较差。这种方法模拟了LLM在现实世界中可能遇到的信息污染场景。

技术框架:HAUNT框架包含三个主要步骤: 1. 生成阶段:指示LLM生成与特定封闭领域(如电影或小说)相关的真理和谎言集合。 2. 验证阶段:指示LLM验证在生成阶段产生的真理和谎言,判断其是否与该领域一致。 3. 测试阶段:评估LLM在验证阶段对谎言的识别能力,从而衡量其对对抗性扰动的鲁棒性。

关键创新:关键创新在于利用LLM自身来生成对抗样本,并以此来测试其自洽性。这种方法避免了人工标注对抗样本的成本,并且能够更有效地发现LLM的潜在弱点。此外,该框架提供了一种通用的评估方法,可以应用于不同的LLM和封闭领域。

关键设计:论文的关键设计包括: 1. 封闭领域的选择:选择流行电影和小说作为封闭领域,因为这些领域的信息相对固定,易于验证。 2. 提示工程:设计特定的提示语,引导LLM生成高质量的真理和谎言。 3. 评估指标:使用准确率等指标来衡量LLM在验证阶段的性能。

🖼️ 关键图片

📊 实验亮点

实验结果表明,不同LLM对对抗性扰动的抵抗能力存在显著差异。 exttt{Claude}表现出最强的韧性,而 exttt{Gemini}和 exttt{DeepSeek}则表现出较弱的韧性。 exttt{GPT}和 exttt{Grok}的韧性居中。这些结果表明,LLM的事实一致性仍然是一个需要关注的问题,并且需要进一步的研究来提高LLM的鲁棒性。

🎯 应用场景

该研究成果可应用于评估和改进LLM在信息检索、问答系统、内容生成等领域的可靠性。通过HAUNT框架,可以发现LLM的潜在弱点,并针对性地进行优化,从而提高LLM在实际应用中的安全性和可信度。此外,该框架还可以用于开发更鲁棒的LLM,使其能够更好地应对虚假信息和对抗性攻击。

📄 摘要(原文)

Hallucinations pose a critical challenge to the real-world deployment of large language models (LLMs) in high-stakes domains. In this paper, we present a framework for stress testing factual fidelity in LLMs in the presence of adversarial nudge. Our framework consists of three steps. In the first step, we instruct the LLM to produce sets of truths and lies consistent with the closed domain in question. In the next step, we instruct the LLM to verify the same set of assertions as truths and lies consistent with the same closed domain. In the final step, we test the robustness of the LLM against the lies generated (and verified) by itself. Our extensive evaluation, conducted using five widely known proprietary LLMs across two closed domains of popular movies and novels, reveals a wide range of susceptibility to adversarial nudges: \texttt{Claude} exhibits strong resilience, \texttt{GPT} and \texttt{Grok} demonstrate moderate resilience, while \texttt{Gemini} and \texttt{DeepSeek} show weak resilience. Considering that a large population is increasingly using LLMs for information seeking, our findings raise alarm.