Training LLMs Beyond Next Token Prediction -- Filling the Mutual Information Gap

作者: Chun-Hao Yang, Bo-Han Feng, Tzu-Yuan Lai, Yan Yu Chen, Yin-Kai Dean Huang, Shou-De Lin

分类: cs.CL, cs.AI

发布日期: 2025-10-31

💡 一句话要点

提出基于互信息差距填充的LLM训练方法,提升模型性能。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 LLM训练 互信息 Token选择 信息丰富 自然语言处理 模型优化

📋 核心要点

- 传统LLM训练依赖于下一个token预测,效率可能受限,未能充分利用信息丰富的token。

- 论文提出一种新的训练策略,通过预测信息量更大的token来优化LLM训练过程。

- 实验表明,该方法在算术、多标签文本分类和自然语言生成任务中均有性能提升。

📝 摘要(中文)

本文挑战了使用下一个token预测(NTP)训练大型语言模型(LLM)的传统方法,认为通过在训练期间预测信息丰富的token,可以更有效地训练LLM。该研究探讨了所提出的解决方案在LLM的三种任务中的影响:算术、文本的多标签分类和自然语言生成。这项工作提供了一种优化LLM训练的原则性方法,从而提升模型性能和对目标token选择策略的理论理解。

🔬 方法详解

问题定义:当前大型语言模型(LLM)的训练主要依赖于下一个token预测(Next Token Prediction, NTP)。这种方法的痛点在于,并非所有token都包含相同的信息量,简单地预测下一个token可能无法充分利用训练数据中的信息,导致训练效率低下,模型性能提升受限。

核心思路:论文的核心思路是,并非所有token都同等重要,选择信息量更大的token进行预测,可以更有效地训练LLM。通过关注信息丰富的token,模型可以更快地学习到重要的语言模式和知识,从而提高整体性能。这种方法旨在弥补传统NTP方法中存在的互信息差距。

技术框架:论文提出的训练框架主要包括以下几个阶段:首先,对输入文本进行分析,识别出信息量较大的token。然后,修改传统的训练目标,将重点放在预测这些信息丰富的token上。最后,使用标准的优化算法(如Adam)对模型进行训练。具体实现可能涉及不同的token选择策略和损失函数设计。

关键创新:该论文的关键创新在于,它挑战了LLM训练中普遍采用的NTP范式,并提出了一种基于信息量选择token的训练方法。与传统方法相比,该方法能够更有效地利用训练数据中的信息,从而提高模型的学习效率和性能。这种方法的核心在于如何准确地识别和选择信息丰富的token。

关键设计:论文的关键设计可能包括:1) 如何定义和衡量token的信息量(例如,基于互信息、熵等指标);2) 如何选择信息丰富的token(例如,设定阈值、使用采样方法等);3) 如何修改损失函数以更好地优化信息丰富token的预测(例如,对信息丰富token的预测赋予更高的权重);4) 具体的网络结构可能没有显著变化,但训练策略的改变是核心。

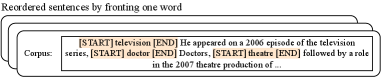

🖼️ 关键图片

📊 实验亮点

论文通过实验验证了所提出方法的有效性,在算术、多标签文本分类和自然语言生成等任务中均取得了性能提升。具体的性能数据和提升幅度需要在论文中查找。实验结果表明,选择信息丰富的token进行训练可以显著提高LLM的学习效率和泛化能力,优于传统的NTP方法。

🎯 应用场景

该研究成果可应用于各种需要高效训练LLM的场景,例如自然语言处理、机器翻译、文本生成和对话系统等。通过更有效地利用训练数据,可以降低训练成本,提高模型性能,从而加速LLM在各个领域的应用和发展。该方法还有助于更好地理解LLM的学习机制,为未来的模型设计提供指导。

📄 摘要(原文)

Optimizing training performance in large language models (LLMs) remains an essential challenge, particularly in improving model performance while maintaining computational costs. This work challenges the conventional approach of training LLMs using next-token prediction (NTP), arguing that by predicting information-rich tokens during training, there is a more effective way to train LLMs. We investigate the impact of the proposed solution in three kinds of tasks for LLMs: arithmetic, multi-label classification of text, and natural-language generation. This work offers a principled approach to optimizing LLM training, advancing both model performance and theoretical understanding of the target-token selection strategies.