Beyond a Million Tokens: Benchmarking and Enhancing Long-Term Memory in LLMs

作者: Mohammad Tavakoli, Alireza Salemi, Carrie Ye, Mohamed Abdalla, Hamed Zamani, J Ross Mitchell

分类: cs.CL, cs.AI, cs.IR

发布日期: 2025-10-31

💡 一句话要点

提出LIGHT框架,增强LLM在长程对话中的记忆能力,并构建BEAM基准评测模型性能。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 长程对话 记忆增强 大型语言模型 基准测试 情景记忆 工作记忆 LIGHT框架

📋 核心要点

- 现有LLM基准测试在长程对话中缺乏叙事连贯性,领域单一,且仅关注简单回忆,无法有效评估长时记忆能力。

- LIGHT框架模拟人类认知,通过长期情景记忆、短期工作记忆和草稿本,增强LLM在长程对话中的记忆能力。

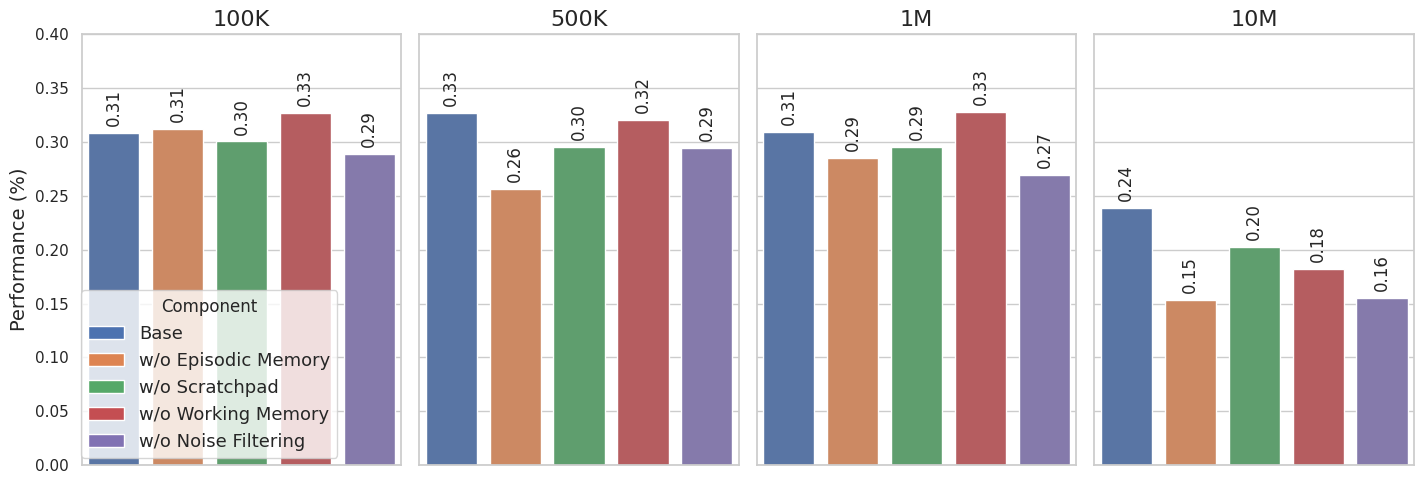

- 实验表明,LIGHT框架显著提升了LLM在BEAM基准上的性能,平均提升3.5%-12.69%,证明了其有效性。

📝 摘要(中文)

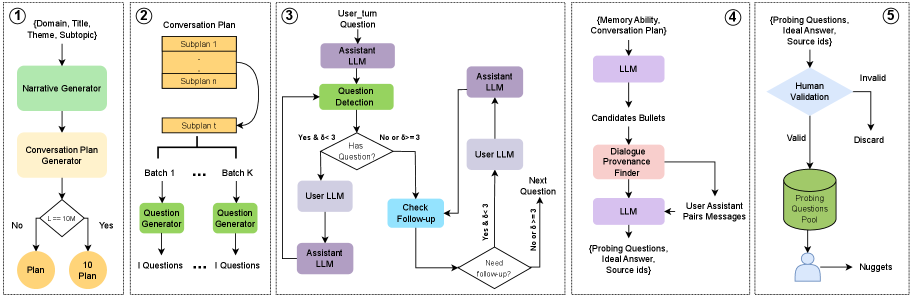

本文旨在解决现有基准在评估大型语言模型(LLM)长时记忆和长文本推理能力方面的不足,尤其是在对话场景中,现有基准缺乏叙事连贯性、领域狭窄且仅测试简单的回忆任务。为此,本文提出了一套全面的解决方案。首先,提出了一个新框架,用于自动生成长(高达1000万tokens)、连贯且主题多样的对话,并附带针对各种记忆能力的问题。基于此,构建了一个名为BEAM的新基准,包含100个对话和2000个验证问题。其次,为了提高模型性能,提出了LIGHT框架,该框架受到人类认知启发,为LLM配备了三个互补的记忆系统:长期情景记忆、短期工作记忆和一个用于积累显著事实的草稿本。在BEAM上的实验表明,即使具有100万token上下文窗口的LLM(无论是否使用检索增强)在对话变长时也表现不佳。相比之下,LIGHT始终如一地提高了各种模型的性能,根据骨干LLM的不同,平均比最强的基线提高了3.5%-12.69%。消融研究进一步证实了每个记忆组件的贡献。

🔬 方法详解

问题定义:论文旨在解决大型语言模型(LLM)在处理需要长时记忆和长文本推理的对话任务时,现有评估基准的不足。现有基准通常缺乏叙事连贯性,覆盖的领域范围狭窄,并且主要测试简单的回忆能力,无法全面评估LLM的记忆能力。这些局限性使得评估LLM在实际对话场景中的表现变得困难。

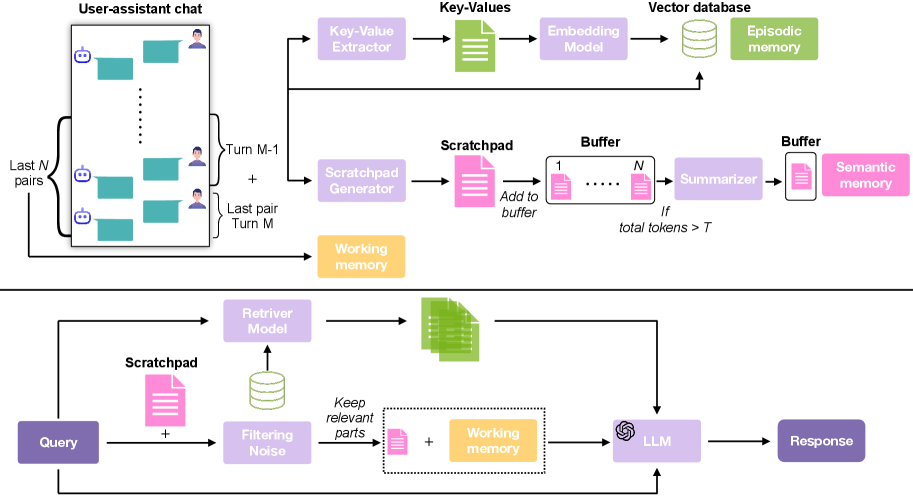

核心思路:论文的核心思路是模拟人类的认知过程,为LLM配备多个互补的记忆系统,包括长期情景记忆、短期工作记忆和一个用于积累重要事实的草稿本。这种设计旨在使LLM能够更好地理解和记住对话中的关键信息,从而提高其在长程对话中的表现。LIGHT框架的设计灵感来源于人类大脑处理信息的方式,通过不同的记忆模块协同工作,实现更有效的记忆和推理。

技术框架:LIGHT框架包含三个主要模块:长期情景记忆(Long-Term Episodic Memory)、短期工作记忆(Short-Term Working Memory)和草稿本(Scratchpad)。长期情景记忆用于存储对话中的关键事件和信息;短期工作记忆用于处理当前对话轮次的信息,并与长期记忆进行交互;草稿本用于记录和积累对话中出现的显著事实。整个框架的流程是:首先,LLM接收到新的对话输入;然后,短期工作记忆处理当前输入,并从长期情景记忆中检索相关信息;接着,草稿本记录重要的事实;最后,LLM基于这三个记忆模块的信息生成回复。

关键创新:LIGHT框架的关键创新在于其多模块记忆系统的设计,该设计模拟了人类的认知过程,使得LLM能够更有效地处理和记忆长程对话中的信息。与传统的单模块记忆方法相比,LIGHT框架能够更好地捕捉对话中的上下文关系,并提高LLM的推理能力。此外,BEAM基准的提出也为评估LLM的长时记忆能力提供了一个新的、更全面的平台。

关键设计:LIGHT框架的具体实现细节包括:长期情景记忆可以使用向量数据库(例如FAISS)来存储对话信息,并使用相似度搜索来检索相关信息;短期工作记忆可以使用Transformer模型来处理当前对话轮次的信息;草稿本可以使用简单的文本存储方式来记录重要事实。损失函数的设计可以包括对话生成损失和记忆一致性损失,以确保LLM生成的回复与记忆中的信息保持一致。具体的参数设置需要根据不同的LLM和数据集进行调整。

🖼️ 关键图片

📊 实验亮点

实验结果表明,LIGHT框架在BEAM基准上显著提升了LLM的性能,平均提升幅度为3.5%-12.69%,优于现有的基线方法。消融实验进一步验证了每个记忆组件的贡献,证明了LIGHT框架的有效性。即使是具有100万token上下文窗口的LLM,在长程对话中也表现不佳,而LIGHT框架能够有效缓解这一问题。

🎯 应用场景

该研究成果可应用于智能客服、聊天机器人、虚拟助手等领域,提升LLM在长程对话中的理解和生成能力,使其能够更好地记住对话历史,提供更个性化和连贯的服务。未来,该技术有望应用于更复杂的任务,如故事生成、知识问答等,推动人机交互的发展。

📄 摘要(原文)

Evaluating the abilities of large language models (LLMs) for tasks that require long-term memory and thus long-context reasoning, for example in conversational settings, is hampered by the existing benchmarks, which often lack narrative coherence, cover narrow domains, and only test simple recall-oriented tasks. This paper introduces a comprehensive solution to these challenges. First, we present a novel framework for automatically generating long (up to 10M tokens), coherent, and topically diverse conversations, accompanied by probing questions targeting a wide range of memory abilities. From this, we construct BEAM, a new benchmark comprising 100 conversations and 2,000 validated questions. Second, to enhance model performance, we propose LIGHT-a framework inspired by human cognition that equips LLMs with three complementary memory systems: a long-term episodic memory, a short-term working memory, and a scratchpad for accumulating salient facts. Our experiments on BEAM reveal that even LLMs with 1M token context windows (with and without retrieval-augmentation) struggle as dialogues lengthen. In contrast, LIGHT consistently improves performance across various models, achieving an average improvement of 3.5%-12.69% over the strongest baselines, depending on the backbone LLM. An ablation study further confirms the contribution of each memory component.