Inference-Cost-Aware Dynamic Tree Construction for Efficient Inference in Large Language Models

作者: Yinrong Hong, Zhiquan Tan, Kai Hu

分类: cs.CL, cs.LG

发布日期: 2025-10-30

💡 一句话要点

提出CAST:一种推理成本感知的动态树构建方法,提升大语言模型推理效率

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大语言模型 推理加速 推测解码 动态树构建 推理成本感知

📋 核心要点

- 现有动态树结构的推测解码方法忽略了GPU配置、批大小等关键系统变量对推理成本的影响。

- CAST方法通过考虑GPU配置和批大小等推理成本因素,动态优化解码树结构,提升推理效率。

- 实验结果表明,CAST方法在多个任务和LLM上,推理速度比传统解码方法快5.2倍,且优于现有SOTA方法5%-20%。

📝 摘要(中文)

大型语言模型(LLMs)由于其自回归设计和庞大的规模,面临着显著的推理延迟挑战。为了解决这个问题,推测解码作为一种解决方案应运而生,它能够同时生成和验证多个token。虽然最近的方法,如EAGLE-2和EAGLE-3,利用动态树结构改进了推测解码,但它们常常忽略了诸如GPU设备和批大小等关键系统变量的影响。因此,我们提出了一种新的动态树解码方法,称为CAST,它考虑了包括GPU配置和批大小等因素在内的推理成本,以动态地优化树结构。通过在六个不同的任务和六个不同的LLM上进行的全面实验,我们的方法展示了显著的结果,实现了比传统解码方法快5.2倍的速度。此外,它通常优于现有最先进的技术5%到20%。

🔬 方法详解

问题定义:论文旨在解决大型语言模型(LLMs)推理过程中由于自回归特性和模型规模庞大导致的推理延迟问题。现有的动态树解码方法,如EAGLE-2和EAGLE-3,虽然尝试通过动态构建树结构来加速推理,但它们忽略了实际部署环境中关键的系统变量,例如GPU配置和批大小,这些因素直接影响推理成本,从而限制了加速效果。

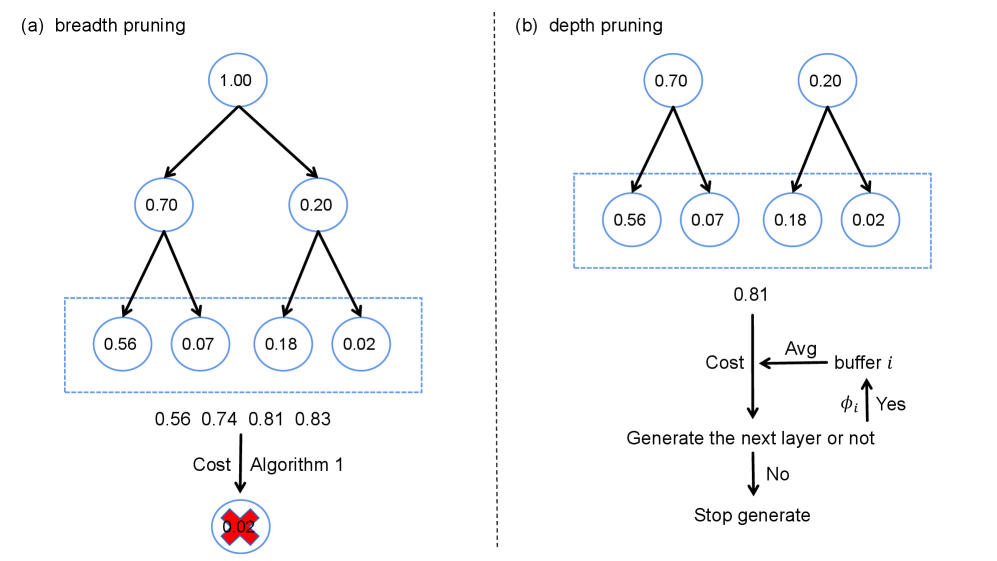

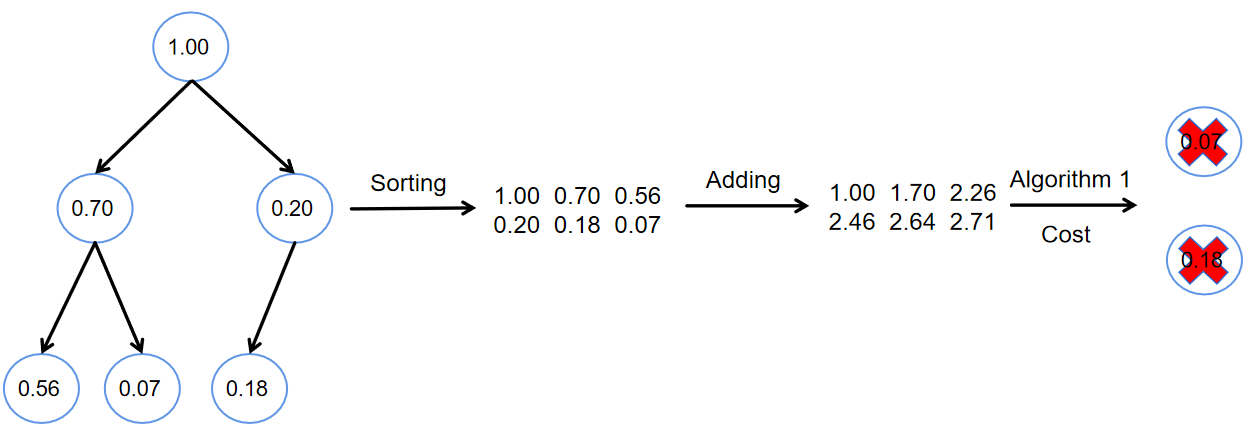

核心思路:论文的核心思路是设计一种推理成本感知的动态树构建方法。该方法通过显式地考虑GPU配置、批大小等因素对推理成本的影响,动态地调整解码树的结构,使得在给定的硬件和软件环境下,能够以最小的成本获得最大的推理加速。这样可以避免盲目地扩展树的深度或宽度,从而更有效地利用计算资源。

技术框架:CAST方法的整体框架包含以下几个主要阶段:1) 成本建模:首先,对不同GPU配置和批大小下的推理成本进行建模,建立成本预测模型。2) 树结构搜索:然后,基于成本模型,动态地搜索最优的树结构,目标是在给定的成本预算下,最大化推测解码的加速效果。3) 推测解码:最后,利用搜索到的最优树结构进行推测解码,生成多个候选token,并进行验证。

关键创新:CAST方法最重要的技术创新点在于其推理成本感知的动态树构建策略。与现有方法不同,CAST不是盲目地扩展树结构,而是根据实际的推理成本进行优化。这种成本感知的策略使得CAST能够更好地适应不同的硬件和软件环境,从而获得更高的推理加速效果。

关键设计:CAST的关键设计包括:1) 成本预测模型:使用历史推理数据训练成本预测模型,用于预测不同GPU配置和批大小下的推理成本。2) 树结构搜索算法:设计高效的树结构搜索算法,例如基于动态规划的搜索算法,在给定的成本预算下,找到最优的树结构。3) 自适应调整策略:根据实际的推理性能,自适应地调整成本预测模型和树结构搜索算法的参数。

🖼️ 关键图片

📊 实验亮点

实验结果表明,CAST方法在六个不同的任务和六个不同的LLM上,实现了显著的推理加速效果。与传统的解码方法相比,CAST方法实现了高达5.2倍的加速。此外,CAST方法在大多数情况下优于现有的最先进技术,例如EAGLE-2和EAGLE-3,性能提升幅度在5%到20%之间。这些结果表明,CAST方法是一种有效的推理加速方法。

🎯 应用场景

CAST方法可广泛应用于需要快速推理的大型语言模型应用场景,例如在线对话系统、机器翻译、文本摘要等。通过降低推理延迟,可以提升用户体验,并降低部署成本。未来,该方法可以进一步扩展到其他类型的模型和硬件平台,例如移动设备和边缘计算设备,从而实现更广泛的应用。

📄 摘要(原文)

Large Language Models (LLMs) face significant inference latency challenges stemming from their autoregressive design and large size. To address this, speculative decoding emerges as a solution, enabling the simultaneous generation and validation of multiple tokens. While recent approaches like EAGLE-2 and EAGLE-3 improve speculative decoding using dynamic tree structures, they often neglect the impact of crucial system variables such as GPU devices and batch sizes. Therefore, we introduce a new dynamic tree decoding approach called CAST that takes into account inference costs, including factors such as GPU configurations and batch sizes, to dynamically refine the tree structure. Through comprehensive experimentation across six diverse tasks and utilizing six distinct LLMs, our methodology demonstrates remarkable results, achieving speeds up to 5.2 times faster than conventional decoding methods. Moreover, it generally outperforms existing state-of-the-art techniques from 5% to 20%.