Bayesian Network Fusion of Large Language Models for Sentiment Analysis

作者: Rasoul Amirzadeh, Dhananjay Thiruvady, Fatemeh Shiri

分类: cs.CL, cs.AI

发布日期: 2025-10-30

💡 一句话要点

提出基于贝叶斯网络的大语言模型融合框架,提升情感分析性能。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 情感分析 大语言模型 贝叶斯网络 模型融合 金融领域 可解释性 概率推理

📋 核心要点

- 现有大语言模型在情感分析中存在透明度低、成本高、领域泛化性差等问题。

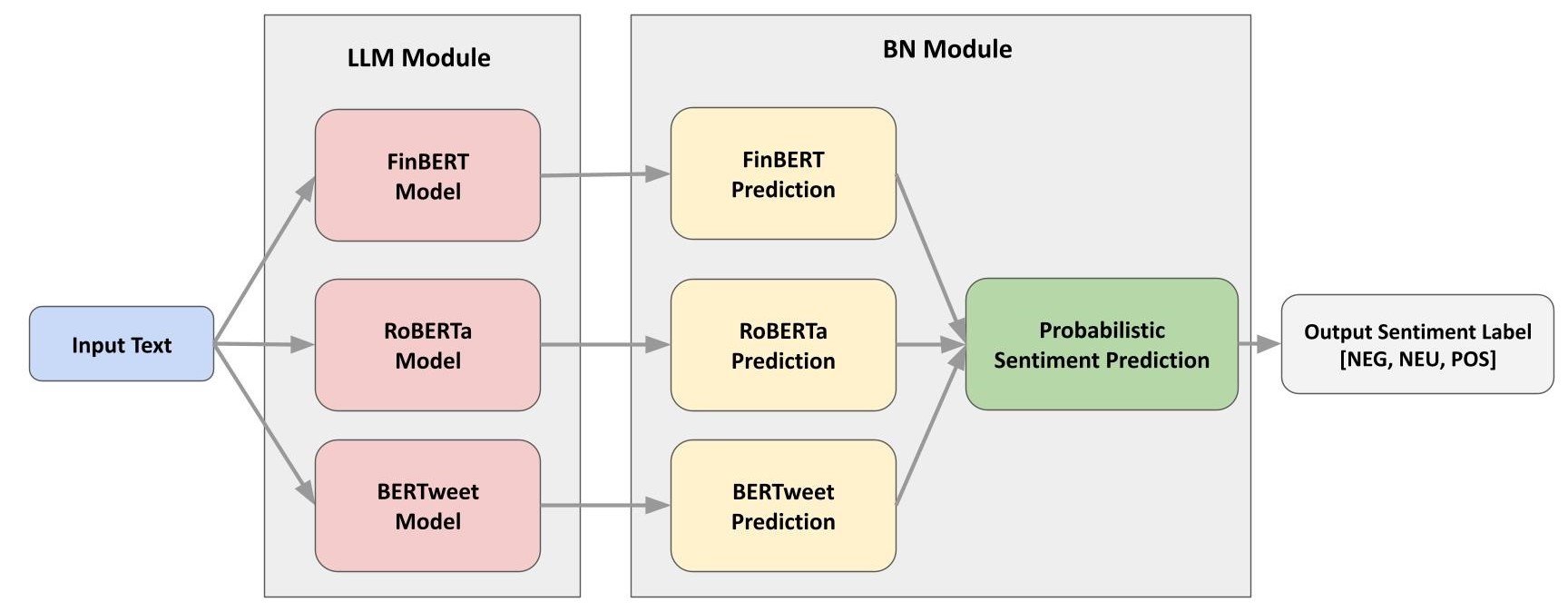

- 论文提出BNLF框架,利用贝叶斯网络融合多个LLM的预测结果,实现概率化的情感分析。

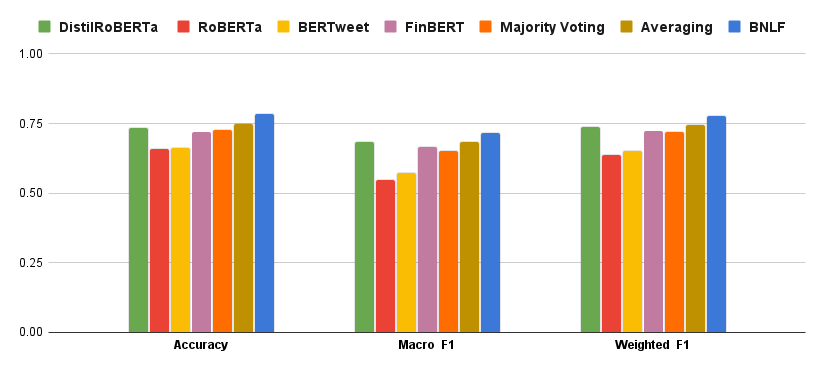

- 实验表明,BNLF在金融语料库上相比基线模型,准确率提升约6%,具有较好的鲁棒性。

📝 摘要(中文)

大型语言模型(LLM)不断发展,涌现出越来越多针对特定任务的领域专用变体。然而,这些模型通常缺乏透明性和可解释性,微调成本高昂,需要大量的提示工程,在不同领域产生不一致的结果,并且由于其高计算需求而对环境产生显著的负面影响。为了解决这些挑战,我们提出了贝叶斯网络LLM融合(BNLF)框架,该框架通过概率机制整合来自三个LLM(包括FinBERT、RoBERTa和BERTweet)的预测,用于情感分析。BNLF通过将来自多个LLM的情感预测建模为贝叶斯网络中的概率节点来执行后期融合。在三个具有不同语言和上下文特征的人工标注金融语料库上进行评估,BNLF在准确性方面始终比基线LLM提高约6%,突显了其对数据集变异性的鲁棒性以及概率融合在可解释情感分类中的有效性。

🔬 方法详解

问题定义:论文旨在解决大型语言模型(LLM)在情感分析中存在的局限性,包括缺乏透明性和可解释性、微调成本高昂、需要大量的提示工程、在不同领域产生不一致的结果以及高计算需求带来的环境影响。现有方法通常依赖于单个LLM,容易受到模型自身偏差的影响,且难以解释其预测结果。

核心思路:论文的核心思路是利用贝叶斯网络融合多个LLM的预测结果,将每个LLM的预测视为贝叶斯网络中的一个概率节点。通过贝叶斯网络的推理能力,可以综合考虑不同LLM的预测,并给出更准确、更鲁棒的情感分析结果。这种方法还可以提供一定的可解释性,因为可以分析每个LLM对最终预测的贡献。

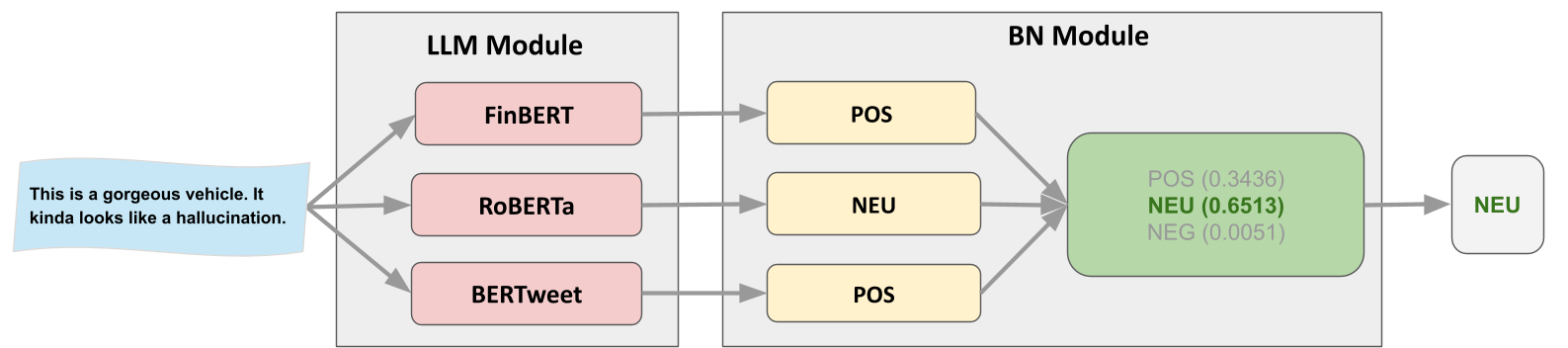

技术框架:BNLF框架主要包含以下几个步骤:1) 使用多个预训练的LLM(例如FinBERT、RoBERTa和BERTweet)对输入文本进行情感分析,得到每个LLM的情感预测结果。2) 将每个LLM的预测结果作为贝叶斯网络中的一个节点,节点之间的连接关系可以根据领域知识或数据驱动的方法进行确定。3) 使用贝叶斯推理算法(例如变量消除或信念传播)计算每个节点(即每个LLM的预测)的后验概率。4) 根据后验概率对不同LLM的预测进行加权融合,得到最终的情感分析结果。

关键创新:论文的关键创新在于将贝叶斯网络引入到LLM的融合中,利用贝叶斯网络的概率推理能力,可以更有效地整合多个LLM的预测结果,并提供一定的可解释性。与传统的模型融合方法(例如简单平均或加权平均)相比,BNLF可以更好地处理不同LLM之间的依赖关系和不确定性。

关键设计:论文中贝叶斯网络的结构设计是一个关键的技术细节。节点之间的连接关系可以根据领域知识或数据驱动的方法进行确定。例如,如果已知某个LLM在特定领域表现更好,则可以增加该LLM节点与其他节点之间的连接强度。此外,论文可能还涉及到一些参数设置,例如贝叶斯网络的先验概率和条件概率的设置,这些参数可以通过实验或领域知识进行调整。

🖼️ 关键图片

📊 实验亮点

实验结果表明,BNLF框架在三个不同的金融语料库上,相比于基线LLM(FinBERT、RoBERTa和BERTweet),情感分析的准确率平均提升约6%。这一结果表明,BNLF框架具有较好的鲁棒性和泛化能力,能够有效地应对不同数据集的变异性。

🎯 应用场景

该研究成果可应用于金融领域的情感分析,例如舆情监控、风险评估和投资决策。通过融合多个LLM的预测,可以提高情感分析的准确性和鲁棒性,从而为金融机构提供更可靠的信息支持。未来,该方法还可以扩展到其他领域,例如社交媒体分析、客户服务和产品评论分析等。

📄 摘要(原文)

Large language models (LLMs) continue to advance, with an increasing number of domain-specific variants tailored for specialised tasks. However, these models often lack transparency and explainability, can be costly to fine-tune, require substantial prompt engineering, yield inconsistent results across domains, and impose significant adverse environmental impact due to their high computational demands. To address these challenges, we propose the Bayesian network LLM fusion (BNLF) framework, which integrates predictions from three LLMs, including FinBERT, RoBERTa, and BERTweet, through a probabilistic mechanism for sentiment analysis. BNLF performs late fusion by modelling the sentiment predictions from multiple LLMs as probabilistic nodes within a Bayesian network. Evaluated across three human-annotated financial corpora with distinct linguistic and contextual characteristics, BNLF demonstrates consistent gains of about six percent in accuracy over the baseline LLMs, underscoring its robustness to dataset variability and the effectiveness of probabilistic fusion for interpretable sentiment classification.