On the Role of Context for Discourse Relation Classification in Scientific Writing

作者: Stephen Wan, Wei Liu, Michael Strube

分类: cs.CL

发布日期: 2025-10-30

备注: Accepted at Joint Sixth Workshop on Computational Approaches to Discourse, Context and Document-Level Inferences (CODI 2025) and Eighth Workshop on Computational Models of Reference, Anaphora and Coreference (CRAC 2025)

💡 一句话要点

研究科学写作中篇章关系分类任务,探讨上下文信息对提升性能的作用

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 篇章关系分类 科学写作 预训练语言模型 大型语言模型 上下文信息 自然语言处理 科学文献分析

📋 核心要点

- 现有方法在科学写作的篇章关系分类(DRC)任务中表现不足,尤其缺乏对上下文信息的有效利用。

- 本文探索利用预训练语言模型和大型语言模型,结合篇章结构提供的上下文信息,提升DRC任务的性能。

- 实验结果表明,融入上下文信息通常能够提升DRC任务的性能,并且不同类型的篇章关系受益程度不同。

📝 摘要(中文)

随着生成式人工智能(AI)方法在科学工作流程中日益普及,我们关注如何利用篇章级信息为AI生成的科学论断寻找支持证据。本文旨在研究科学写作中篇章结构推断任务,这是实现上述目标的第一步。我们初步探索了预训练语言模型(PLM)和大型语言模型(LLM)在篇章关系分类(DRC)任务中的应用,重点关注科学出版物这一研究较少的领域。实验结果表明,上下文(由篇章结构定义)通常对DRC任务有帮助。此外,我们还分析了哪些科学篇章关系类型最能从上下文中获益。

🔬 方法详解

问题定义:论文旨在解决科学写作中篇章关系分类(DRC)的问题。现有方法在处理科学文献时,往往忽略了上下文信息,导致分类精度不高。科学文献的特殊结构和表达方式对DRC提出了挑战。

核心思路:论文的核心思路是利用篇章结构提供的上下文信息来提升DRC的性能。作者认为,科学写作中的论证关系往往依赖于上下文,例如前文提出的假设或实验结果会影响后续论证的合理性。因此,将上下文信息融入模型可以更准确地判断篇章关系。

技术框架:论文采用预训练语言模型(PLM)和大型语言模型(LLM)作为基础模型,并在此基础上引入上下文信息。具体流程包括:1) 对科学文献进行篇章分割;2) 利用PLM/LLM对每个篇章单元进行编码;3) 将上下文篇章单元的编码与目标篇章单元的编码进行融合;4) 利用分类器预测篇章关系。

关键创新:论文的关键创新在于强调了上下文信息在科学写作DRC任务中的重要性,并验证了利用PLM/LLM结合上下文信息可以有效提升DRC性能。此外,论文还分析了不同类型的篇章关系对上下文信息的依赖程度,为后续研究提供了指导。

关键设计:论文的具体技术细节未详细描述,例如上下文融合的具体方法(如注意力机制、拼接等)、损失函数的选择、以及PLM/LLM的具体参数设置等。这些细节需要参考论文原文或相关文献。

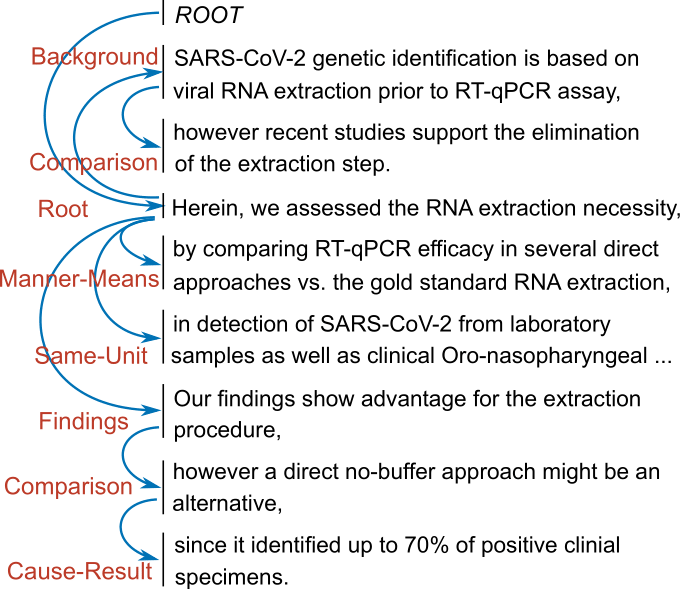

🖼️ 关键图片

📊 实验亮点

论文的主要实验结果表明,利用上下文信息可以提升科学写作中篇章关系分类的性能。具体提升幅度未知,需要参考论文原文。论文还分析了不同类型的篇章关系对上下文信息的依赖程度,为后续研究提供了有价值的参考。

🎯 应用场景

该研究成果可应用于自动科学文献分析、AI辅助科研写作、智能文献检索等领域。通过准确识别科学文献中的篇章关系,可以帮助研究人员更好地理解文献内容、发现潜在的研究方向,并提高科研效率。未来,该技术有望应用于自动生成科研综述、辅助科研决策等更高级的任务。

📄 摘要(原文)

With the increasing use of generative Artificial Intelligence (AI) methods to support science workflows, we are interested in the use of discourse-level information to find supporting evidence for AI generated scientific claims. A first step towards this objective is to examine the task of inferring discourse structure in scientific writing. In this work, we present a preliminary investigation of pretrained language model (PLM) and Large Language Model (LLM) approaches for Discourse Relation Classification (DRC), focusing on scientific publications, an under-studied genre for this task. We examine how context can help with the DRC task, with our experiments showing that context, as defined by discourse structure, is generally helpful. We also present an analysis of which scientific discourse relation types might benefit most from context.