Pragmatic Theories Enhance Understanding of Implied Meanings in LLMs

作者: Takuma Sato, Seiya Kawano, Koichiro Yoshino

分类: cs.CL

发布日期: 2025-10-30 (更新: 2025-11-19)

💡 一句话要点

利用语用理论提示提升LLM对隐含意义的理解能力

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 语用学 隐含意义理解 大型语言模型 上下文学习 思维链

📋 核心要点

- 现有语言模型在理解隐含意义方面存在不足,难以准确捕捉人类交流中的细微之处。

- 论文提出将语用理论作为提示,引导语言模型进行逐步推理,从而提升其理解隐含意义的能力。

- 实验结果表明,该方法在语用推理任务上显著优于基线方法,最高提升达9.6%。

📝 摘要(中文)

准确理解隐含意义在人类交流和语言使用中至关重要,语言模型也应具备这种能力。本研究表明,为语言模型提供语用理论作为提示,是一种有效的上下文学习方法,用于理解隐含意义的任务。具体而言,我们提出了一种方法,将语用理论(如格莱斯语用学和关联理论)的概述作为提示呈现给语言模型,引导它通过逐步推理过程来得出最终解释。实验结果表明,与基线方法(不呈现语用理论的0-shot思维链)相比,我们的方法使语言模型在语用推理任务上获得了高达9.6%的更高分数。此外,我们还表明,即使不解释语用理论的细节,仅仅在提示中提及它们的名字,也能使更大的模型获得一定的性能提升(约1-3%)。

🔬 方法详解

问题定义:论文旨在解决大型语言模型(LLM)在理解隐含意义方面的不足。现有方法,如简单的提示工程或思维链(Chain-of-Thought, CoT),在处理需要语用推理的任务时表现不佳,无法有效捕捉人类交流中的细微之处和潜在含义。这些方法缺乏对语用学理论的显式指导,导致模型难以进行深入的推理和理解。

核心思路:论文的核心思路是将语用理论(如格莱斯语用学和关联理论)作为提示,显式地引导LLM进行推理。通过向模型提供语用理论的概述,使其能够更好地理解和应用相关的原则,从而更准确地推断出隐含意义。这种方法模拟了人类在理解语言时所使用的语用推理过程。

技术框架:该方法主要包含以下几个阶段:1) 准备阶段:选择合适的语用理论,并将其概述整理成提示文本。2) 提示阶段:将包含语用理论概述的提示文本输入LLM。3) 推理阶段:LLM根据提示文本中的语用理论,逐步推理并生成中间步骤。4) 解释阶段:LLM根据推理结果,给出对隐含意义的最终解释。整体流程类似于CoT,但关键区别在于CoT的提示中不包含语用理论的显式指导。

关键创新:该方法最重要的技术创新点在于将语用理论显式地融入到LLM的提示中。与传统的CoT方法相比,该方法能够为LLM提供更强的语用推理能力,使其能够更好地理解和应用相关的原则。此外,即使仅在提示中提及语用理论的名称,也能带来一定的性能提升,表明LLM可能已经具备一定的语用知识,只是需要适当的激活。

关键设计:论文的关键设计包括:1) 语用理论的选择:选择了格莱斯语用学和关联理论作为主要的语用理论。2) 提示文本的构建:精心设计了提示文本,使其能够清晰地概述语用理论的核心概念和原则。3) 推理步骤的设计:引导LLM进行逐步推理,使其能够更好地理解隐含意义的推导过程。4) 模型选择:实验中使用了不同规模的LLM,以评估该方法在不同模型上的效果。

🖼️ 关键图片

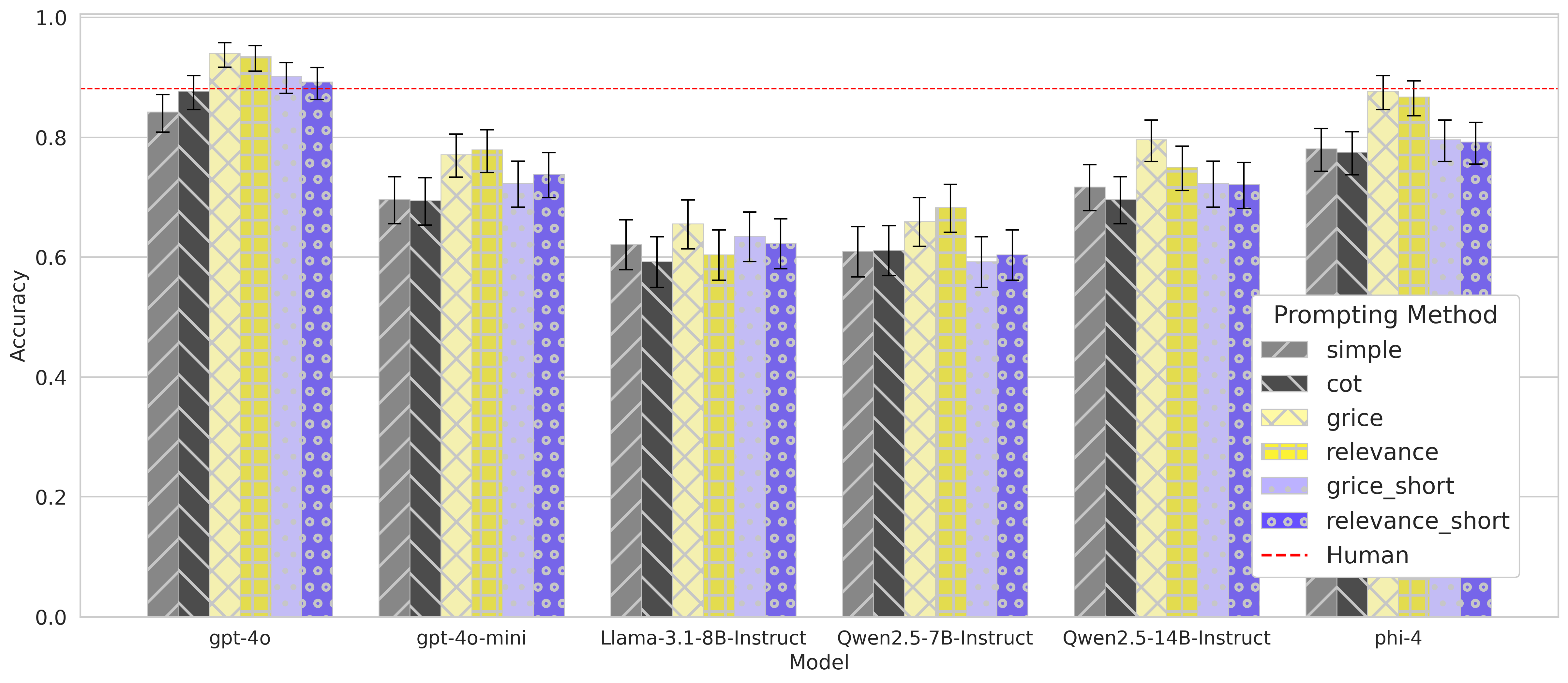

📊 实验亮点

实验结果表明,与基线方法(0-shot CoT)相比,该方法在语用推理任务上取得了显著的性能提升,最高提升达9.6%。此外,即使仅在提示中提及语用理论的名称,也能使较大的模型获得1-3%的性能提升。这些结果表明,将语用理论融入到LLM的提示中,是一种有效的提升其理解隐含意义能力的方法。

🎯 应用场景

该研究成果可应用于各种需要理解隐含意义的自然语言处理任务,例如情感分析、对话系统、文本摘要和机器翻译。通过提升LLM对隐含意义的理解能力,可以改善人机交互的质量,提高机器翻译的准确性,并使文本摘要更加简洁和准确。未来,该方法可以进一步扩展到其他语用理论和更复杂的推理场景。

📄 摘要(原文)

The ability to accurately interpret implied meanings plays a crucial role in human communication and language use, and language models are also expected to possess this capability. This study demonstrates that providing language models with pragmatic theories as prompts is an effective in-context learning approach for tasks to understand implied meanings. Specifically, we propose an approach in which an overview of pragmatic theories, such as Gricean pragmatics and Relevance Theory, is presented as a prompt to the language model, guiding it through a step-by-step reasoning process to derive a final interpretation. Experimental results showed that, compared to the baseline, which prompts intermediate reasoning without presenting pragmatic theories (0-shot Chain-of-Thought), our methods enabled language models to achieve up to 9.6\% higher scores on pragmatic reasoning tasks. Furthermore, we show that even without explaining the details of pragmatic theories, merely mentioning their names in the prompt leads to a certain performance improvement (around 1-3%) in larger models compared to the baseline.