PORTool: Tool-Use LLM Training with Rewarded Tree

作者: Feijie Wu, Weiwu Zhu, Yuxiang Zhang, Soumya Chatterjee, Jiarong Zhu, Fan Mo, Rodin Luo, Jing Gao

分类: cs.CL, cs.AI, cs.LG

发布日期: 2025-10-29

💡 一句话要点

PORTool:基于奖励树的工具使用LLM训练方法,提升动态环境下的工具调用性能。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 工具使用LLM 强化学习 奖励树 动态环境 工具调用 多步骤推理 策略优化

📋 核心要点

- 现有工具使用LLM在静态数据上训练,缺乏对动态环境的适应性和探索多种解决方案的能力。

- PORTool通过强化学习,鼓励LLM探索多种工具调用轨迹,并基于奖励机制优化模型。

- 实验结果表明,PORTool在准确性和工具调用效率方面均优于其他训练方法,尤其是在动态环境中。

📝 摘要(中文)

现有的工具使用大型语言模型(LLM)在静态数据集上训练,使其能够与外部工具交互并执行多步骤、工具集成的推理,从而产生工具调用轨迹。然而,这些模型模仿通用工具调用例程中解决查询的方式,因此无法探索可能的解决方案,并且在不断发展的动态工具调用环境中表现出有限的性能。本文提出了PORTool,一种强化学习(RL)方法,鼓励工具使用LLM探索产生正确答案的各种轨迹。具体来说,该方法首先为给定的查询生成多个rollout,其中一些rollout共享前几个工具调用步骤,从而形成类似树的结构。接下来,我们根据每个步骤产生正确答案和成功工具调用的能力,为每个步骤分配奖励。不同轨迹共享的步骤获得相同的奖励,而同一分支下的不同步骤获得不同的奖励。最后,这些逐步奖励用于计算分支相关的优势,并与轨迹相关的优势混合,以训练LLM用于工具使用。实验利用17个工具来解决用户查询,涵盖时间敏感和时间不变的主题。我们进行了消融研究,以系统地证明逐步奖励的必要性和设计稳健性。此外,我们将提出的PORTool与其他训练方法进行比较,并证明了在最终准确性和工具调用步骤数量方面的显着改进。

🔬 方法详解

问题定义:现有工具使用LLM主要依赖静态数据集进行训练,导致模型在面对动态变化的工具调用环境时,无法有效探索多种解决方案,性能受限。模型倾向于模仿预定义的工具调用流程,缺乏灵活性和适应性。

核心思路:PORTool的核心在于利用强化学习,鼓励LLM探索不同的工具调用轨迹,并根据轨迹的质量(是否产生正确答案,工具调用是否成功)给予奖励。通过这种方式,模型能够学习到更鲁棒和高效的工具使用策略。

技术框架:PORTool的整体框架包括以下几个主要阶段:1) 轨迹生成:对于给定的用户查询,生成多个可能的工具调用轨迹,形成一个树状结构,其中一些轨迹共享初始步骤。2) 奖励分配:根据每个步骤的贡献(是否产生正确答案,工具调用是否成功)分配奖励。共享步骤获得相同奖励,同一分支下的不同步骤获得不同奖励。3) 优势计算:计算分支相关的优势和轨迹相关的优势,并将两者混合。4) 模型训练:使用计算得到的优势来训练LLM,优化其工具使用策略。

关键创新:PORTool的关键创新在于引入了基于树状结构的奖励机制,能够更精细地评估每个工具调用步骤的贡献。通过区分分支相关和轨迹相关的优势,模型能够更好地学习到不同工具调用策略的优劣。与传统的静态数据集训练方法相比,PORTool能够更好地适应动态变化的工具调用环境。

关键设计:PORTool的关键设计包括:1) 奖励函数:奖励函数的设计需要能够准确反映每个步骤的贡献,包括是否产生正确答案和工具调用是否成功。2) 优势计算:分支相关优势和轨迹相关优势的混合比例需要仔细调整,以平衡探索和利用。3) 探索策略:需要采用合适的探索策略,鼓励模型尝试不同的工具调用路径。

🖼️ 关键图片

📊 实验亮点

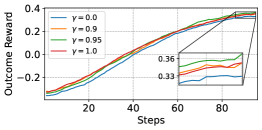

实验结果表明,PORTool在17个工具的使用场景下,显著提升了LLM的准确性和工具调用效率。与现有方法相比,PORTool在最终准确率和工具调用步骤数量方面均有显著改进。消融实验证明了逐步奖励机制的必要性和设计稳健性。PORTool在时间敏感和时间不变的主题上均表现出良好的性能。

🎯 应用场景

PORTool可应用于各种需要与外部工具交互的LLM应用场景,例如智能助手、自动化流程、知识库问答等。该方法能够提升LLM在动态环境下的工具使用能力,使其能够更有效地解决复杂问题,具有广泛的应用前景和实际价值。未来可以进一步探索PORTool在更多领域的应用,并研究如何进一步提升其性能。

📄 摘要(原文)

Current tool-use large language models (LLMs) are trained on static datasets, enabling them to interact with external tools and perform multi-step, tool-integrated reasoning, which produces tool-call trajectories. However, these models imitate how a query is resolved in a generic tool-call routine, thereby failing to explore possible solutions and demonstrating limited performance in an evolved, dynamic tool-call environment. In this work, we propose PORTool, a reinforcement learning (RL) method that encourages a tool-use LLM to explore various trajectories yielding the correct answer. Specifically, this method starts with generating multiple rollouts for a given query, and some of them share the first few tool-call steps, thereby forming a tree-like structure. Next, we assign rewards to each step, based on its ability to produce a correct answer and make successful tool calls. A shared step across different trajectories receives the same reward, while different steps under the same fork receive different rewards. Finally, these step-wise rewards are used to calculate fork-relative advantages, blended with trajectory-relative advantages, to train the LLM for tool use. The experiments utilize 17 tools to address user queries, covering both time-sensitive and time-invariant topics. We conduct ablation studies to systematically justify the necessity and the design robustness of step-wise rewards. Furthermore, we compare the proposed PORTool with other training approaches and demonstrate significant improvements in final accuracy and the number of tool-call steps.