SymCode: A Neurosymbolic Approach to Mathematical Reasoning via Verifiable Code Generation

作者: Sina Bagheri Nezhad, Yao Li, Ameeta Agrawal

分类: cs.CL, cs.PL

发布日期: 2025-10-29 (更新: 2026-01-25)

备注: camera-ready EACL 2026 Findings

💡 一句话要点

SymCode:一种基于可验证代码生成的神经符号数学推理方法

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 神经符号推理 数学推理 代码生成 大型语言模型 SymPy 可验证计算 形式化方法

📋 核心要点

- 现有大语言模型在数学推理中易出错,缺乏可靠的验证机制,导致结果不准确。

- SymCode将数学问题转化为可验证的代码生成任务,利用SymPy库进行符号计算,确保结果正确性。

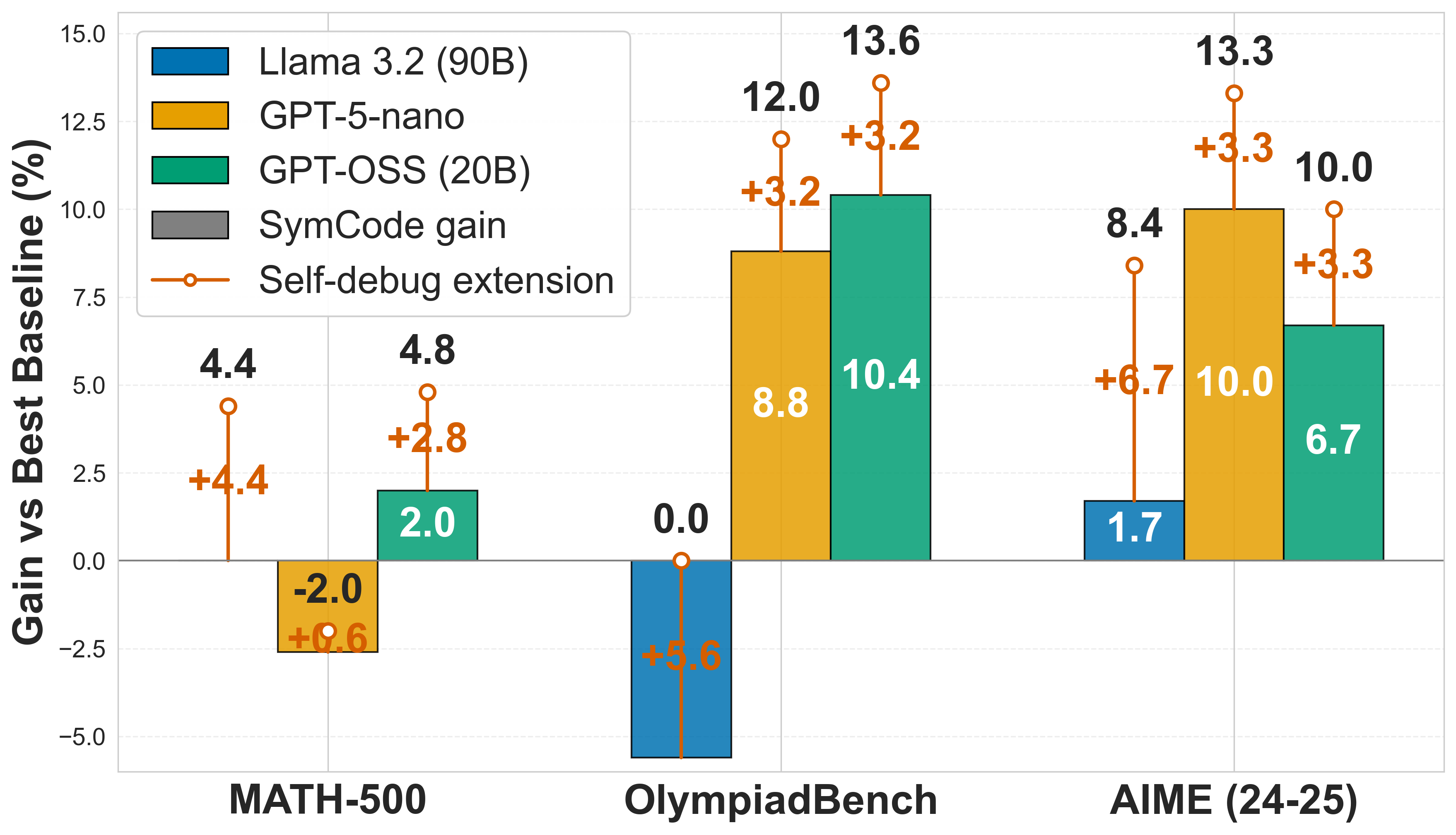

- 实验表明,SymCode在MATH-500和OlympiadBench等基准测试中,准确率提升高达13.6%。

📝 摘要(中文)

大型语言模型(LLM)在复杂的数学推理方面表现不佳,因为基于文本的生成方式导致解决方案未经验证且算术上不合理。现有的提示策略,如思维链,仍然在这种不可靠的媒介中运行,缺乏确定性验证机制。为了解决这些限制,我们引入了SymCode,一个神经符号框架,它将数学问题求解重新定义为使用SymPy库的可验证代码生成任务。我们在具有挑战性的基准测试(包括MATH-500和OlympiadBench)上评估了SymCode,证明了相对于基线,准确性显著提高了高达13.6个百分点。我们的分析表明,SymCode不仅更节省token,而且从根本上将模型失败从不透明的逻辑谬误转变为透明的程序错误。通过将LLM推理建立在确定性的符号引擎中,SymCode代表了在形式领域中实现更准确和可信赖的AI的关键一步。

🔬 方法详解

问题定义:大型语言模型在解决复杂的数学问题时,通常采用基于文本生成的思维链方法。然而,这种方法缺乏确定性的验证机制,容易产生算术错误和逻辑谬误,导致结果不可靠。现有的提示工程方法难以从根本上解决这个问题。

核心思路:SymCode的核心思路是将数学问题求解过程转化为可验证的代码生成任务。具体来说,模型生成使用SymPy库的Python代码来解决问题,而不是直接生成文本答案。由于SymPy是一个成熟的符号计算库,生成的代码可以通过执行来验证其正确性,从而避免了传统方法中的算术错误和逻辑谬误。

技术框架:SymCode框架主要包含以下几个阶段:1) 问题编码:将数学问题转化为适合LLM输入的格式。2) 代码生成:利用LLM生成解决问题的SymPy代码。3) 代码验证:执行生成的代码,并检查结果的正确性。如果代码执行出错或结果不正确,则返回到代码生成阶段进行修正。4) 答案提取:从验证后的代码执行结果中提取最终答案。整个流程形成一个闭环,确保最终答案的正确性。

关键创新:SymCode最重要的创新在于将神经方法(LLM)与符号方法(SymPy)相结合,构建了一个神经符号系统。这种结合既利用了LLM强大的语言理解和生成能力,又利用了符号计算的精确性和可验证性。与传统的基于文本生成的数学推理方法相比,SymCode能够显著提高结果的准确性和可靠性。

关键设计:在代码生成阶段,论文采用了特定的提示工程策略,引导LLM生成符合SymPy语法的代码。此外,论文还设计了一套错误处理机制,当生成的代码执行出错时,能够自动进行修正和重试。在代码验证阶段,论文采用了多种验证方法,包括数值验证和符号验证,以确保结果的正确性。

🖼️ 关键图片

📊 实验亮点

SymCode在MATH-500和OlympiadBench等具有挑战性的数学推理基准测试中取得了显著的性能提升。具体而言,相对于基线模型,SymCode在这些基准测试中准确率提高了高达13.6个百分点。此外,实验结果表明,SymCode不仅提高了准确率,还提高了token效率,并且将模型错误从不透明的逻辑错误转变为透明的程序错误。

🎯 应用场景

SymCode方法可应用于自动化数学问题求解、科学计算、工程设计等领域。通过提高数学推理的准确性和可靠性,SymCode能够帮助人们更高效地解决实际问题,并为人工智能在科学研究和工程实践中的应用奠定基础。未来,该方法有望扩展到更广泛的符号推理领域。

📄 摘要(原文)

Large Language Models (LLMs) often struggle with complex mathematical reasoning, where prose-based generation leads to unverified and arithmetically unsound solutions. Current prompting strategies like Chain of Thought still operate within this unreliable medium, lacking a mechanism for deterministic verification. To address these limitations, we introduce SymCode, a neurosymbolic framework that reframes mathematical problem-solving as a task of verifiable code generation using the SymPy library. We evaluate SymCode on challenging benchmarks, including MATH-500 and OlympiadBench, demonstrating significant accuracy improvements of up to 13.6 percentage points over baselines. Our analysis shows that SymCode is not only more token-efficient but also fundamentally shifts model failures from opaque logical fallacies towards transparent, programmatic errors. By grounding LLM reasoning in a deterministic symbolic engine, SymCode represents a key step towards more accurate and trustworthy AI in formal domains.