The Limits of Obliviate: Evaluating Unlearning in LLMs via Stimulus-Knowledge Entanglement-Behavior Framework

作者: Aakriti Shah, Thai Le

分类: cs.CL, cs.AI

发布日期: 2025-10-29

备注: 14 pages, 11 figures

💡 一句话要点

提出SKeB框架,评估LLM在诱导性提示下的遗忘能力,揭示模型大小与遗忘效果的关联。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 遗忘学习 知识纠缠 诱导性提示 模型评估

📋 核心要点

- 评估LLM遗忘能力面临挑战,现有方法难以有效衡量模型在对抗性提示下的知识残留。

- 提出SKeB框架,通过领域图建模知识纠缠,并利用诱导性提示评估遗忘后的知识回忆情况。

- 实验表明,诱导性提示能显著增强事实知识回忆,且模型越大,遗忘效果越好,恢复率越低。

📝 摘要(中文)

大型语言模型(LLM)中的遗忘能力对于管理敏感数据和纠正错误信息至关重要,但评估其有效性仍然是一个开放性问题。本文研究了在2.7B到13B参数范围内的多个模型(OPT-2.7B、LLaMA-2-7B、LLaMA-3.1-8B、LLaMA-2-13B)中,有说服力的提示是否能够回忆起故意遗忘的事实知识。借鉴ACT-R和赫布理论(扩散激活理论)以及沟通原则,我们引入了刺激-知识纠缠-行为框架(SKeB),该框架通过领域图对信息纠缠进行建模,并测试遗忘模型中的事实回忆是否与有说服力的框架相关。我们开发了纠缠度量来量化知识激活模式,并评估输出中的事实性、非事实性和幻觉。结果表明,有说服力的提示显著增强了事实知识的回忆(基线14.8% vs. 权威框架24.5%),其有效性与模型大小成反比(2.7B模型恢复率128% vs. 13B模型15%)。SKeB为评估LLM中的遗忘完整性、鲁棒性和整体行为提供了基础。

🔬 方法详解

问题定义:论文旨在解决如何有效评估大型语言模型(LLM)的遗忘能力的问题。现有的评估方法通常难以准确衡量模型在经过遗忘训练后,是否真的忘记了特定的知识,尤其是在面对具有诱导性的提示时。现有的痛点在于缺乏一个能够量化知识纠缠程度并评估遗忘鲁棒性的框架。

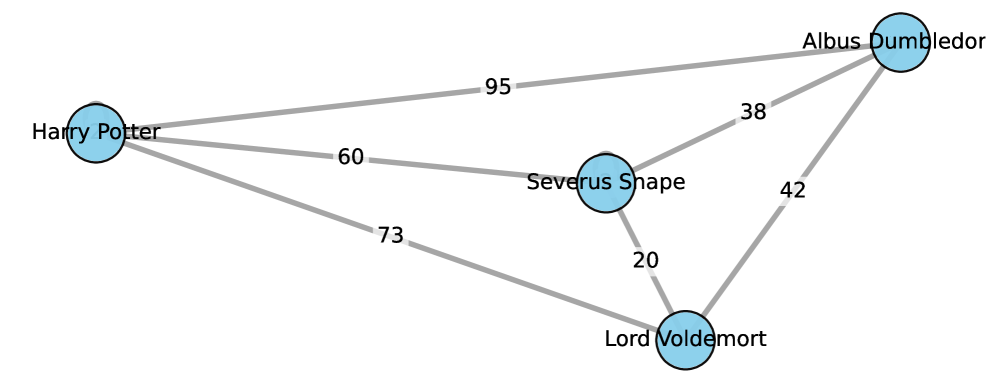

核心思路:论文的核心思路是借鉴认知科学中的扩散激活理论,认为知识之间存在关联和纠缠。通过构建领域图来模拟知识的纠缠关系,并设计具有诱导性的提示,来测试模型在遗忘后是否仍然能够回忆起相关的事实知识。这种方法能够更全面地评估遗忘的有效性和鲁棒性。

技术框架:SKeB框架包含以下主要模块:1) 领域图构建:利用知识图谱或文本数据构建领域图,表示知识之间的关联关系。2) 诱导性提示生成:设计具有不同诱导框架(如权威性、情感性等)的提示,用于激活模型中相关的知识。3) 知识回忆评估:评估模型在面对诱导性提示时,回忆起已遗忘知识的能力。4) 纠缠度量:量化知识激活模式,评估事实性、非事实性和幻觉。

关键创新:该论文的关键创新在于提出了SKeB框架,将认知科学理论与LLM遗忘评估相结合。通过领域图建模知识纠缠,并利用诱导性提示来评估遗忘的鲁棒性,提供了一种更全面、更有效的遗忘评估方法。与现有方法相比,SKeB能够更准确地衡量模型在对抗性提示下的知识残留情况。

关键设计:关键设计包括:1) 领域图的构建方法:可以基于现有的知识图谱,也可以从文本数据中自动提取知识关系。2) 诱导性提示的生成策略:设计不同类型的诱导框架,如权威性、情感性等,以测试模型对不同类型提示的敏感度。3) 知识回忆的评估指标:包括事实性、非事实性和幻觉等指标,用于全面评估模型的回忆结果。4) 纠缠度量:用于量化知识激活模式,例如激活的节点数量、激活路径的长度等。

🖼️ 关键图片

📊 实验亮点

实验结果表明,诱导性提示显著增强了事实知识的回忆(基线14.8% vs. 权威框架24.5%),且模型大小与遗忘效果成反比(2.7B模型恢复率128% vs. 13B模型15%)。这些结果表明,即使经过遗忘训练,LLM仍然可能在诱导性提示下回忆起已遗忘的知识,并且模型越大,遗忘效果越好,但仍然存在知识残留。

🎯 应用场景

该研究成果可应用于多个领域,包括:1) 数据隐私保护:评估和改进LLM的遗忘能力,确保敏感数据被彻底删除。2) 错误信息纠正:评估LLM纠正错误信息的能力,防止模型传播不准确或有害的信息。3) 模型安全:提高LLM的安全性,防止模型被恶意利用,泄露或生成不当内容。未来,该框架可用于开发更安全、更可靠的LLM。

📄 摘要(原文)

Unlearning in large language models (LLMs) is crucial for managing sensitive data and correcting misinformation, yet evaluating its effectiveness remains an open problem. We investigate whether persuasive prompting can recall factual knowledge from deliberately unlearned LLMs across models ranging from 2.7B to 13B parameters (OPT-2.7B, LLaMA-2-7B, LLaMA-3.1-8B, LLaMA-2-13B). Drawing from ACT-R and Hebbian theory (spreading activation theories), as well as communication principles, we introduce Stimulus-Knowledge Entanglement-Behavior Framework (SKeB), which models information entanglement via domain graphs and tests whether factual recall in unlearned models is correlated with persuasive framing. We develop entanglement metrics to quantify knowledge activation patterns and evaluate factuality, non-factuality, and hallucination in outputs. Our results show persuasive prompts substantially enhance factual knowledge recall (14.8% baseline vs. 24.5% with authority framing), with effectiveness inversely correlated to model size (128% recovery in 2.7B vs. 15% in 13B). SKeB provides a foundation for assessing unlearning completeness, robustness, and overall behavior in LLMs.