Implicature in Interaction: Understanding Implicature Improves Alignment in Human-LLM Interaction

作者: Asutosh Hota, Jussi P. P. Jokinen

分类: cs.CL, cs.AI

发布日期: 2025-10-29

备注: The manuscript is approximately 7360 words and contains 12 figures and 6 tables

💡 一句话要点

通过理解会话含义提升人机交互中LLM的对齐效果

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 人机交互 大型语言模型 会话含义 用户意图理解 上下文提示

📋 核心要点

- 现有方法在人机交互中,LLM难以准确理解用户隐含意图,导致交互不自然。

- 论文提出利用会话含义理论,通过上下文提示增强LLM对用户意图的理解。

- 实验表明,融入会话含义的提示能显著提升LLM响应的相关性和用户满意度。

📝 摘要(中文)

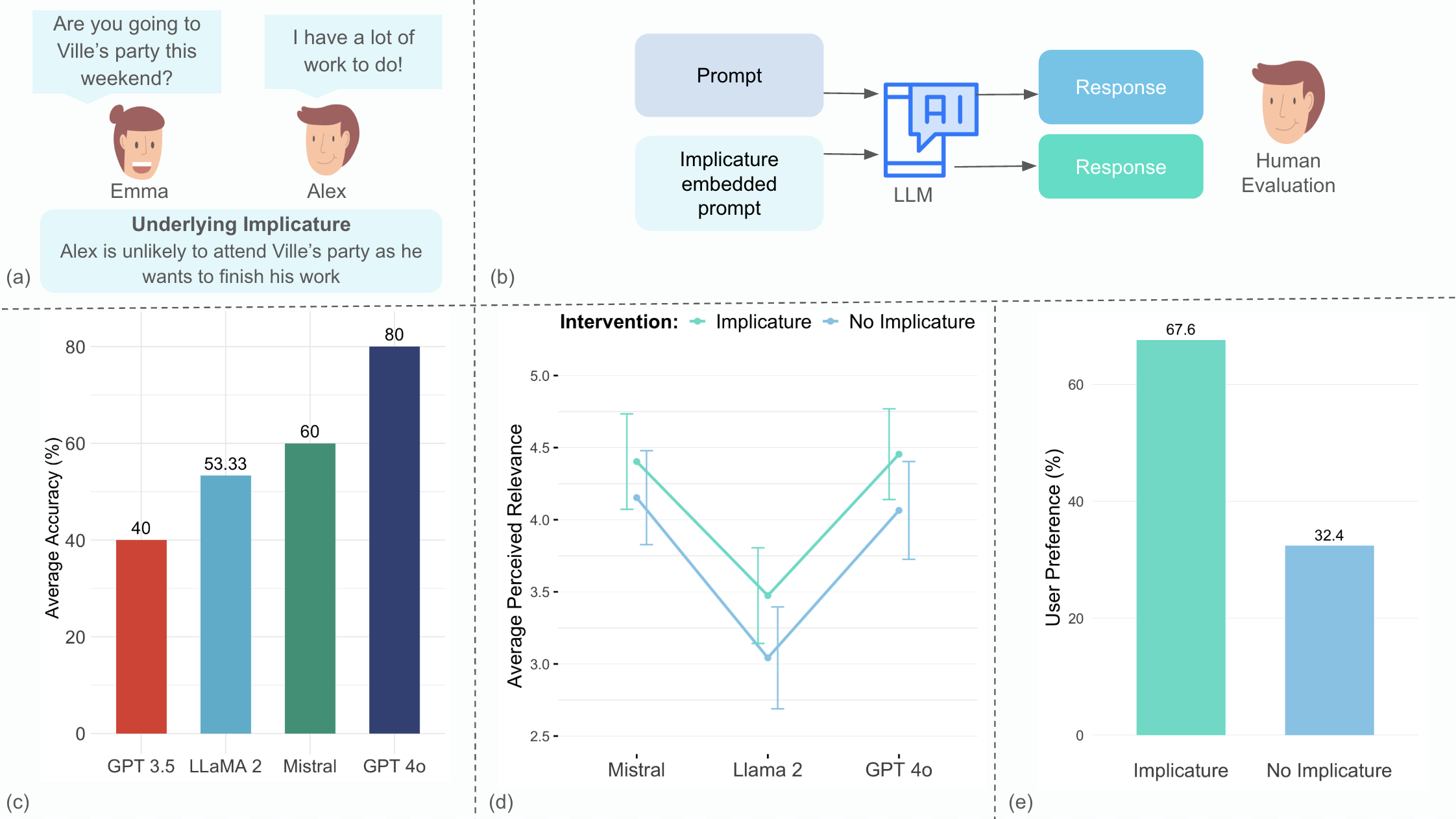

大型语言模型(LLMs)的快速发展正将语言置于人机交互(HCI)的核心地位。我们认为,推进HCI需要关注交互的语言基础,特别是会话含义(通过共享上下文传递的超出明确陈述的含义),这对于人机(HAI)对齐至关重要。本研究考察了LLM推断嵌入在上下文驱动提示中的用户意图的能力,以及理解会话含义是否能改善响应生成。结果表明,较大的模型更接近人类的解释,而较小的模型则难以进行会话含义推断。此外,基于会话含义的提示显著提高了所有模型响应的相关性和质量,较小的模型提升尤为显著。总体而言,67.6%的参与者更喜欢带有会话含义嵌入提示的响应,这突显了对上下文细微差别的沟通的明确偏好。我们的工作有助于理解如何利用语言理论来解决对齐问题,从而使HAI交互更加自然和基于上下文。

🔬 方法详解

问题定义:论文旨在解决人机交互中,大型语言模型(LLM)难以准确理解用户在对话中隐含的意图(即会话含义)的问题。现有方法通常依赖于字面意义的理解,忽略了上下文信息,导致LLM无法生成符合用户真实意图的回复,从而影响交互的自然性和有效性。

核心思路:论文的核心思路是利用语言学中的会话含义理论,通过设计包含上下文信息的提示(prompts),引导LLM更好地理解用户的真实意图。这种方法旨在弥合LLM对字面意义的理解与人类基于上下文的理解之间的差距,从而提高LLM生成回复的质量和相关性。

技术框架:该研究的技术框架主要包括以下几个阶段:1) 设计包含会话含义的提示(implicature-embedded prompts)和字面意义的提示(literal prompts);2) 使用不同规模的LLM(包括大型和小型模型)对这些提示进行响应生成;3) 通过人工评估,比较不同提示下LLM生成回复的相关性、质量以及用户偏好。整体流程旨在评估LLM理解会话含义的能力,以及这种理解对回复生成的影响。

关键创新:论文最重要的技术创新点在于将语言学中的会话含义理论应用于人机交互领域,并验证了其在提升LLM理解用户意图方面的有效性。与现有方法相比,该研究不再仅仅依赖于字面意义的理解,而是通过上下文提示,引导LLM进行更深层次的语义推理,从而更准确地把握用户的真实意图。

关键设计:论文的关键设计包括:1) 精心设计的包含会话含义的提示,这些提示通过上下文信息暗示用户的真实意图,而非直接陈述;2) 使用不同规模的LLM进行实验,以评估模型规模对会话含义理解能力的影响;3) 采用人工评估的方式,从相关性、质量和用户偏好等多个维度对LLM生成的回复进行评价。

🖼️ 关键图片

📊 实验亮点

实验结果表明,更大的模型在理解会话含义方面更接近人类的解释,而较小的模型则表现不佳。更重要的是,使用包含会话含义的提示能够显著提高所有模型生成响应的相关性和质量,尤其是在较小的模型上提升更为明显。总体而言,67.6%的参与者更喜欢使用包含会话含义的提示生成的响应。

🎯 应用场景

该研究成果可广泛应用于智能客服、虚拟助手、教育机器人等领域。通过提升LLM对用户意图的理解,可以使人机交互更加自然流畅,提高用户满意度。未来,该方法有望应用于更复杂的对话场景,例如医疗咨询、法律咨询等,为用户提供更专业、更个性化的服务。

📄 摘要(原文)

The rapid advancement of Large Language Models (LLMs) is positioning language at the core of human-computer interaction (HCI). We argue that advancing HCI requires attention to the linguistic foundations of interaction, particularly implicature (meaning conveyed beyond explicit statements through shared context) which is essential for human-AI (HAI) alignment. This study examines LLMs' ability to infer user intent embedded in context-driven prompts and whether understanding implicature improves response generation. Results show that larger models approximate human interpretations more closely, while smaller models struggle with implicature inference. Furthermore, implicature-based prompts significantly enhance the perceived relevance and quality of responses across models, with notable gains in smaller models. Overall, 67.6% of participants preferred responses with implicature-embedded prompts to literal ones, highlighting a clear preference for contextually nuanced communication. Our work contributes to understanding how linguistic theory can be used to address the alignment problem by making HAI interaction more natural and contextually grounded.