Testing Cross-Lingual Text Comprehension In LLMs Using Next Sentence Prediction

作者: Ritesh Sunil Chavan, Jack Mostow

分类: cs.CL

发布日期: 2025-10-29

💡 一句话要点

利用下句预测任务评估大语言模型在跨语言文本理解中的能力

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 跨语言理解 大语言模型 低资源语言 下句预测 思维链提示

📋 核心要点

- 现有大语言模型主要基于英语数据集训练,难以判断其性能是源于真实能力还是数据优势,尤其是在低资源语言上。

- 本文构建了包含高、中、低资源语言的大规模下句预测基准测试集,用于评估大语言模型在跨语言环境下的文本理解能力。

- 实验结果表明,模型在低资源语言上的性能显著下降,且思维链提示对不同能力的模型效果不同,揭示了模型在跨语言理解方面的局限性。

📝 摘要(中文)

本文研究了大语言模型在跨语言文本理解方面的能力,尤其关注其在低资源语言上的表现。作者基于Agarwal et al. (2025)提出的下句预测(NSP)任务,构建了一个包含英语(高资源)、斯瓦希里语(中等资源)和豪萨语(低资源)的大规模基准测试集,每种语言包含10,000个问题。研究测试了GPT-4 Turbo、Gemini 1.5 Flash和LLaMA 3 70B等模型。结果表明,模型在英语上表现优异,但在斯瓦希里语和豪萨语上的准确率显著下降,LLaMA 3表现最差。引入思维链(CoT)提示后,LLaMA 3的准确率显著提升,但GPT-4和Gemini的性能反而下降。这表明CoT并非通用解决方案,其有效性取决于模型的基础能力和任务的特定背景。该框架能够有效识别LLM的弱点,并揭示CoT在跨语言NSP任务中的作用。

🔬 方法详解

问题定义:本文旨在评估大型语言模型(LLMs)在跨语言文本理解方面的能力,特别是在低资源语言环境下的表现。现有方法主要依赖于在英语等高资源语言上训练的模型,难以评估其在其他语言上的泛化能力,并且缺乏针对低资源语言的有效评估基准。

核心思路:本文的核心思路是利用下句预测(Next Sentence Prediction, NSP)任务作为评估LLMs跨语言理解能力的代理任务。通过构建包含不同资源水平语言(英语、斯瓦希里语、豪萨语)的大规模NSP数据集,可以系统地评估模型在不同语言上的表现,并分析语言资源对模型性能的影响。

技术框架:该研究的技术框架主要包括以下几个阶段:1) 构建跨语言NSP数据集,包含英语(高资源)、斯瓦希里语(中等资源)和豪萨语(低资源),每种语言包含10,000个问题。2) 选择主流LLMs进行测试,包括GPT-4 Turbo、Gemini 1.5 Flash和LLaMA 3 70B。3) 在不同语言的NSP数据集上评估模型的准确率。4) 引入思维链(Chain-of-Thought, CoT)提示,分析其对模型性能的影响。

关键创新:本文的关键创新在于:1) 构建了一个大规模的跨语言NSP基准测试集,为评估LLMs在低资源语言上的理解能力提供了有效工具。2) 系统地研究了语言资源对LLMs性能的影响,揭示了模型在低资源语言上的局限性。3) 发现CoT提示对不同能力的模型具有不同的影响,强调了CoT并非通用解决方案,其有效性取决于模型的基础能力和任务的特定背景。

关键设计:NSP任务的设计遵循Agarwal et al. (2025) 的方法,数据集的构建力求保证不同语言的问题难度一致。CoT提示的设计采用了标准方法,即在问题后添加“Let's think step by step”等引导语,鼓励模型逐步推理。模型的评估指标主要为准确率,用于衡量模型预测下句的正确率。

🖼️ 关键图片

📊 实验亮点

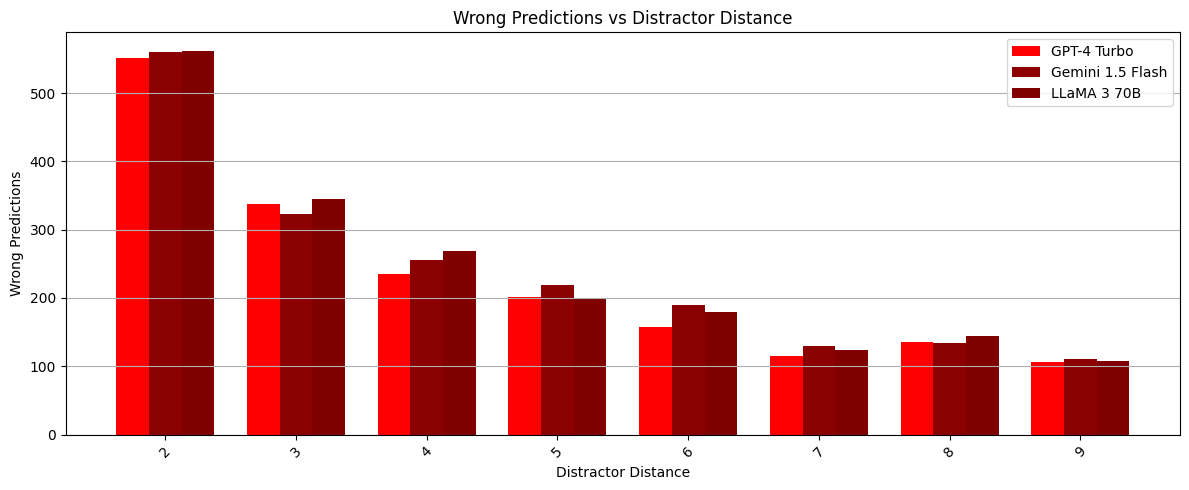

实验结果表明,所有模型在英语上的表现都很好,但在斯瓦希里语和豪萨语上的准确率显著下降,LLaMA 3表现最差。引入CoT提示后,LLaMA 3的准确率显著提升,但GPT-4和Gemini的性能反而下降。例如,在豪萨语上,LLaMA 3的准确率在CoT提示下提升了10%以上,而GPT-4和Gemini的准确率则下降了5%左右。

🎯 应用场景

该研究成果可应用于评估和改进大语言模型在多语言环境下的性能,尤其是在低资源语言上的应用。通过识别模型在不同语言上的弱点,可以指导模型训练和优化,提升其跨语言理解能力,从而促进自然语言处理技术在全球范围内的普及和应用,例如跨语言信息检索、机器翻译和多语言对话系统。

📄 摘要(原文)

While large language models are trained on massive datasets, this data is heavily skewed towards English. Does their impressive performance reflect genuine ability or just this data advantage? To find out, we tested them in a setting where they could not rely on data abundance: low-resource languages. Building on prior work Agarwal et al. (2025) that used Next Sentence Prediction (NSP) as a test, we created a large-scale benchmark with 10,000 questions each for English (a high-resource language), Swahili (medium-resource), and Hausa (low-resource). We then tested several top models, including GPT-4 Turbo, Gemini 1.5 Flash, and LLaMA 3 70B, to see how their performance holds up. The results painted a clear picture of how levels of language resources impact outcomes. While all models excelled in English, their accuracy dropped in Swahili and fell sharply in Hausa, with LLaMA 3 struggling the most. The story became even more interesting when we introduced Chain-of-Thought (CoT) prompting. For the struggling LLaMA 3, CoT acted as a helpful guide, significantly boosting its accuracy. However, for the more capable GPT-4 and Gemini, the same technique often backfired, leading to a kind of "overthinking" that hurt their results in the cross-lingual context. This reveals that Chain-of-Thought is not a universal solution; its effectiveness depends heavily on the model's baseline capability and the specific context of the task. Our framework pinpoints LLM weaknesses, highlights when CoT helps or hinders cross-lingual NSP performance, and factors influencing their decisions.