Mitigating Hallucination in Large Language Models (LLMs): An Application-Oriented Survey on RAG, Reasoning, and Agentic Systems

作者: Yihan Li, Xiyuan Fu, Ghanshyam Verma, Paul Buitelaar, Mingming Liu

分类: cs.CL, cs.AI

发布日期: 2025-10-28

备注: 25 pages, 7 figures, 3 tables

💡 一句话要点

综述性研究:面向应用,探讨RAG、推理和Agentic系统缓解大语言模型幻觉问题

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大语言模型 幻觉缓解 检索增强生成 推理增强 Agentic系统 知识型幻觉 逻辑型幻觉

📋 核心要点

- 现有大语言模型在实际应用中面临幻觉问题,严重影响其可靠性,成为部署的关键障碍。

- 论文核心在于从应用角度分析RAG、推理增强及其集成在Agentic系统中如何缓解幻觉,平衡创造性与可靠性。

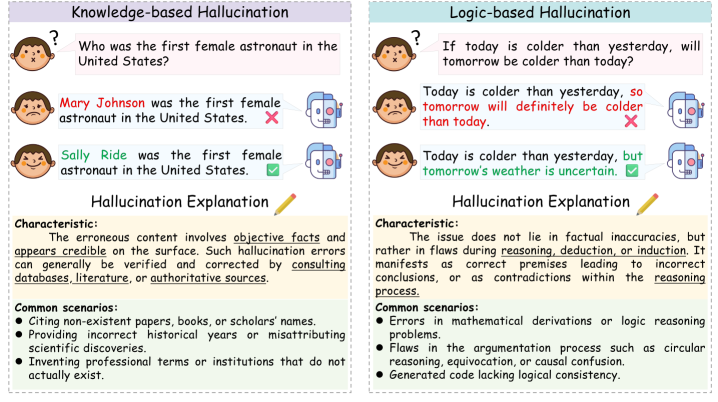

- 论文提出了区分知识型和逻辑型幻觉的分类法,并构建统一框架,通过实际应用、评估和基准进行验证。

📝 摘要(中文)

幻觉是大语言模型(LLMs)可靠部署的关键障碍之一,尤其是在实际应用中。在各种缓解策略中,检索增强生成(RAG)和推理增强已成为两种最有效和最广泛采用的方法,标志着从仅仅抑制幻觉到平衡创造性和可靠性的转变。然而,它们在缓解幻觉方面的协同潜力和潜在机制尚未得到系统地检验。本综述采用面向应用的视角,通过能力增强来分析RAG、推理增强及其在Agentic系统中集成如何缓解幻觉。我们提出了一个区分基于知识和基于逻辑的幻觉的分类法,系统地研究了RAG和推理如何解决每种幻觉,并提出了一个由实际应用、评估和基准支持的统一框架。

🔬 方法详解

问题定义:论文旨在解决大语言模型(LLMs)在实际应用中存在的幻觉问题。现有方法,如单纯抑制幻觉,无法很好地平衡创造性和可靠性。此外,检索增强生成(RAG)和推理增强这两种有效策略的协同潜力和内在机制尚未被充分研究。

核心思路:论文的核心思路是从应用角度出发,系统性地分析RAG、推理增强以及它们在Agentic系统中的集成如何缓解LLMs的幻觉问题。通过能力增强的视角,深入理解这些方法如何提升LLMs的可靠性。

技术框架:论文构建了一个统一的框架,用于分析RAG和推理增强在缓解幻觉方面的作用。该框架包括以下几个关键部分:1) 提出了一种新的幻觉分类法,区分了基于知识的幻觉和基于逻辑的幻觉;2) 系统性地研究了RAG和推理增强如何分别解决这两种类型的幻觉;3) 通过实际应用、评估和基准测试来验证该框架的有效性。

关键创新:论文的关键创新在于:1) 提出了一个区分知识型和逻辑型幻觉的分类法,为更精确地分析和解决幻觉问题提供了基础;2) 系统性地研究了RAG和推理增强在缓解不同类型幻觉方面的作用机制,揭示了它们之间的协同潜力;3) 构建了一个统一的框架,将RAG、推理增强和Agentic系统整合起来,为缓解LLMs的幻觉问题提供了一个全面的解决方案。

关键设计:论文并没有涉及具体的参数设置、损失函数或网络结构的设计,而更侧重于对现有方法的分析和整合。关键设计体现在其分类框架和统一框架的构建上,这些框架为理解和解决LLMs的幻觉问题提供了新的视角和方法。

🖼️ 关键图片

📊 实验亮点

该综述论文的主要亮点在于提出了一个区分知识型和逻辑型幻觉的分类法,并在此基础上系统地分析了RAG和推理增强在缓解不同类型幻觉方面的作用机制。此外,论文构建了一个统一的框架,将RAG、推理增强和Agentic系统整合起来,为缓解LLMs的幻觉问题提供了一个全面的解决方案。论文通过实际应用案例、评估和基准测试来验证了所提出的框架的有效性。

🎯 应用场景

该研究成果可广泛应用于需要高度可靠性的大语言模型应用场景,例如智能客服、医疗诊断、金融分析等。通过结合RAG、推理增强和Agentic系统,可以显著降低LLMs产生幻觉的风险,提升其在实际应用中的可信度和实用价值,推动LLMs在各行业的更广泛应用。

📄 摘要(原文)

Hallucination remains one of the key obstacles to the reliable deployment of large language models (LLMs), particularly in real-world applications. Among various mitigation strategies, Retrieval-Augmented Generation (RAG) and reasoning enhancement have emerged as two of the most effective and widely adopted approaches, marking a shift from merely suppressing hallucinations to balancing creativity and reliability. However, their synergistic potential and underlying mechanisms for hallucination mitigation have not yet been systematically examined. This survey adopts an application-oriented perspective of capability enhancement to analyze how RAG, reasoning enhancement, and their integration in Agentic Systems mitigate hallucinations. We propose a taxonomy distinguishing knowledge-based and logic-based hallucinations, systematically examine how RAG and reasoning address each, and present a unified framework supported by real-world applications, evaluations, and benchmarks.