Beyond MCQ: An Open-Ended Arabic Cultural QA Benchmark with Dialect Variants

作者: Hunzalah Hassan Bhatti, Firoj Alam

分类: cs.CL, cs.AI

发布日期: 2025-10-28

备注: Cultural Knowledge, Everyday Knowledge, Open-Ended Question, Chain-of-Thought, Large Language Models, Native, Multilingual, Language Diversity

💡 一句话要点

提出开放式阿拉伯文化问答基准以解决方言变体问题

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 阿拉伯语处理 开放式问答 方言变体 大型语言模型 文化评估

📋 核心要点

- 现有的语言模型在处理阿拉伯方言和文化内容时表现不均,缺乏针对性的评估基准。

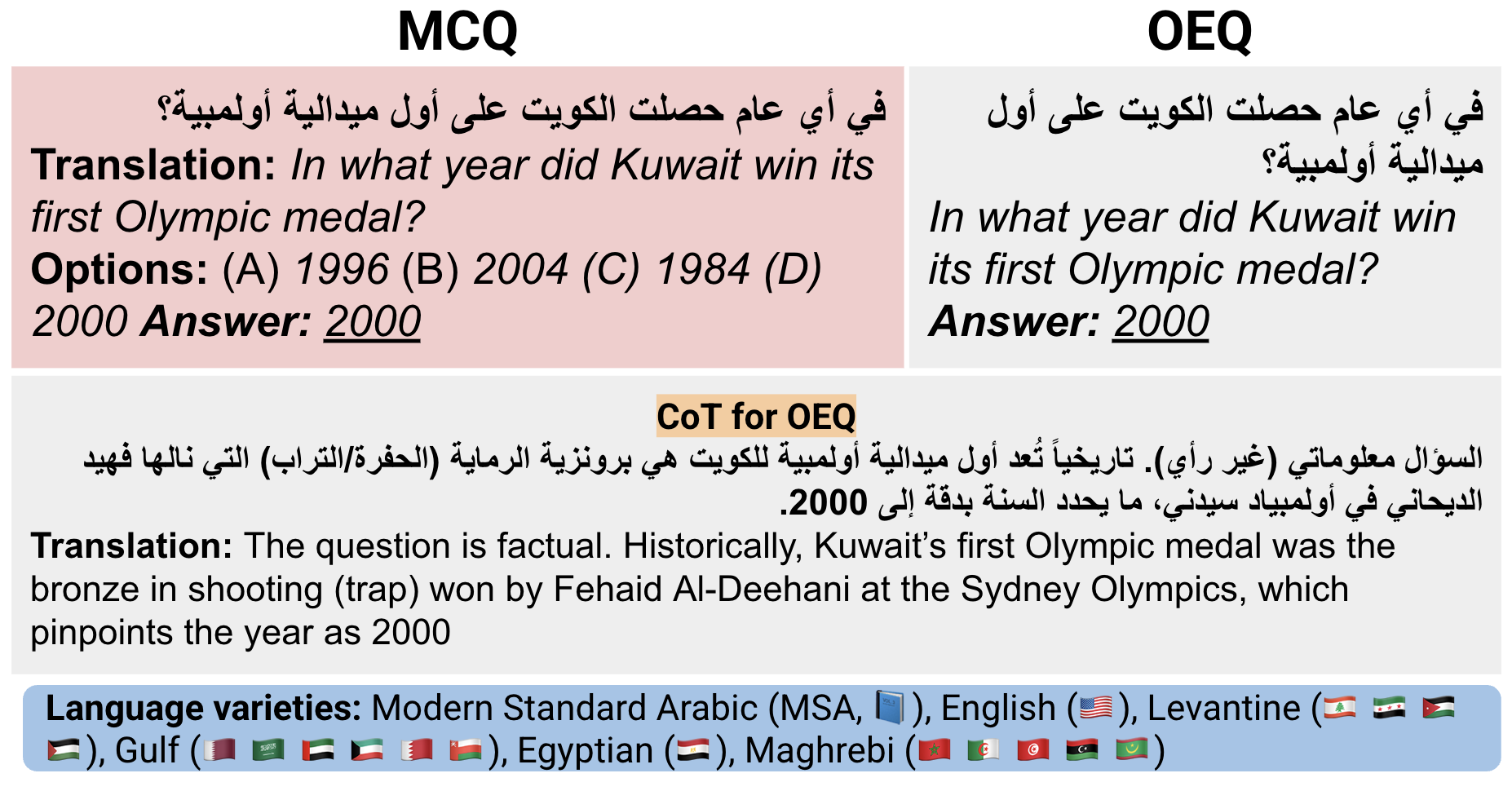

- 提出的方法包括将多项选择题转换为开放式问题,并在多种语言变体中进行基准测试,增强模型的推理能力。

- 实验结果显示,阿拉伯方言模型表现不佳,且CoT方法在提升判断正确性方面具有潜力。

📝 摘要(中文)

大型语言模型(LLMs)在回答日常问题时的表现因文化背景和方言内容而异。本文提出了一种综合方法,首先将现代标准阿拉伯语的多项选择题翻译为英语及多种阿拉伯方言,接着将其转换为开放式问题,并在多种零样本和微调的LLMs下进行基准测试。此外,生成的思维链(CoT)推理过程用于微调模型以实现逐步推理。通过这一方法,扩展了现有数据集,使其在多种语言变体中平行对齐,成为首个此类数据集。实验结果表明,阿拉伯方言的模型表现不佳,阿拉伯中心模型在多项选择题上表现良好但在开放式问题上存在困难,而CoT在判断正确性上有所提升。

🔬 方法详解

问题定义:本文旨在解决大型语言模型在阿拉伯文化和方言内容上的表现不足,现有方法未能有效评估和处理这些内容的多样性。

核心思路:通过将现代标准阿拉伯语的多项选择题翻译为多种方言和英语,并转换为开放式问题,增强模型的适应性和推理能力。

技术框架:整体流程包括四个主要模块:翻译模块、问题转换模块、基准测试模块和推理生成模块。每个模块协同工作,以实现全面的评估和优化。

关键创新:本研究的创新在于首次构建了一个多语言变体对齐的数据集,并通过开放式问题的形式提升了模型的推理能力,区别于传统的多项选择题评估。

关键设计:在模型微调过程中,采用了链式推理(CoT)方法,优化了损失函数和网络结构,以提高模型在开放式问题上的表现。

🖼️ 关键图片

📊 实验亮点

实验结果表明,阿拉伯方言模型的表现明显低于标准模型,尤其在开放式问题上,阿拉伯中心模型在多项选择题中表现良好,但在开放式问题上存在显著的性能下降。使用CoT方法后,模型的判断正确性有所提升,但在n-gram基础的指标上结果不一。

🎯 应用场景

该研究的潜在应用领域包括教育、文化研究和自然语言处理,尤其是在需要处理多种阿拉伯方言的场景中。通过提供一个开放式问答基准,研究者和开发者可以更好地评估和优化语言模型的性能,从而推动阿拉伯语处理技术的发展。

📄 摘要(原文)

Large Language Models (LLMs) are increasingly used to answer everyday questions, yet their performance on culturally grounded and dialectal content remains uneven across languages. We propose a comprehensive method that (i) translates Modern Standard Arabic (MSA) multiple-choice questions (MCQs) into English and several Arabic dialects, (ii) converts them into open-ended questions (OEQs), (iii) benchmarks a range of zero-shot and fine-tuned LLMs under both MCQ and OEQ settings, and (iv) generates chain-of-thought (CoT) rationales to fine-tune models for step-by-step reasoning. Using this method, we extend an existing dataset in which QAs are parallelly aligned across multiple language varieties, making it, to our knowledge, the first of its kind. We conduct extensive experiments with both open and closed models. Our findings show that (i) models underperform on Arabic dialects, revealing persistent gaps in culturally grounded and dialect-specific knowledge; (ii) Arabic-centric models perform well on MCQs but struggle with OEQs; and (iii) CoT improves judged correctness while yielding mixed n-gram-based metrics. The developed dataset will be publicly released to support further research on culturally and linguistically inclusive evaluation.