How Pragmatics Shape Articulation: A Computational Case Study in STEM ASL Discourse

作者: Saki Imai, Lee Kezar, Laurel Aichler, Mert Inan, Erin Walker, Alicia Wooten, Lorna Quandt, Malihe Alikhani

分类: cs.CL

发布日期: 2025-10-27

💡 一句话要点

针对STEM ASL语篇,提出结合语用学的动态手语表达建模方法

🎯 匹配领域: 支柱八:物理动画 (Physics-based Animation)

关键词: 美国手语 语用学 动作捕捉 STEM教育 手语识别

📋 核心要点

- 现有手语模型忽略了自然对话中手语表达的动态变化和语境依赖性。

- 通过构建STEM ASL对话数据集,分析手语表达在不同语境下的时空变化。

- 实验表明对话手语时长显著缩短,并验证了手语嵌入模型对语境适应性的识别能力。

📝 摘要(中文)

当前的手语模型大多基于口译或孤立词汇数据训练,忽略了自然对话中的变异性。本文关注教育场景下手语交流的动态适应性,通过收集美国手语(ASL)STEM(科学、技术、工程和数学)对话的动作捕捉数据集,量化比较了二元互动、独白讲座和口译文章中的手语表达。研究表明,对话中的手语表达与个体努力程度降低有关,并呈现出STEM术语重复出现时的时空变化。对话中的手语时长平均比孤立手语短24.6%-44.6%,且这种缩短在独白语境中不明显。最后,评估了手语嵌入模型识别STEM手语的能力,并近似估计参与者随时间推移的语境适应程度。该研究将语言学分析和计算建模相结合,旨在理解语用学如何影响手语表达及其在手语技术中的表示。

🔬 方法详解

问题定义:现有手语识别模型主要基于口译或孤立词汇数据训练,缺乏对自然对话场景下手语表达变异性的建模能力。特别是在教育场景中,师生之间会使用新的词汇和表达方式,这种动态适应性是现有模型所忽略的。因此,需要研究语用学如何影响手语表达,并将其融入到手语技术中。

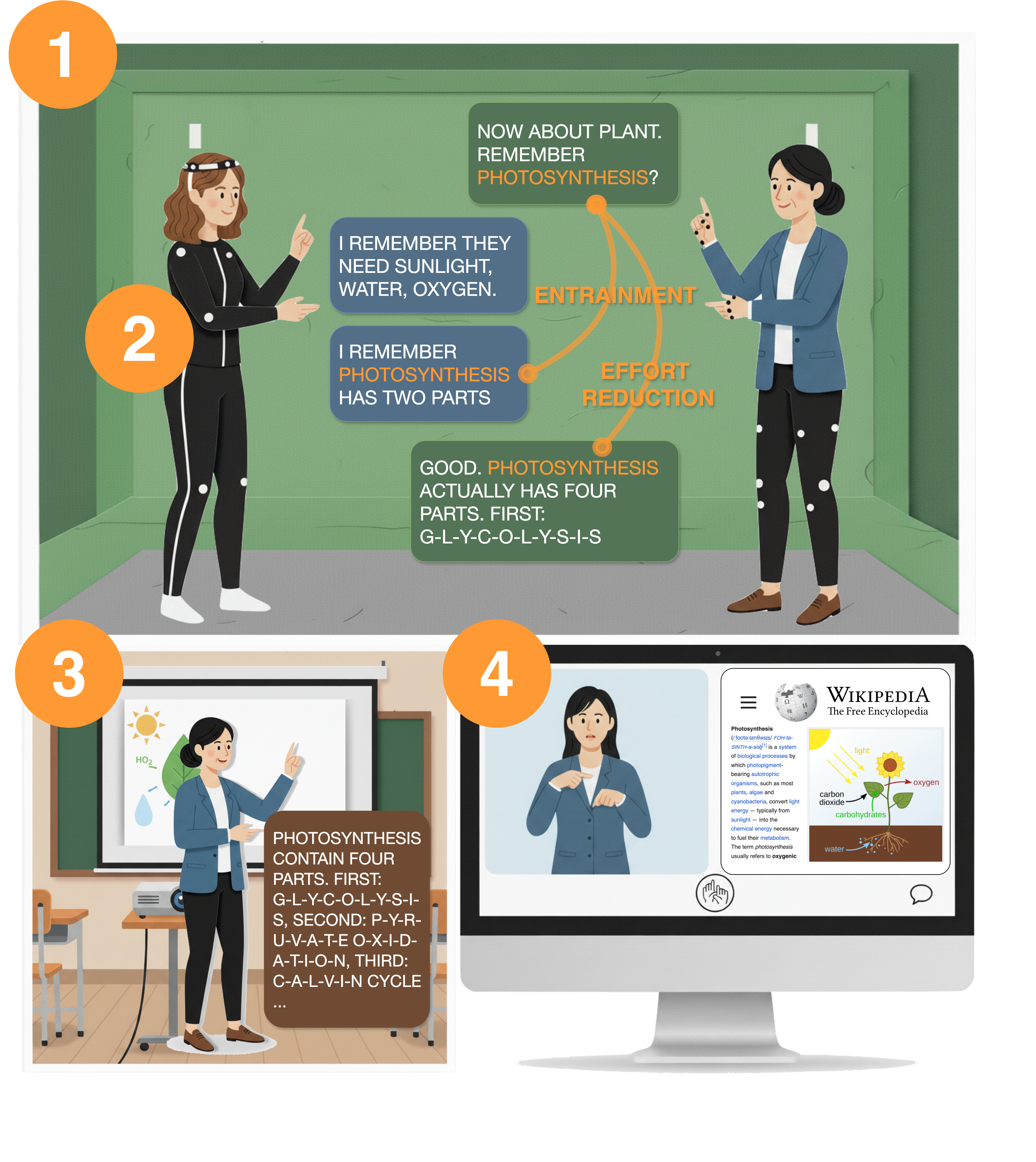

核心思路:本文的核心思路是通过收集不同语境下的手语数据(二元互动、独白讲座、口译文章),分析手语表达的时空变化,从而揭示语用学对表达的影响。通过比较不同语境下手语表达的差异,可以区分个体努力程度的降低和对话语境下的语用适应性。

技术框架:整体框架包括数据采集、特征提取、模型训练和评估四个阶段。首先,使用动作捕捉技术收集ASL STEM对话数据集。然后,提取连续运动学特征,用于分析手语表达的时空变化。接着,训练手语嵌入模型,用于识别STEM手语并评估语境适应程度。最后,通过对比不同语境下的手语表达和模型性能,分析语用学的影响。

关键创新:本文的关键创新在于:1) 构建了一个包含多种语境的ASL STEM对话数据集,为研究语用学对表达的影响提供了数据基础。2) 提出了基于连续运动学特征的分析方法,能够量化手语表达的时空变化。3) 将语言学分析和计算建模相结合,探索了语用学如何影响手语表达及其在手语技术中的表示。

关键设计:数据集包含二元互动、独白讲座和口译文章三种语境。运动学特征包括手的位置、速度、加速度等。手语嵌入模型采用常见的神经网络结构,如LSTM或Transformer。损失函数用于优化模型,使其能够准确识别STEM手语并区分不同语境下的表达。

🖼️ 关键图片

📊 实验亮点

实验结果表明,对话中的手语时长平均比孤立手语短24.6%-44.6%,且这种缩短在独白语境中不明显,验证了对话语境下手语表达的语用适应性。手语嵌入模型能够识别STEM手语,并近似估计参与者随时间推移的语境适应程度,为手语识别和翻译提供了新的思路。

🎯 应用场景

该研究成果可应用于开发更自然、更智能的手语翻译系统,尤其是在教育领域,能够帮助学生更好地理解和学习STEM知识。此外,该研究也有助于提升人机交互的自然性和流畅性,促进手语在更广泛场景下的应用,例如远程会议、在线教育等。

📄 摘要(原文)

Most state-of-the-art sign language models are trained on interpreter or isolated vocabulary data, which overlooks the variability that characterizes natural dialogue. However, human communication dynamically adapts to contexts and interlocutors through spatiotemporal changes and articulation style. This specifically manifests itself in educational settings, where novel vocabularies are used by teachers, and students. To address this gap, we collect a motion capture dataset of American Sign Language (ASL) STEM (Science, Technology, Engineering, and Mathematics) dialogue that enables quantitative comparison between dyadic interactive signing, solo signed lecture, and interpreted articles. Using continuous kinematic features, we disentangle dialogue-specific entrainment from individual effort reduction and show spatiotemporal changes across repeated mentions of STEM terms. On average, dialogue signs are 24.6%-44.6% shorter in duration than the isolated signs, and show significant reductions absent in monologue contexts. Finally, we evaluate sign embedding models on their ability to recognize STEM signs and approximate how entrained the participants become over time. Our study bridges linguistic analysis and computational modeling to understand how pragmatics shape sign articulation and its representation in sign language technologies.