Think Twice: Branch-and-Rethink Reasoning Reward Model

作者: Yizhu Jiao, Jiaqi Zeng, Julien Veron Vialard, Oleksii Kuchaiev, Jiawei Han, Olivier Delalleau

分类: cs.CL

发布日期: 2025-10-27 (更新: 2026-01-29)

备注: Source Code: https://github.com/yzjiao/BR-RM. Model Checkpoints: https://huggingface.co/nvidia/Qwen3-Nemotron-14B-BRRM and https://huggingface.co/nvidia/Qwen3-Nemotron-8B-BRRM

💡 一句话要点

提出Branch-and-Rethink奖励模型,通过两次思考提升奖励建模的准确性和效率。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 奖励模型 两次思考 强化学习 语言模型 对齐训练

📋 核心要点

- 现有奖励模型一次性压缩多个质量维度,导致判断扩散,降低了对细微错误的敏感性。

- BR-RM采用两次思考策略,第一轮选择关键维度并生成假设,第二轮有针对性地验证假设。

- 实验表明,BR-RM在多个奖励建模基准上取得了SOTA性能,提高了奖励建模的准确性。

📝 摘要(中文)

大型语言模型(LLM)越来越多地依赖于外部化中间步骤并分配额外测试时计算的思考模型,其中“两次思考”策略表明,有意的第二次处理可以引发更强的推理能力。相比之下,大多数奖励模型(RM)仍然一次性地将多个质量维度压缩成一个标量,这种设计导致了判断扩散:注意力分散在评估标准上,导致关注度稀释和分析肤浅。我们引入了branch-and-rethink(BR-RM),这是一种两轮RM,将“两次思考”原则转移到奖励建模中。第一轮执行自适应分支,选择一小组实例关键维度(如事实性和安全性),并勾勒出简洁的、寻求证据的假设。第二轮执行分支条件下的重新思考,这是一种有针对性的重读,测试这些假设,并只审查最重要的内容。我们使用GRPO风格的强化学习,通过结构化的两轮轨迹,使用简单的二元结果奖励和严格的格式检查进行训练,使该方法与标准的RLHF流程兼容。通过将一次性评分转化为专注的、第二次观察的推理,BR-RM减少了判断扩散,提高了对细微但重要的错误的敏感性,同时保持了实用性和可扩展性。实验结果表明,我们的模型在三个具有挑战性的、跨领域的奖励建模基准上实现了最先进的性能。

🔬 方法详解

问题定义:现有奖励模型(RM)在评估LLM生成内容的质量时,通常采用“一蹴而就”的方式,将多个维度(如事实性、安全性等)压缩成单一标量奖励。这种方式导致“判断扩散”,即注意力分散,无法深入分析,对细微但重要的错误不敏感。因此,需要一种更精细、更高效的奖励建模方法。

核心思路:BR-RM的核心思想是将“两次思考”的策略引入奖励建模。类似于人类在复杂决策时会进行初步评估和二次复核,BR-RM也分为两个阶段:第一阶段(分支)快速识别关键维度并形成假设;第二阶段(重新思考)则有针对性地验证这些假设。这种分阶段、有重点的评估方式可以减少判断扩散,提高对关键错误的敏感性。

技术框架:BR-RM的整体框架包含两个主要阶段:1) 自适应分支(Adaptive Branching):该阶段接收LLM的生成内容作为输入,模型选择一小组对当前实例至关重要的维度(例如,如果内容涉及医疗信息,则事实性和安全性可能成为关键维度)。然后,模型针对这些维度提出简洁的、寻求证据的假设。2) 分支条件下的重新思考(Branch-Conditioned Rethinking):该阶段接收第一阶段选择的维度和假设作为条件,对LLM的生成内容进行有针对性的重读。模型专注于验证第一阶段提出的假设,并给出最终的奖励评分。整个模型使用GRPO风格的强化学习进行训练,使用二元结果奖励和严格的格式检查,保证与标准RLHF流程的兼容性。

关键创新:BR-RM的关键创新在于将“两次思考”的策略应用于奖励建模,通过分阶段、有重点的评估来减少判断扩散。与传统的“一蹴而就”的奖励模型相比,BR-RM能够更深入地分析LLM生成内容的质量,并对细微但重要的错误更加敏感。此外,BR-RM采用自适应分支策略,能够根据不同的实例动态选择关键维度,提高了模型的灵活性和适应性。

关键设计:BR-RM使用简单的二元结果奖励进行训练,简化了训练过程。模型使用GRPO风格的强化学习,并采用严格的格式检查,保证了与标准RLHF流程的兼容性。具体网络结构和参数设置在论文中未详细说明,属于未知信息。

🖼️ 关键图片

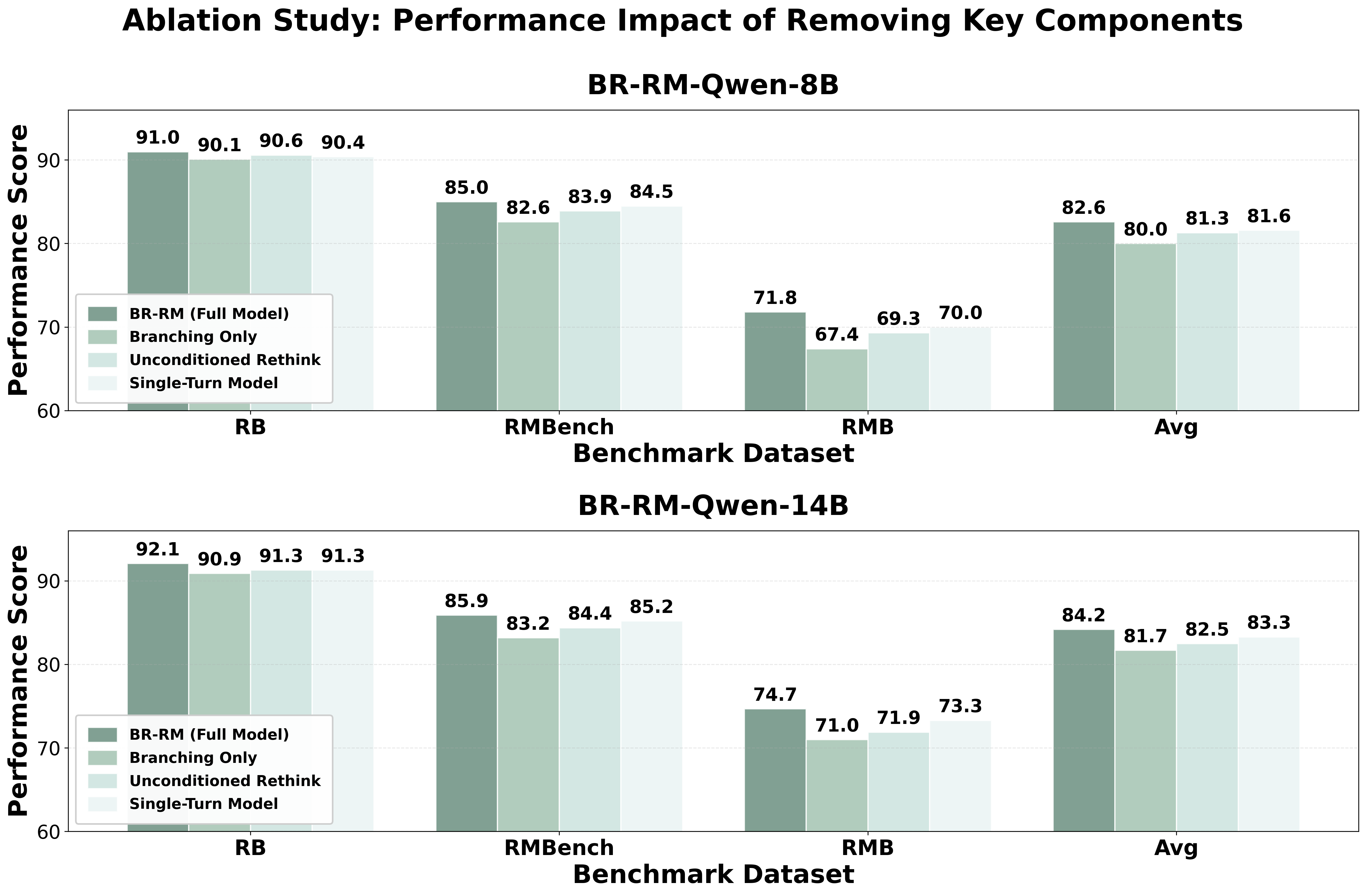

📊 实验亮点

实验结果表明,BR-RM在三个具有挑战性的奖励建模基准上取得了SOTA性能。具体性能数据和对比基线在论文中未详细说明,属于未知信息。但总体而言,BR-RM显著提高了奖励建模的准确性和效率,证明了“两次思考”策略在奖励建模中的有效性。

🎯 应用场景

BR-RM可广泛应用于各种需要高质量奖励模型的场景,例如:LLM的对齐训练、对话系统评估、内容生成质量评估等。通过提高奖励模型的准确性和效率,BR-RM可以帮助LLM更好地理解人类意图,生成更安全、更可靠的内容,从而推动人工智能技术的进步。

📄 摘要(原文)

Large language models (LLMs) increasingly rely on thinking models that externalize intermediate steps and allocate extra test-time compute, with think-twice strategies showing that a deliberate second pass can elicit stronger reasoning. In contrast, most reward models (RMs) still compress many quality dimensions into a single scalar in one shot, a design that induces judgment diffusion: attention spreads across evaluation criteria, yielding diluted focus and shallow analysis. We introduce branch-and-rethink (BR-RM), a two-turn RM that transfers the think-twice principle to reward modeling. Turn 1 performs adaptive branching, selecting a small set of instance-critical dimensions (such as factuality and safety) and sketching concise, evidence-seeking hypotheses. Turn 2 executes branch-conditioned rethinking, a targeted reread that tests those hypotheses and scrutinizes only what matters most. We train with GRPO-style reinforcement learning over structured two-turn traces using a simple binary outcome reward with strict format checks, making the approach compatible with standard RLHF pipelines. By converting all-at-once scoring into focused, second-look reasoning, BR-RM reduces judgment diffusion and improves sensitivity to subtle yet consequential errors while remaining practical and scalable. Experimental results demonstrate that our model achieves state-of-the-art performance on three challenging reward modeling benchmarks across diverse domains.