How AI Forecasts AI Jobs: Benchmarking LLM Predictions of Labor Market Changes

作者: Sheri Osborn, Rohit Valecha, H. Raghav Rao, Dan Sass, Anthony Rios

分类: cs.CL

发布日期: 2025-10-27

备注: 8 pages + Limitations + References

💡 一句话要点

提出基于LLM的劳动力市场预测基准,评估AI对就业的影响。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 劳动力市场预测 大型语言模型 AI影响 就业预测 基准测试

📋 核心要点

- 现有方法难以系统性预测AI对劳动力市场的影响,缺乏有效工具。

- 论文提出一个基准,利用LLM预测职位需求变化,并结合多种提示策略。

- 实验表明,结构化任务提示能提高预测稳定性,角色提示在短期趋势上表现更优。

📝 摘要(中文)

人工智能正在重塑劳动力市场,但我们缺乏系统性预测其对就业影响的工具。本文提出了一个基准,用于评估大型语言模型(LLM)预测职位需求变化的能力,尤其是在受AI影响的职业中。现有研究表明,LLM可以提取情感、总结经济报告并模拟预测者行为,但很少有工作评估它们在预测劳动力方面的应用。我们的基准结合了两个互补的数据集:美国行业层面职位发布的的高频指数,以及全球范围内因AI采用而导致的职业变化预测数据集。我们将这些数据格式化为具有清晰时间分割的预测任务,最大限度地减少信息泄露的风险。然后,我们使用多种提示策略评估LLM,比较跨模型系列的基于任务、基于角色和混合方法。我们评估了定量准确性和随时间的定性一致性。结果表明,结构化任务提示始终提高预测稳定性,而角色提示在短期趋势上具有优势。但是,性能在不同行业和时间范围内差异很大,突出了领域感知提示和严格评估协议的必要性。通过发布我们的基准,我们旨在支持未来对劳动力预测、提示设计和基于LLM的经济推理的研究。这项工作有助于越来越多的关于LLM如何与现实世界经济数据交互的研究,并为研究AI作为劳动力市场预测工具的局限性和机会提供了一个可重复的测试平台。

🔬 方法详解

问题定义:论文旨在解决如何利用大型语言模型(LLM)预测人工智能对劳动力市场,特别是不同行业和职业的就业需求变化的影响。现有方法缺乏系统性,难以准确预测AI技术进步带来的劳动力市场动态变化,并且缺乏统一的评估标准。

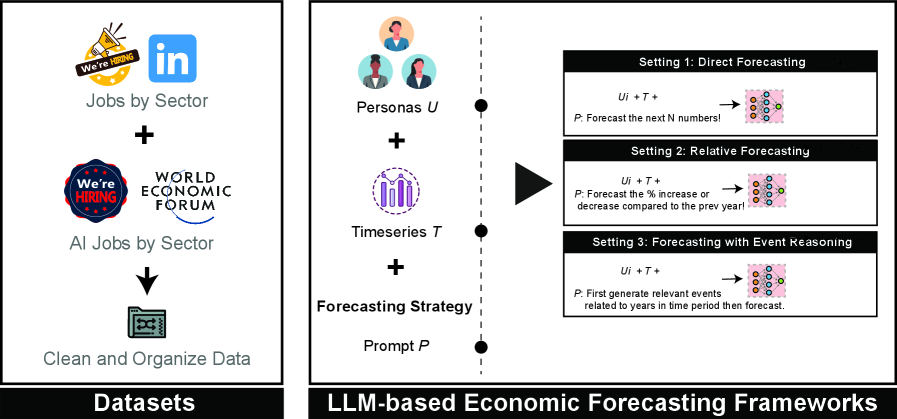

核心思路:论文的核心思路是构建一个基准测试,通过将劳动力市场数据(职位发布和职业变化预测)转化为LLM可处理的预测任务,并结合不同的提示策略(任务型、角色型和混合型),来评估LLM预测劳动力市场变化的能力。通过比较不同提示策略和模型在不同行业和时间范围内的表现,揭示LLM在劳动力市场预测中的优势和局限性。

技术框架:该研究的技术框架主要包括以下几个阶段:1) 数据收集与预处理:收集美国行业层面职位发布的高频指数和全球范围内因AI采用而导致的职业变化预测数据集。2) 任务构建:将收集到的数据格式化为具有清晰时间分割的预测任务,以避免信息泄露。3) 模型选择与提示设计:选择多种LLM模型,并设计不同的提示策略,包括任务型提示(强调任务目标)、角色型提示(模拟经济预测专家)和混合型提示。4) 实验评估:使用不同的提示策略和模型进行预测,并评估其定量准确性和随时间的定性一致性。

关键创新:论文的关键创新在于构建了一个专门用于评估LLM在劳动力市场预测能力的基准测试。该基准测试结合了真实世界的劳动力市场数据和多种提示策略,能够系统地评估LLM在不同行业和时间范围内的预测性能。此外,论文还比较了不同提示策略的优劣,为未来的LLM应用提供了指导。

关键设计:在提示设计方面,论文探索了任务型提示、角色型提示和混合型提示。任务型提示侧重于明确预测任务的目标和约束条件,例如“预测未来三个月软件工程师的职位需求变化”。角色型提示则模拟经济预测专家的身份,例如“你是一位资深的劳动力市场分析师,请预测...”。混合型提示则结合了任务型和角色型提示的优点。在评估指标方面,论文同时考虑了定量准确性(例如,预测误差)和定性一致性(例如,预测趋势的稳定性)。

🖼️ 关键图片

📊 实验亮点

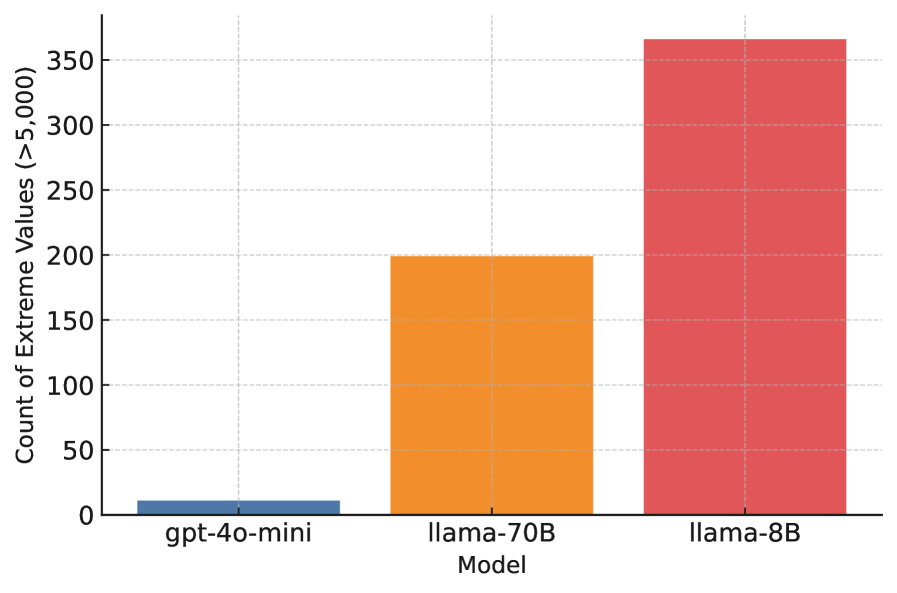

实验结果表明,结构化任务提示能够持续提高预测的稳定性,而角色提示在短期趋势预测上表现出优势。然而,模型性能在不同行业和时间跨度上存在显著差异,强调了领域知识和严格评估协议的重要性。该基准的发布为未来劳动力预测、提示工程和基于LLM的经济推理研究奠定了基础。

🎯 应用场景

该研究成果可应用于劳动力市场分析、职业规划、教育培训等领域。政府和企业可以利用该基准和方法,预测AI技术发展对就业的影响,制定相应的政策和战略,以应对劳动力市场的变化。个人可以利用预测结果,选择更有前景的职业方向,提升自身竞争力。教育机构可以根据预测结果,调整课程设置,培养符合市场需求的技能人才。

📄 摘要(原文)

Artificial intelligence is reshaping labor markets, yet we lack tools to systematically forecast its effects on employment. This paper introduces a benchmark for evaluating how well large language models (LLMs) can anticipate changes in job demand, especially in occupations affected by AI. Existing research has shown that LLMs can extract sentiment, summarize economic reports, and emulate forecaster behavior, but little work has assessed their use for forward-looking labor prediction. Our benchmark combines two complementary datasets: a high-frequency index of sector-level job postings in the United States, and a global dataset of projected occupational changes due to AI adoption. We format these data into forecasting tasks with clear temporal splits, minimizing the risk of information leakage. We then evaluate LLMs using multiple prompting strategies, comparing task-scaffolded, persona-driven, and hybrid approaches across model families. We assess both quantitative accuracy and qualitative consistency over time. Results show that structured task prompts consistently improve forecast stability, while persona prompts offer advantages on short-term trends. However, performance varies significantly across sectors and horizons, highlighting the need for domain-aware prompting and rigorous evaluation protocols. By releasing our benchmark, we aim to support future research on labor forecasting, prompt design, and LLM-based economic reasoning. This work contributes to a growing body of research on how LLMs interact with real-world economic data, and provides a reproducible testbed for studying the limits and opportunities of AI as a forecasting tool in the context of labor markets.