Understanding In-Context Learning Beyond Transformers: An Investigation of State Space and Hybrid Architectures

作者: Shenran Wang, Timothy Tin-Long Tse, Jian Zhu

分类: cs.CL, cs.AI

发布日期: 2025-10-27

💡 一句话要点

深入探讨状态空间与混合架构中的上下文学习机制

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 上下文学习 状态空间模型 混合架构 功能向量 知识检索 行为探测 干预分析

📋 核心要点

- 现有的上下文学习方法在不同架构的表现相似,但其内部机制差异未被充分理解。

- 本研究通过行为探测与干预方法结合,深入分析不同架构的LLMs在ICL任务中的表现与机制。

- 实验结果表明,功能向量在参数知识检索中更为重要,而在上下文知识理解中影响较小,提供了新的理解视角。

📝 摘要(中文)

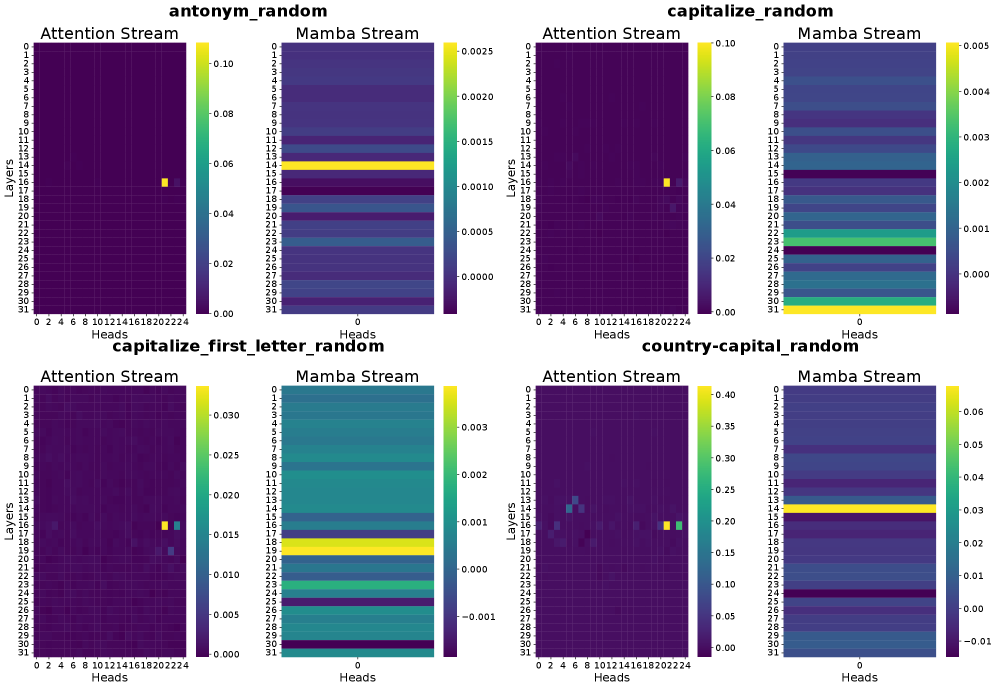

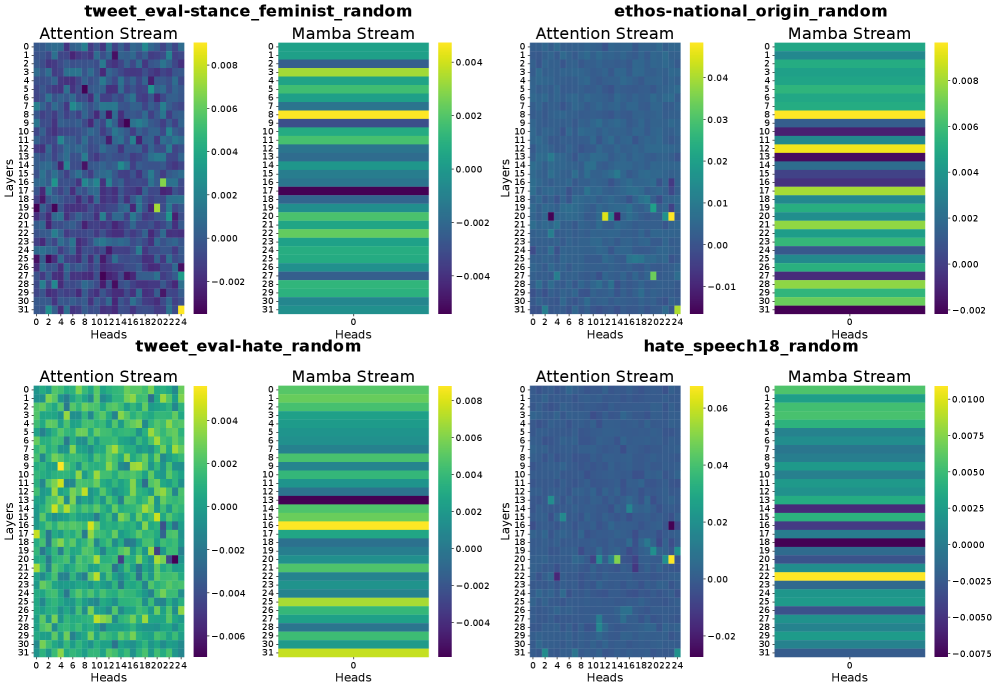

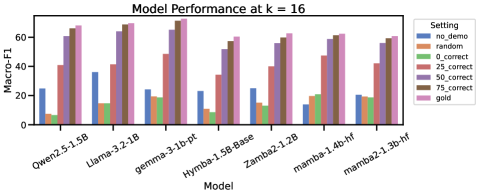

本研究对当前最先进的变换器、状态空间和混合大型语言模型在知识基础的上下文学习(ICL)任务中的表现进行了深入评估。通过行为探测和干预方法的结合,我们发现尽管不同架构的LLMs在任务性能上表现相似,但其内部机制却存在差异。我们发现负责ICL的功能向量(FVs)主要位于自注意力层和Mamba层,并推测Mamba2使用与FVs不同的机制来执行ICL。FVs在涉及参数知识检索的ICL中更为重要,但在上下文知识理解中并非如此。我们的工作为不同架构和任务类型之间的理解提供了更细致的视角,同时强调了结合行为与机制分析的重要性。

🔬 方法详解

问题定义:本研究旨在解决不同架构的LLMs在上下文学习中的表现相似但内部机制不同的问题,现有方法未能深入探讨这些差异。

核心思路:通过结合行为探测和干预方法,系统评估不同架构在知识基础ICL任务中的表现,揭示其内部机制的差异。

技术框架:研究采用了多种评估方法,包括行为探测和干预分析,重点分析自注意力层和Mamba层的功能向量。

关键创新:发现功能向量在不同架构中的分布及其对ICL的影响,尤其是Mamba2的不同机制,提供了对LLMs能力的新理解。

关键设计:研究中对功能向量的定位和作用进行了详细分析,特别是在参数知识检索和上下文知识理解中的不同重要性。

🖼️ 关键图片

📊 实验亮点

实验结果显示,功能向量在参数知识检索任务中显著提高了模型的表现,而在上下文知识理解任务中影响较小。这一发现为模型架构的优化提供了重要依据,推动了对不同架构LLMs能力的深入理解。

🎯 应用场景

该研究的潜在应用领域包括自然语言处理、智能问答系统和知识图谱构建等。通过深入理解不同架构的上下文学习机制,可以优化模型设计,提高其在复杂任务中的表现,推动人工智能的实际应用和发展。

📄 摘要(原文)

We perform in-depth evaluations of in-context learning (ICL) on state-of-the-art transformer, state-space, and hybrid large language models over two categories of knowledge-based ICL tasks. Using a combination of behavioral probing and intervention-based methods, we have discovered that, while LLMs of different architectures can behave similarly in task performance, their internals could remain different. We discover that function vectors (FVs) responsible for ICL are primarily located in the self-attention and Mamba layers, and speculate that Mamba2 uses a different mechanism from FVs to perform ICL. FVs are more important for ICL involving parametric knowledge retrieval, but not for contextual knowledge understanding. Our work contributes to a more nuanced understanding across architectures and task types. Methodologically, our approach also highlights the importance of combining both behavioural and mechanistic analyses to investigate LLM capabilities.