MMPersuade: A Dataset and Evaluation Framework for Multimodal Persuasion

作者: Haoyi Qiu, Yilun Zhou, Pranav Narayanan Venkit, Kung-Hsiang Huang, Jiaxin Zhang, Nanyun Peng, Chien-Sheng Wu

分类: cs.CL

发布日期: 2025-10-26

💡 一句话要点

MMPersuade:多模态说服数据集与评估框架,用于评估大型视觉语言模型的说服力

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态说服 视觉语言模型 数据集 评估框架 模型鲁棒性

📋 核心要点

- 大型视觉语言模型易受多模态说服内容影响,可能导致误导性信念或不安全输出,现有研究缺乏系统性的评估框架。

- MMPersuade框架通过构建多模态数据集,结合既定的说服原则,并设计评估指标,系统研究LVLMs中的说服动态。

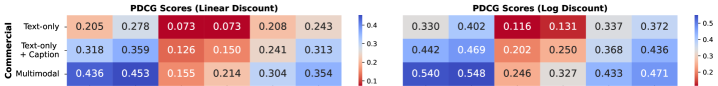

- 实验表明,多模态输入显著增强了说服效果,模型对错误信息的敏感性增加,且不同说服策略在不同场景下效果各异。

📝 摘要(中文)

随着大型视觉语言模型(LVLMs)越来越多地应用于购物、健康和新闻等领域,它们面临着普遍的说服性内容。一个关键问题是这些模型作为被说服者的功能——它们如何以及为何会被有说服力的多模态输入所影响。理解它们对说服的敏感性以及不同说服策略的有效性至关重要,因为过度容易被说服的模型可能会采纳误导性信念,覆盖用户偏好,或者在接触到操纵性信息时生成不道德或不安全的输出。我们引入了MMPersuade,这是一个统一的框架,用于系统地研究LVLMs中的多模态说服动态。MMPersuade贡献了(i)一个全面的多模态数据集,该数据集将图像和视频与商业、主观和行为以及对抗性环境中的既定说服原则配对,以及(ii)一个评估框架,该框架通过第三方协议评分和对话历史记录上的自我估计token概率来量化说服有效性和模型敏感性。我们对六个领先的LVLMs作为被说服者的研究产生了三个关键见解:(i)与仅文本相比,多模态输入显着提高了说服有效性和模型敏感性,尤其是在错误信息场景中;(ii)声明的先前偏好降低了敏感性,但多模态信息保持其说服优势;(iii)不同的策略在不同环境中有效性不同,互惠在商业和主观环境中最为有效,而可信度和逻辑在对抗性环境中占主导地位。通过共同分析说服有效性和敏感性,MMPersuade为开发在与有说服力的多模态内容交互时具有鲁棒性、偏好一致性和道德对齐的模型提供了原则性基础。

🔬 方法详解

问题定义:论文旨在解决大型视觉语言模型(LVLMs)在面对多模态说服性内容时,容易受到影响并产生不安全或不道德输出的问题。现有方法缺乏对LVLMs说服力的系统性评估和理解,无法有效衡量模型在不同情境下的敏感性以及不同说服策略的有效性。

核心思路:论文的核心思路是构建一个统一的框架,包括一个全面的多模态数据集和一个评估框架,用于系统地研究LVLMs中的多模态说服动态。通过将图像和视频与既定的说服原则配对,并结合第三方协议评分和自我估计token概率,量化说服有效性和模型敏感性。

技术框架:MMPersuade框架主要包含两个部分:多模态数据集和评估框架。多模态数据集包含商业、主观和行为以及对抗性环境下的图像、视频和文本,并与既定的说服原则相关联。评估框架则通过第三方协议评分和自我估计token概率,量化说服有效性和模型敏感性,并分析不同说服策略的效果。

关键创新:论文的关键创新在于构建了一个统一的多模态说服评估框架,能够系统地研究LVLMs在面对多模态输入时的说服动态。与现有方法相比,MMPersuade不仅考虑了文本信息,还考虑了图像和视频等多模态信息,并结合了既定的说服原则,从而更全面地评估了模型的说服力。

关键设计:在数据集构建方面,论文精心设计了不同情境下的多模态数据,并与既定的说服原则相关联。在评估框架方面,论文采用了第三方协议评分和自我估计token概率两种指标,分别从外部和内部两个角度量化了说服有效性和模型敏感性。此外,论文还分析了不同说服策略在不同情境下的效果,为模型的设计和优化提供了指导。

🖼️ 关键图片

📊 实验亮点

实验结果表明,多模态输入显著提高了说服效果,尤其是在错误信息场景中。与仅文本输入相比,多模态输入的说服力更强。此外,研究发现,声明的先前偏好可以降低模型对说服的敏感性,但多模态信息仍然具有说服优势。不同说服策略在不同情境下效果各异,互惠在商业和主观环境中最为有效,而可信度和逻辑在对抗性环境中占主导地位。

🎯 应用场景

该研究成果可应用于提升大型视觉语言模型在购物、健康、新闻等领域的安全性与可靠性。通过评估和优化模型对说服性内容的抵抗能力,可以减少模型采纳误导性信息、覆盖用户偏好或生成不道德内容的可能性,从而构建更值得信赖的人工智能系统。

📄 摘要(原文)

As Large Vision-Language Models (LVLMs) are increasingly deployed in domains such as shopping, health, and news, they are exposed to pervasive persuasive content. A critical question is how these models function as persuadees-how and why they can be influenced by persuasive multimodal inputs. Understanding both their susceptibility to persuasion and the effectiveness of different persuasive strategies is crucial, as overly persuadable models may adopt misleading beliefs, override user preferences, or generate unethical or unsafe outputs when exposed to manipulative messages. We introduce MMPersuade, a unified framework for systematically studying multimodal persuasion dynamics in LVLMs. MMPersuade contributes (i) a comprehensive multimodal dataset that pairs images and videos with established persuasion principles across commercial, subjective and behavioral, and adversarial contexts, and (ii) an evaluation framework that quantifies both persuasion effectiveness and model susceptibility via third-party agreement scoring and self-estimated token probabilities on conversation histories. Our study of six leading LVLMs as persuadees yields three key insights: (i) multimodal inputs substantially increase persuasion effectiveness-and model susceptibility-compared to text alone, especially in misinformation scenarios; (ii) stated prior preferences decrease susceptibility, yet multimodal information maintains its persuasive advantage; and (iii) different strategies vary in effectiveness across contexts, with reciprocity being most potent in commercial and subjective contexts, and credibility and logic prevailing in adversarial contexts. By jointly analyzing persuasion effectiveness and susceptibility, MMPersuade provides a principled foundation for developing models that are robust, preference-consistent, and ethically aligned when engaging with persuasive multimodal content.