Text to Trust: Evaluating Fine-Tuning and LoRA Trade-offs in Language Models for Unfair Terms of Service Detection

作者: Noshitha Padma Pratyusha Juttu, Sahithi Singireddy, Sravani Gona, Sujal Timilsina

分类: cs.CL, cs.AI, cs.LG

发布日期: 2025-10-26

备注: 6 pages, including figures and tables. All experiments are reproducible. Code and fine-tuned models are publicly available on: GitHub: (https://github.com/Stimils02/UnfairTOSAgreementsDetection) and Hugging Face: (https://huggingface.co/Noshitha98)

💡 一句话要点

评估语言模型在不公平服务条款检测中微调与LoRA的权衡

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 法律NLP 服务条款 不公平条款检测 LoRA微调 参数高效学习

📋 核心要点

- 现有大型语言模型在法律领域的应用受限于完全微调的高昂成本,需要探索更高效的适应方法。

- 论文核心在于评估微调、LoRA等参数高效方法以及零样本提示在不公平服务条款检测中的性能权衡。

- 实验表明,完全微调精度最高,LoRA在降低内存成本的同时保持了较好的召回率,为实际应用提供了参考。

📝 摘要(中文)

大型语言模型(LLMs)已经改变了文本理解,但它们在特定法律领域的应用仍然受到完全微调成本的限制。本研究系统地评估了微调、参数高效适应(LoRA、QLoRA)和零样本提示策略在服务条款(ToS)文档中不公平条款检测方面的应用,这是法律NLP中的一个关键应用。我们微调了BERT和DistilBERT,将4位低秩适应(LoRA)应用于TinyLlama、LLaMA 3B/7B和SaulLM等模型,并在零样本设置中评估了GPT-4o和O-versions。在CLAUDETTE-ToS基准和多语言Scraper语料库上的实验表明,完全微调实现了最强的精确率-召回率平衡,而基于LoRA的模型以高达3倍的更低内存成本提供了具有竞争力的召回率。这些发现突出了高效和领域自适应LLM的实际设计权衡,为法律文本处理中的微调研究贡献了开放基线。

🔬 方法详解

问题定义:论文旨在解决大型语言模型(LLMs)在法律领域,特别是服务条款(ToS)文档中不公平条款检测任务中的应用问题。现有方法,如完全微调,虽然效果较好,但计算成本高昂,限制了其在资源受限场景下的应用。因此,需要探索更高效的领域自适应方法。

核心思路:论文的核心思路是通过比较完全微调、参数高效微调(LoRA、QLoRA)以及零样本提示等不同策略,来评估它们在不公平条款检测任务中的性能和资源消耗。通过权衡不同方法的精确率、召回率和内存成本,为实际应用提供设计参考。

技术框架:论文的技术框架主要包括以下几个阶段:1) 数据准备:使用CLAUDETTE-ToS基准和多语言Scraper语料库作为实验数据。2) 模型选择:选择BERT、DistilBERT、TinyLlama、LLaMA 3B/7B、SaulLM以及GPT-4o等模型进行实验。3) 方法实现:分别实现完全微调、LoRA/QLoRA微调以及零样本提示等方法。4) 性能评估:使用精确率、召回率等指标评估不同方法的性能,并比较它们的内存成本。

关键创新:论文的关键创新在于系统性地评估了不同微调策略(包括完全微调和参数高效微调)以及零样本提示在法律文本处理任务中的性能权衡。通过实验,论文揭示了LoRA等参数高效方法在降低内存成本的同时,能够保持与完全微调相近的性能,为实际应用提供了新的选择。

关键设计:论文的关键设计包括:1) LoRA的参数设置:针对不同模型,选择合适的LoRA秩(rank)和缩放因子(scaling factor)。2) 损失函数:使用交叉熵损失函数进行微调。3) 评估指标:使用精确率、召回率和F1值等指标评估模型性能。4) 硬件环境:在不同的GPU上进行实验,并记录内存消耗。

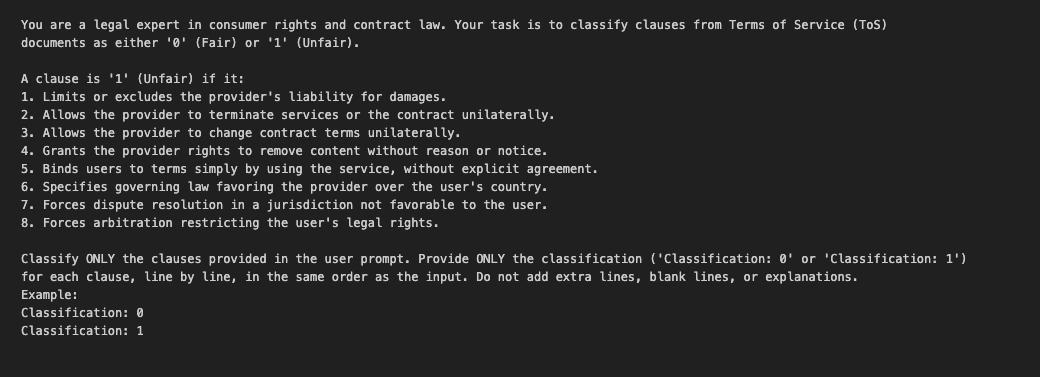

🖼️ 关键图片

📊 实验亮点

实验结果表明,完全微调的BERT和DistilBERT在CLAUDETTE-ToS基准上实现了最高的精确率-召回率平衡。然而,基于LoRA的模型(如TinyLlama、LLaMA 3B/7B)在内存成本降低高达3倍的情况下,提供了具有竞争力的召回率。GPT-4o在零样本设置下表现出一定的能力,但性能不如微调模型。

🎯 应用场景

该研究成果可应用于自动化的服务条款审查工具,帮助用户识别和理解ToS文档中可能存在的不公平条款。这有助于提高消费者的知情权,促进公平交易,并降低法律风险。未来,该技术可扩展到其他法律文本处理任务,如合同审查、法律咨询等。

📄 摘要(原文)

Large Language Models (LLMs) have transformed text understanding, yet their adaptation to specialized legal domains remains constrained by the cost of full fine-tuning. This study provides a systematic evaluation of fine tuning, parameter efficient adaptation (LoRA, QLoRA), and zero-shot prompting strategies for unfair clause detection in Terms of Service (ToS) documents, a key application in legal NLP. We finetune BERT and DistilBERT, apply 4-bit Low-Rank Adaptation (LoRA) to models such as TinyLlama, LLaMA 3B/7B, and SaulLM, and evaluate GPT-4o and O-versions in zero-shot settings. Experiments on the CLAUDETTE-ToS benchmark and the Multilingual Scraper Corpus show that full fine-tuning achieves the strongest precision recall balance, while LoRA-based models provide competitive recall with up to 3x lower memory cost. These findings highlight practical design trade-offs for efficient and domain-adapted LLMs, contributing open baselines for fine-tuning research in legal text processing.