CHOIR: Collaborative Harmonization fOr Inference Robustness

作者: Xiangjue Dong, Cong Wang, Maria Teleki, Millennium Bismay, James Caverlee

分类: cs.CL, cs.AI

发布日期: 2025-10-26

备注: updated version

💡 一句话要点

提出CHOIR,通过协同多个角色化LLM推理信号,提升推理鲁棒性。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 推理鲁棒性 角色扮演 协同解码 反事实推理

📋 核心要点

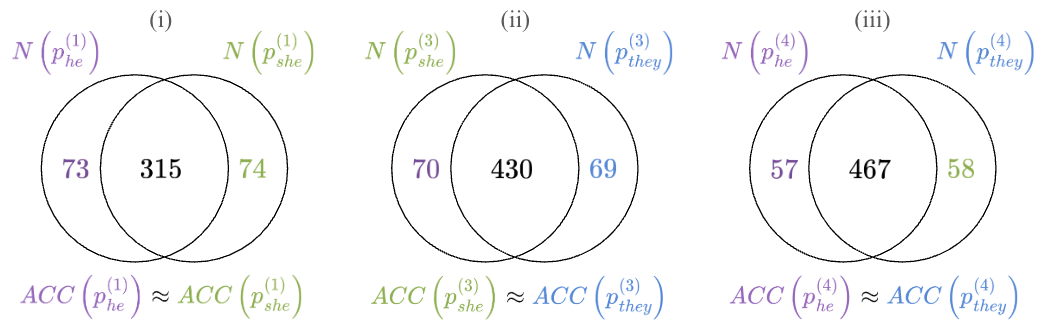

- 现有角色化LLM推理易受角色微小扰动影响,导致推理结果不稳定,产生不同答案。

- CHOIR框架通过协同多个反事实角色推理信号,动态平衡推理路径的一致性和差异性,提升鲁棒性。

- 实验表明,CHOIR在多种任务和模型上均能显著提升性能,最高提升达26.4%,平均提升19.2%,且无需额外训练。

📝 摘要(中文)

本文提出了一种名为CHOIR(Collaborative Harmonization fOr Inference Robustness)的测试时框架,旨在通过协调多个角色条件下的推理信号,从而提高大型语言模型(LLM)的推理鲁棒性。研究发现,即使是角色设定中微小的人口统计学扰动,如代词的简单改变,也可能导致推理轨迹的改变,从而产生不同的正确答案。CHOIR没有将这些变化视为需要缓解的偏差,而是将其视为一种建设性资源。CHOIR在反事实角色之间协调协作解码过程,动态平衡其推理路径中的一致性和差异性。在各种推理基准上的实验表明,CHOIR始终能够提高跨人口统计、模型架构、规模和任务的性能,且无需额外训练。对于单个人口统计群体,性能提升高达26.4%,在五个人口统计群体中的平均提升为19.2%。即使基础角色表现不佳,CHOIR仍然有效。通过将角色变化重新定义为一种建设性信号,CHOIR为更可靠的LLM推理提供了一种可扩展且通用的方法。

🔬 方法详解

问题定义:现有的大型语言模型在进行角色扮演时,即使角色设定中存在微小的人口统计学差异(例如,代词的变化),也可能导致推理结果的显著变化。这种对角色设定的敏感性使得LLM的推理结果不稳定,难以保证在不同人口统计群体中的公平性和一致性。现有的方法通常将这种变化视为偏差并试图消除,但忽略了其潜在的价值。

核心思路:CHOIR的核心思路是将角色变化视为一种建设性的信号,而不是需要消除的偏差。通过协同多个具有不同角色设定的LLM进行推理,并动态地平衡它们推理路径中的一致性和差异性,从而提高推理的鲁棒性。这种方法类似于集成学习的思想,但更侧重于利用角色变化带来的信息增益。

技术框架:CHOIR框架主要包含以下几个阶段:1) 角色生成:为每个输入生成多个反事实角色设定,这些角色在人口统计学特征上存在细微差异。2) 并行推理:使用每个角色化的LLM对输入进行并行推理,得到多个推理路径。3) 协同解码:在解码过程中,动态地平衡不同角色化LLM的推理信号。具体来说,CHOIR使用一种基于注意力机制的融合方法,根据不同角色化LLM的置信度和一致性,动态地调整它们的权重。4) 最终预测:将融合后的推理结果作为最终的预测结果。

关键创新:CHOIR的关键创新在于它将角色变化视为一种有价值的信息来源,并设计了一种协同解码机制来利用这些信息。与传统的偏差消除方法不同,CHOIR不是试图消除角色变化带来的影响,而是利用这些变化来提高推理的鲁棒性。此外,CHOIR的协同解码机制能够动态地平衡不同角色化LLM的推理信号,从而更好地适应不同的输入和任务。

关键设计:CHOIR的关键设计包括:1) 反事实角色生成:如何生成具有代表性的反事实角色设定是一个重要的问题。论文中可能使用了某种启发式方法或基于数据的生成模型来生成这些角色。2) 协同解码机制:基于注意力机制的融合方法是CHOIR的核心,其具体实现细节(例如,注意力权重的计算方式、融合策略等)对最终性能至关重要。3) 损失函数:在训练过程中,可能使用了某种损失函数来鼓励不同角色化LLM之间的协同和一致性。

🖼️ 关键图片

📊 实验亮点

实验结果表明,CHOIR在多个推理基准上均取得了显著的性能提升。例如,在特定人口统计群体上,性能提升高达26.4%,在五个人口统计群体上的平均提升为19.2%。更重要的是,CHOIR的有效性不依赖于基础角色的优劣,即使基础角色表现不佳,CHOIR仍然能够显著提升性能。这些结果表明,CHOIR是一种鲁棒且通用的方法,能够有效提升LLM的推理能力。

🎯 应用场景

CHOIR框架具有广泛的应用前景,可用于提升各种LLM应用(如问答系统、文本摘要、对话生成等)的鲁棒性和公平性。尤其是在涉及敏感信息或需要考虑不同人群的应用场景中,CHOIR能够有效减少因角色设定偏差导致的错误,提高系统的可靠性和可信度。未来,该方法有望推广到其他类型的模型和任务中,成为提升AI系统鲁棒性的通用工具。

📄 摘要(原文)

Persona-assigned Large Language Models (LLMs) can adopt diverse roles, enabling personalized and context-aware reasoning. However, even minor demographic perturbations in personas, such as simple pronoun changes, can alter reasoning trajectories, leading to divergent sets of correct answers. Instead of treating these variations as biases to be mitigated, we explore their potential as a constructive resource to improve reasoning robustness. We propose CHOIR (Collaborative Harmonization fOr Inference Robustness), a test-time framework that harmonizes multiple persona-conditioned reasoning signals into a unified prediction. CHOIR orchestrates a collaborative decoding process among counterfactual personas, dynamically balancing agreement and divergence in their reasoning paths. Experiments on various reasoning benchmarks demonstrate that CHOIR consistently enhances performance across demographics, model architectures, scales, and tasks - without additional training. Improvements reach up to 26.4% for individual demographic groups and 19.2% on average across five demographics. It remains effective even when base personas are suboptimal. By reframing persona variation as a constructive signal, CHOIR provides a scalable and generalizable approach to more reliable LLM reasoning.