From Polyester Girlfriends to Blind Mice: Creating the First Pragmatics Understanding Benchmarks for Slovene

作者: Mojca Brglez, Špela Vintar

分类: cs.CL, cs.AI

发布日期: 2025-10-24

💡 一句话要点

为斯洛文尼亚语提出首个语用理解基准测试集SloPragEval和SloPragMega

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 语用理解 基准测试 斯洛文尼亚语 大型语言模型 文化语境

📋 核心要点

- 现有语言模型在句法和语义理解方面取得了显著进展,但在语用理解方面仍存在不足,尤其是在文化相关的语境中。

- 该论文提出SloPragEval和SloPragMega,这是首个针对斯洛文尼亚语的语用理解基准测试集,旨在评估模型在理解情境意义和文化规范方面的能力。

- 实验结果表明,现有模型在理解细微语言方面有所改进,但在文化特定语境下的非字面意义理解方面仍有挑战,且专有模型优于开源模型。

📝 摘要(中文)

大型语言模型的能力日益增强,在曾经被认为非常困难的基准测试中表现出色。随着模型能力的增长,需要更具挑战性的评估,以超越表面语言能力。语言能力不仅包括句法和语义,还包括语用学,即理解受语境以及语言和文化规范影响的情境意义。为了促进这方面的研究,我们推出了SloPragEval和SloPragMega,这是首个针对斯洛文尼亚语的语用理解基准测试集,总共包含405个多项选择题。我们讨论了翻译的难点,描述了建立人工基线的活动,并报告了LLM的初步评估结果。结果表明,当前的模型在理解细微语言方面有了很大改进,但可能仍然无法推断非字面意义的言语中隐含的说话者含义,尤其是在特定文化背景下。我们还观察到专有模型和开源模型之间存在显著差距。最后,我们认为,针对细微语言理解和目标文化知识的基准测试必须谨慎设计,最好从原生数据构建,并经过人工响应验证。

🔬 方法详解

问题定义:现有的大型语言模型在句法和语义理解方面表现出色,但缺乏对语用学的深入理解,尤其是在特定文化背景下的情境意义推断。现有方法难以准确评估模型在理解非字面意义、隐含含义以及文化规范方面的能力。

核心思路:该论文的核心思路是构建一个高质量的、针对斯洛文尼亚语的语用理解基准测试集,包含多种语用现象,如隐喻、讽刺和文化典故,从而更全面地评估语言模型的语用理解能力。通过人工基线和模型评估,揭示模型在语用理解方面的优势和不足。

技术框架:该研究主要包含以下几个阶段:1) 数据收集和标注:收集包含丰富语用信息的斯洛文尼亚语文本,并进行人工标注,确保标注的准确性和一致性。2) 基准测试集构建:基于标注数据,构建SloPragEval和SloPragMega两个基准测试集,包含多项选择题,涵盖不同的语用现象。3) 模型评估:使用现有的大型语言模型在基准测试集上进行评估,并与人工基线进行比较。4) 结果分析:分析模型在不同语用现象上的表现,找出模型的优势和不足。

关键创新:该论文的关键创新在于:1) 首次为斯洛文尼亚语构建了语用理解基准测试集,填补了该领域的空白。2) 基准测试集的设计考虑了斯洛文尼亚语的文化特性,能够更准确地评估模型在理解文化相关语境下的语用能力。3) 通过人工基线和模型评估,揭示了现有模型在语用理解方面的局限性,为未来的研究提供了方向。

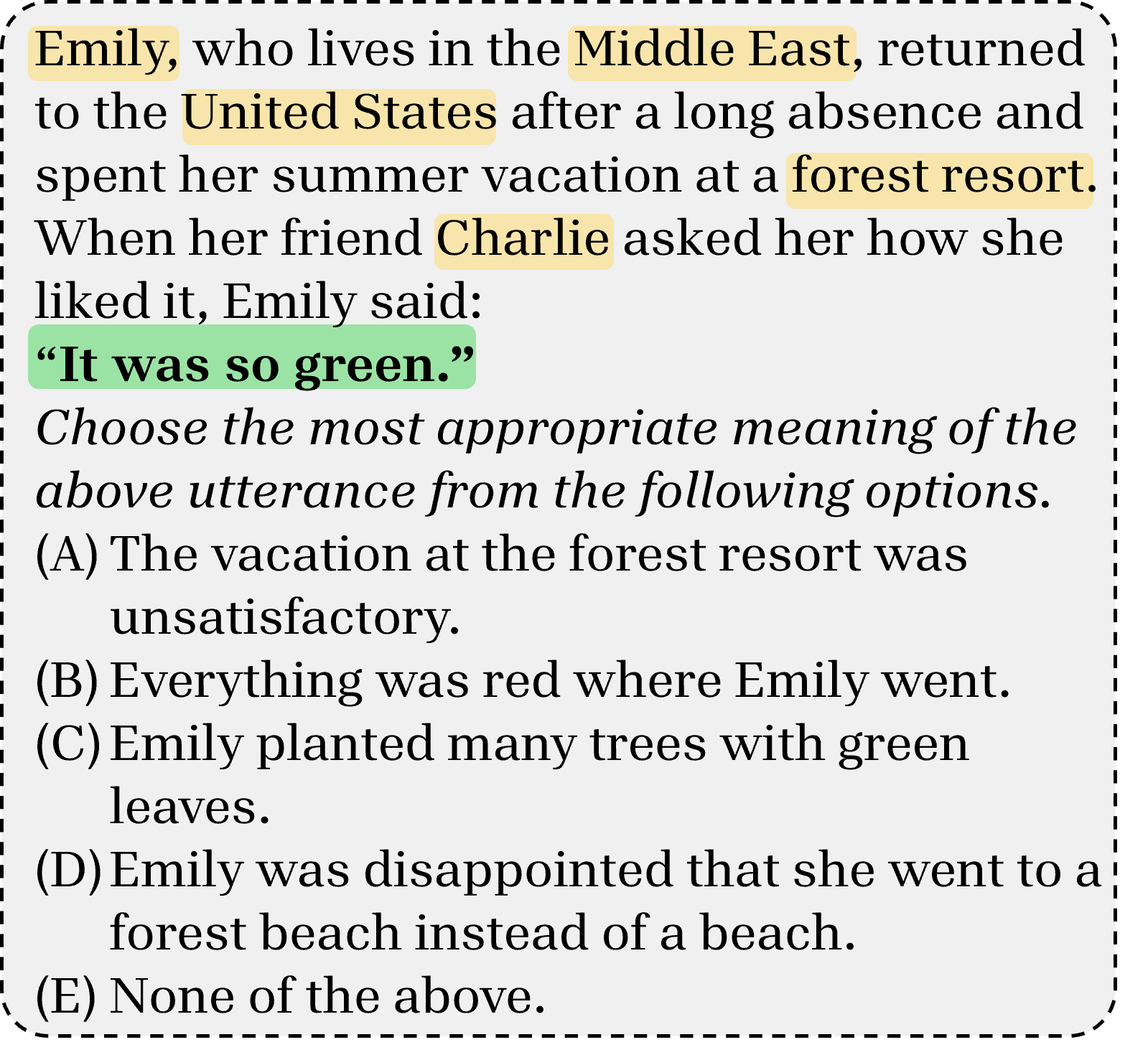

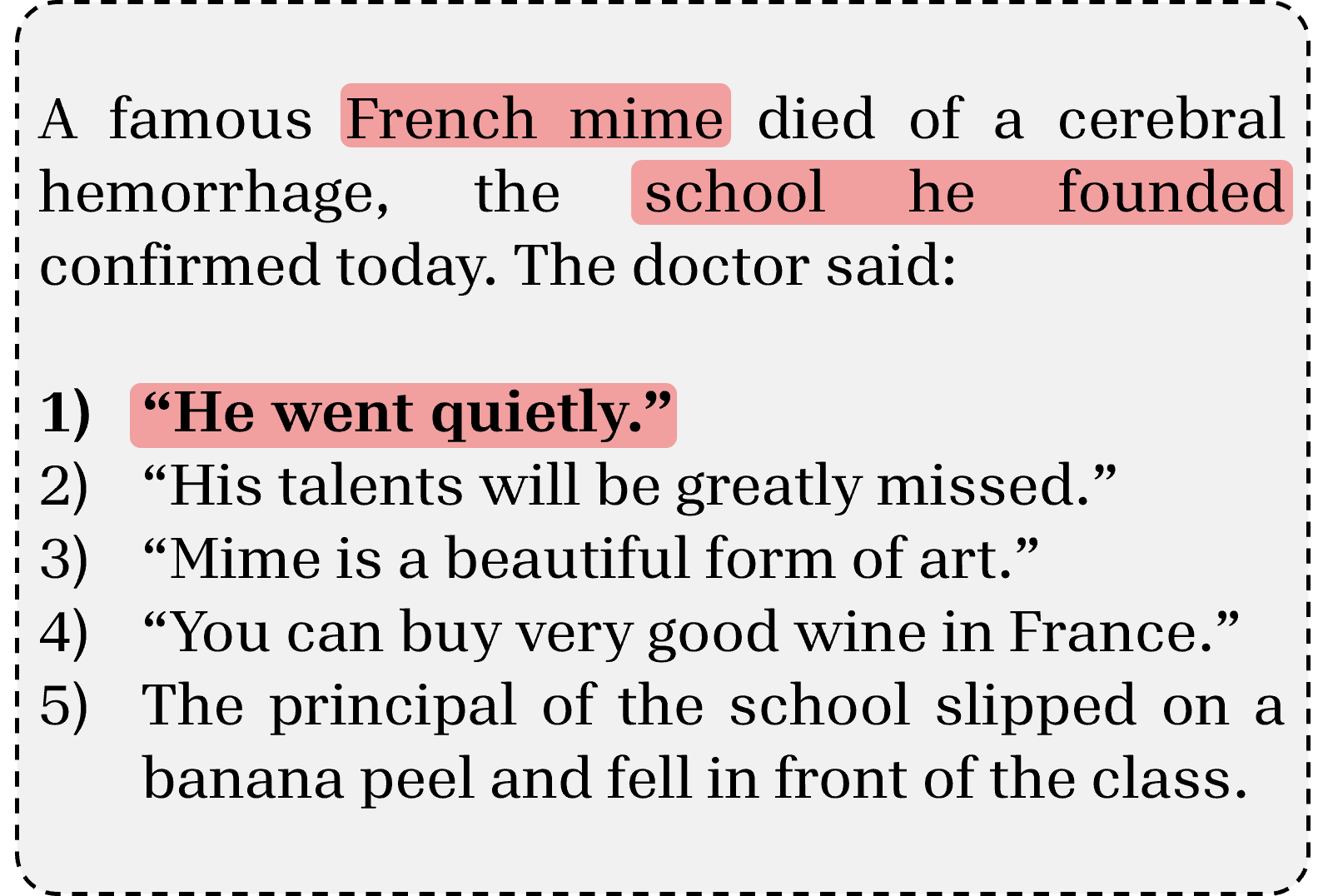

关键设计:SloPragEval和SloPragMega包含405个多项选择题,涵盖多种语用现象,如隐喻、讽刺、言语行为和文化典故。每个问题都包含一个语境描述和多个选项,要求模型选择最符合语境的答案。为了保证数据的质量,所有数据都经过了多轮人工审核和校对。此外,研究人员还建立了一个人工基线,用于评估基准测试集的难度和区分度。

🖼️ 关键图片

📊 实验亮点

实验结果表明,现有大型语言模型在SloPragEval和SloPragMega上的表现与人工基线相比仍有差距,尤其是在文化特定语境下的非字面意义理解方面。专有模型(如GPT-3)的性能优于开源模型,但仍存在改进空间。该研究强调了构建高质量、文化相关的语用理解基准测试集的重要性。

🎯 应用场景

该研究成果可应用于提升自然语言处理系统在斯洛文尼亚语环境下的性能,尤其是在需要理解细微语言和文化背景的场景中,如智能客服、情感分析、机器翻译等。该基准测试集也可用于评估和改进未来语言模型的语用理解能力,促进更智能、更人性化的AI应用。

📄 摘要(原文)

Large language models are demonstrating increasing capabilities, excelling at benchmarks once considered very difficult. As their capabilities grow, there is a need for more challenging evaluations that go beyond surface-level linguistic competence. Namely, language competence involves not only syntax and semantics but also pragmatics, i.e., understanding situational meaning as shaped by context as well as linguistic and cultural norms. To contribute to this line of research, we introduce SloPragEval and SloPragMega, the first pragmatics understanding benchmarks for Slovene that contain altogether 405 multiple-choice questions. We discuss the difficulties of translation, describe the campaign to establish a human baseline, and report pilot evaluations with LLMs. Our results indicate that current models have greatly improved in understanding nuanced language but may still fail to infer implied speaker meaning in non-literal utterances, especially those that are culture-specific. We also observe a significant gap between proprietary and open-source models. Finally, we argue that benchmarks targeting nuanced language understanding and knowledge of the target culture must be designed with care, preferably constructed from native data, and validated with human responses.