Document Understanding, Measurement, and Manipulation Using Category Theory

作者: Jared Claypoole, Yunye Gong, Noson S. Yanofsky, Ajay Divakaran

分类: cs.CL, cs.LG

发布日期: 2025-10-24

💡 一句话要点

利用范畴论进行文档理解、测量和操作,实现文档总结与扩展。

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 文档理解 范畴论 信息论 自监督学习 预训练模型 文档总结 问答对

📋 核心要点

- 现有文档理解方法缺乏对文档深层结构和信息量化能力的有效建模。

- 论文提出基于范畴论的文档表示方法,将文档建模为问答对的范畴,从而提取文档的结构化信息。

- 通过范畴论框架,论文实现了文档信息量的测量、文档总结与扩展,以及预训练模型的自监督改进。

📝 摘要(中文)

本文应用范畴论提取多模态文档结构,进而开发信息论度量、内容总结与扩展,以及大型预训练模型的自监督改进。首先,我们将文档表示为问答对的范畴。其次,我们开发了一种正交化程序,将一个或多个文档中包含的信息划分为非重叠的部分。基于提取的结构,我们开发了测量和枚举文档所含信息的方法。我们还在此基础上开发了新的总结技术,并解决了一个新的问题,即注释,从而扩展原始文档。我们的问答对方法能够对总结技术进行新颖的率失真分析。我们使用大型预训练模型实现我们的技术,并提出了整体数学框架的多模态扩展。最后,我们开发了一种新颖的自监督方法,使用RLVR通过一致性约束(例如可组合性和在某些操作下的闭包,这些约束自然源于我们的范畴论框架)来改进大型预训练模型。

🔬 方法详解

问题定义:现有文档理解方法在捕捉文档深层结构和量化信息方面存在不足,难以进行有效的文档总结、扩展和模型改进。传统方法通常依赖于浅层的文本特征或简单的统计信息,无法充分利用文档中蕴含的语义关系和逻辑结构。

核心思路:论文的核心思路是将文档表示为一个问答对的范畴,利用范畴论的数学工具来描述文档的结构和关系。通过这种方式,可以将文档的信息分解为非重叠的部分,并进行量化测量。同时,范畴论框架提供了一致性约束,可以用于自监督学习,从而改进预训练模型。

技术框架:整体框架包括以下几个主要阶段:1) 文档表示:将文档转换为问答对的集合,并构建相应的范畴结构。2) 信息分解:使用正交化程序将文档信息分解为非重叠的部分。3) 信息测量:开发信息论度量来量化文档的信息量。4) 文档操作:实现文档总结和扩展等操作。5) 模型改进:使用自监督学习方法,利用范畴论框架提供的一致性约束来改进预训练模型。

关键创新:最重要的技术创新点在于将范畴论引入文档理解领域,并将其应用于文档结构建模、信息量化和模型改进。与现有方法相比,该方法能够更有效地捕捉文档的深层结构和语义关系,并提供了一种新的自监督学习框架。

关键设计:论文的关键设计包括:1) 问答对的构建方法,需要选择合适的问答对生成策略,以保证能够充分覆盖文档的信息。2) 正交化程序的具体实现,需要设计合适的算法来将文档信息分解为非重叠的部分。3) 信息论度量的选择,需要选择能够有效反映文档信息量的度量指标。4) 自监督学习框架的设计,需要选择合适的损失函数和一致性约束,以保证模型能够有效地学习文档的结构和关系。

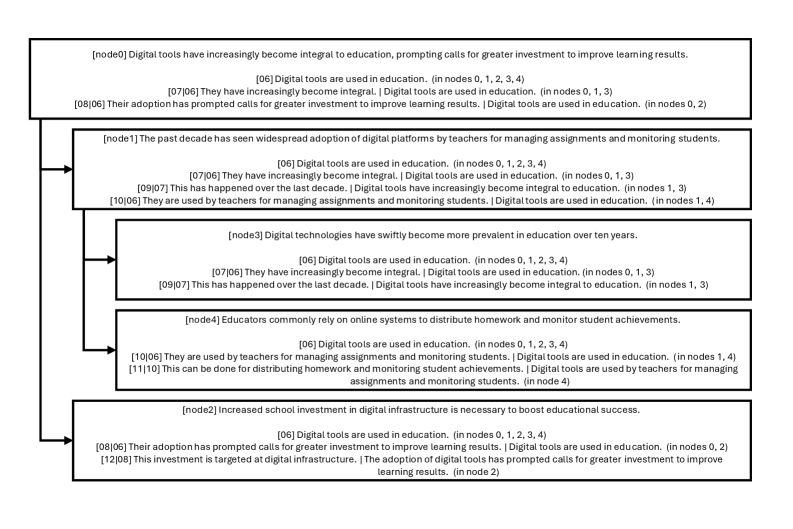

🖼️ 关键图片

📊 实验亮点

论文提出了基于范畴论的文档理解框架,并成功应用于文档总结和预训练模型改进。通过实验验证,该方法在文档信息量化和自监督学习方面取得了显著效果,为文档理解领域的研究提供了新的思路。

🎯 应用场景

该研究成果可应用于智能文档处理、自动摘要生成、机器翻译、知识图谱构建等领域。通过对文档深层结构的理解和信息量的量化,可以提升相关任务的性能和效率。此外,该方法还可以用于改进预训练模型,提高其在各种自然语言处理任务中的表现。

📄 摘要(原文)

We apply category theory to extract multimodal document structure which leads us to develop information theoretic measures, content summarization and extension, and self-supervised improvement of large pretrained models. We first develop a mathematical representation of a document as a category of question-answer pairs. Second, we develop an orthogonalization procedure to divide the information contained in one or more documents into non-overlapping pieces. The structures extracted in the first and second steps lead us to develop methods to measure and enumerate the information contained in a document. We also build on those steps to develop new summarization techniques, as well as to develop a solution to a new problem viz. exegesis resulting in an extension of the original document. Our question-answer pair methodology enables a novel rate distortion analysis of summarization techniques. We implement our techniques using large pretrained models, and we propose a multimodal extension of our overall mathematical framework. Finally, we develop a novel self-supervised method using RLVR to improve large pretrained models using consistency constraints such as composability and closure under certain operations that stem naturally from our category theoretic framework.