How Do LLMs Use Their Depth?

作者: Akshat Gupta, Jay Yeung, Gopala Anumanchipalli, Anna Ivanova

分类: cs.CL, cs.AI

发布日期: 2025-10-21

💡 一句话要点

提出“猜测-精炼”框架,揭示LLM逐层预测的动态过程与深度利用方式

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 深度利用 逐层预测 猜测-精炼框架 计算效率 Transformer模型 中间表示 动态分析

📋 核心要点

- 现有研究缺乏对LLM逐层预测动态的细粒度理解,难以有效优化模型计算效率。

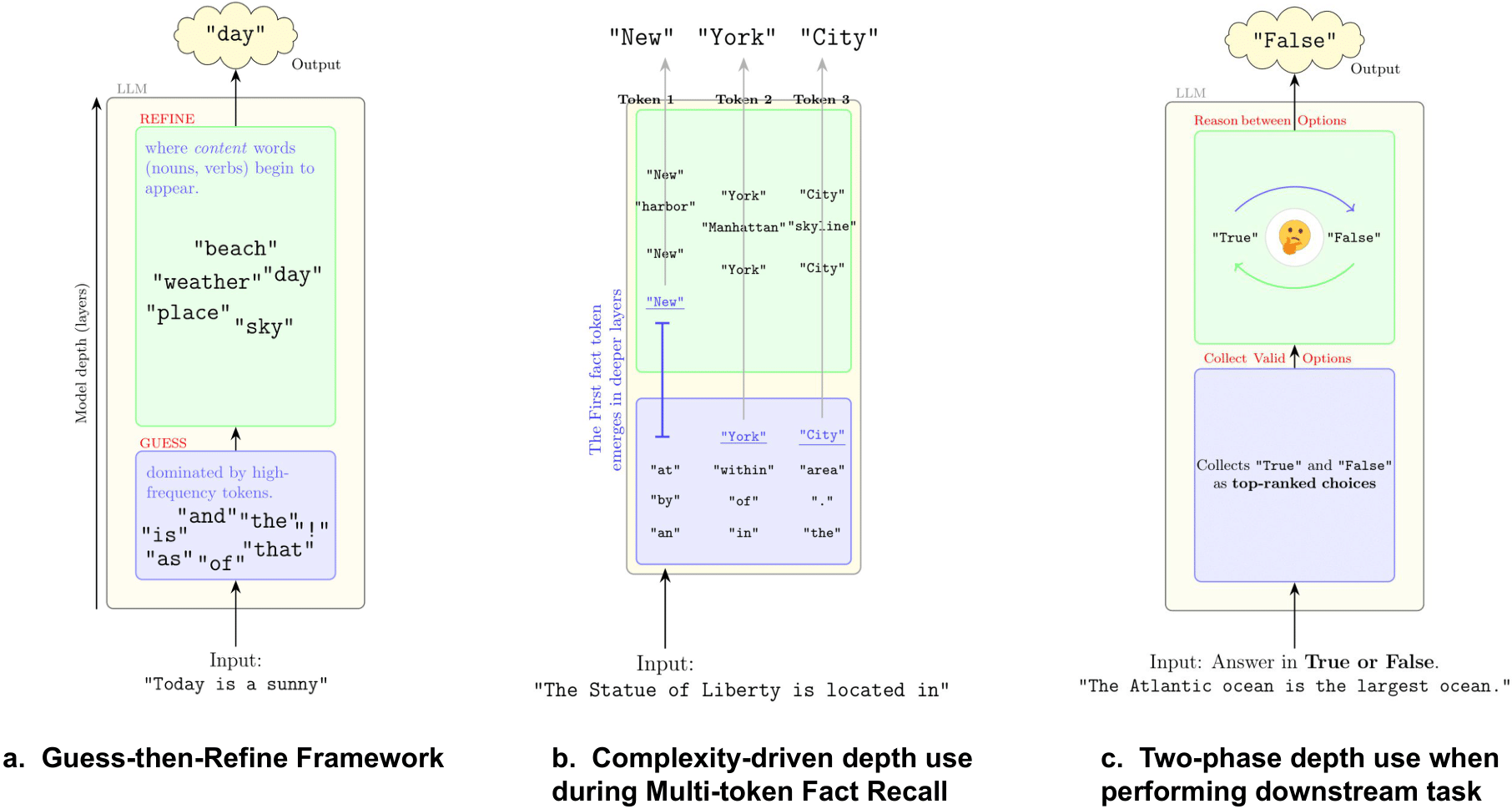

- 论文提出“猜测-精炼”框架,认为LLM早期层生成高频token猜测,后续层根据上下文进行精炼。

- 通过词性分析、事实回忆和多项选择任务,验证了不同任务对LLM深度利用的差异性。

📝 摘要(中文)

越来越多的证据表明,大型语言模型并非均匀地利用其深度。本文旨在深入理解LLM逐层预测的动态过程。通过追踪多个开源模型在推理过程中的中间表示,揭示了一种结构化且细致的深度利用方式。具体而言,论文提出了一个“猜测-精炼”框架,解释了LLM内部如何组织计算以进行预测。研究表明,LLM早期层级中排名靠前的预测主要由高频token组成,这些token充当模型在缺乏适当上下文信息时提出的统计猜测。随着上下文信息在模型深层的发展,这些初始猜测被细化为上下文相关的token。即使是早期层级的高频token预测,也有超过70%的概率被细化,表明正确的token预测并非“一蹴而就”。此外,论文还通过三个案例研究,考察了基于频率的预测之外的层深度动态使用情况:词性分析表明功能词平均而言最早被正确预测;事实回忆任务分析表明,在多token答案中,第一个token需要更多的计算深度;多项选择任务分析表明,模型在前一半层中识别出响应的格式,但直到最后才最终确定其响应。总之,这些结果详细展示了LLM中深度的使用情况,揭示了成功预测背后的逐层计算,并为未来改进基于Transformer模型的计算效率提供了见解。

🔬 方法详解

问题定义:现有的大型语言模型(LLM)虽然在各种任务中表现出色,但对其内部如何利用模型深度进行预测的理解仍然不足。现有的研究表明,LLM并非均匀地使用其深度,但缺乏对每一层预测动态的细粒度分析。这阻碍了我们对LLM工作机制的深入理解,也限制了我们优化LLM计算效率的能力。

核心思路:论文的核心思路是追踪LLM在推理过程中的中间表示,观察每一层输出的token预测,并分析这些预测的变化。通过分析token的频率、词性以及在不同任务中的预测情况,揭示LLM如何逐步构建上下文信息,并最终做出准确的预测。核心在于将LLM的预测过程分解为“猜测”和“精炼”两个阶段,早期层进行初步猜测,后续层根据上下文信息进行修正。

技术框架:论文的技术框架主要包括以下几个步骤:1. 选择多个开源LLM模型进行实验。2. 在推理过程中,记录每一层的token预测结果。3. 分析token的频率、词性等特征。4. 设计三个案例研究:词性分析、事实回忆和多项选择任务,以考察不同任务对LLM深度利用的影响。5. 基于实验结果,提出“猜测-精炼”框架,并解释LLM的逐层预测动态。

关键创新:论文最重要的技术创新点在于提出了“猜测-精炼”框架,该框架提供了一种新的视角来理解LLM的内部工作机制。与以往的研究不同,该框架强调了LLM预测过程的动态性,认为LLM并非一次性地做出预测,而是通过不断地修正和完善来提高预测的准确性。此外,通过对不同任务的分析,揭示了LLM在不同任务中对深度的不同利用方式。

关键设计:论文的关键设计包括:1. 选择了多个具有代表性的开源LLM模型,以保证实验结果的泛化性。2. 设计了三个具有挑战性的案例研究,以考察LLM在不同任务中的表现。3. 使用了多种分析方法,包括token频率分析、词性分析等,以全面地了解LLM的预测动态。没有特别说明损失函数和网络结构等细节,推测使用了模型自带的损失函数和结构。

🖼️ 关键图片

📊 实验亮点

实验结果表明,LLM早期层级倾向于预测高频token,这些token在后续层级中会被不断精炼。词性分析显示,功能词通常最早被正确预测。事实回忆任务表明,答案的第一个token需要更多的计算深度。多项选择任务中,模型在前一半层确定响应格式,后一半层确定具体内容。早期层的高频token预测有超过70%的概率被后续层修正。

🎯 应用场景

该研究成果可应用于LLM的优化和改进,例如,可以根据不同任务的需求,动态地调整LLM的深度,以提高计算效率。此外,该研究还可以帮助我们更好地理解LLM的工作机制,从而为开发更强大的LLM提供理论指导。潜在的应用领域包括自然语言处理、机器翻译、智能客服等。

📄 摘要(原文)

Growing evidence suggests that large language models do not use their depth uniformly, yet we still lack a fine-grained understanding of their layer-wise prediction dynamics. In this paper, we trace the intermediate representations of several open-weight models during inference and reveal a structured and nuanced use of depth. Specifically, we propose a "Guess-then-Refine" framework that explains how LLMs internally structure their computations to make predictions. We first show that the top-ranked predictions in early LLM layers are composed primarily of high-frequency tokens, which act as statistical guesses proposed by the model early on due to the lack of appropriate contextual information. As contextual information develops deeper into the model, these initial guesses get refined into contextually appropriate tokens. Even high-frequency token predictions from early layers get refined >70% of the time, indicating that correct token prediction is not "one-and-done". We then go beyond frequency-based prediction to examine the dynamic usage of layer depth across three case studies. (i) Part-of-speech analysis shows that function words are, on average, the earliest to be predicted correctly. (ii) Fact recall task analysis shows that, in a multi-token answer, the first token requires more computational depth than the rest. (iii) Multiple-choice task analysis shows that the model identifies the format of the response within the first half of the layers, but finalizes its response only toward the end. Together, our results provide a detailed view of depth usage in LLMs, shedding light on the layer-by-layer computations that underlie successful predictions and providing insights for future works to improve computational efficiency in transformer-based models.