Grounding or Guessing? Visual Signals for Detecting Hallucinations in Sign Language Translation

作者: Yasser Hamidullah, Koel Dutta Chowdhury, Yusser Al Ghussin, Shakib Yazdani, Cennet Oguz, Josef van Genabith, Cristina España-Bonet

分类: cs.CL

发布日期: 2025-10-21 (更新: 2026-01-28)

备注: Accepted at ICLR2026

💡 一句话要点

提出基于视觉信号的可靠性度量,用于检测手语翻译中的幻觉问题。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 手语翻译 幻觉检测 视觉语言模型 可靠性度量 多模态学习

📋 核心要点

- 手语翻译模型易产生幻觉,生成无视觉证据支持的文本,尤其是在无词汇模型中,直接映射易出错。

- 提出token级别的可靠性度量,结合特征敏感性和反事实信号,量化解码器对视觉信息的依赖程度。

- 实验表明,该度量能有效预测幻觉率,区分有根据和猜测的token,并可与其他文本信号结合提升风险估计。

📝 摘要(中文)

幻觉问题,即模型生成流畅但缺乏视觉证据支持的文本,是视觉-语言模型中的一个主要缺陷,在手语翻译(SLT)中尤为关键。在SLT中,意义依赖于视频的精确对应。无词汇模型尤其容易出现幻觉,因为它们将连续的手语者动作直接映射到自然语言,而没有中间词汇监督作为对齐。论文认为,幻觉的产生是由于模型过度依赖语言先验而非视觉输入。为了捕捉这一点,论文提出了一种token级别的可靠性度量,量化解码器对视觉信息的使用程度。该方法结合了基于特征的敏感性(衡量视频被mask时的内部变化)和反事实信号(捕捉干净和改变后的视频输入之间的概率差异)。这些信号被聚合为句子级别的可靠性得分,提供了一种紧凑且可解释的视觉对应度量。在两个SLT基准(PHOENIX-2014T和CSL-Daily)上,使用基于词汇和无词汇的模型评估了该方法。结果表明,可靠性能够预测幻觉率,泛化到不同的数据集和架构,并在视觉退化的情况下降低。此外,可靠性能够区分有根据的和猜测的token,从而在没有参考的情况下进行风险估计;当与基于文本的信号(置信度、困惑度或熵)结合使用时,可以进一步提高幻觉风险估计。定性分析突出了无词汇模型更容易出现幻觉的原因。总而言之,这些发现将可靠性确立为一种实用且可重用的工具,用于诊断SLT中的幻觉,并为多模态生成中更强大的幻觉检测奠定了基础。

🔬 方法详解

问题定义:手语翻译(SLT)模型,特别是gloss-free模型,容易产生幻觉,即生成流畅但缺乏视觉证据支持的文本。现有方法依赖语言先验,忽略了视觉输入的重要性,导致翻译结果与实际手语动作不符。现有方法缺乏有效的度量来评估模型对视觉信息的依赖程度,难以诊断和缓解幻觉问题。

核心思路:论文的核心思路是提出一种token级别的可靠性度量,用于量化解码器在生成每个token时对视觉信息的依赖程度。通过分析视频输入对模型内部状态和输出概率的影响,判断模型是否真正“看到”了手语动作,还是仅仅依赖语言自身的规律进行猜测。这种方法旨在区分基于视觉证据的翻译和基于语言先验的猜测,从而检测和缓解幻觉问题。

技术框架:该方法主要包含以下几个模块:1) 特征敏感性分析:通过mask掉部分视频帧,观察模型内部特征的变化,衡量模型对特定视觉特征的敏感程度。2) 反事实信号提取:对比原始视频和经过扰动的视频(例如添加噪声、模糊等)的输出概率差异,捕捉模型对视觉输入的鲁棒性。3) 可靠性得分计算:将特征敏感性和反事实信号进行聚合,得到token级别的可靠性得分,反映模型在生成该token时对视觉信息的依赖程度。4) 句子级别聚合:将token级别的可靠性得分聚合为句子级别的可靠性得分,用于评估整个翻译句子的可靠性。

关键创新:该方法最重要的技术创新点在于提出了一种基于视觉信号的可靠性度量,能够直接量化解码器对视觉信息的依赖程度。与现有方法相比,该方法不依赖于额外的监督信息(例如词汇对齐),可以直接应用于gloss-free模型。此外,该方法结合了特征敏感性和反事实信号,能够更全面地评估模型对视觉输入的理解能力。

关键设计:在特征敏感性分析中,采用了基于梯度的敏感性分析方法,计算每个视频帧对模型输出的影响。在反事实信号提取中,采用了多种扰动策略,例如添加高斯噪声、进行高斯模糊等,以评估模型对不同类型视觉噪声的鲁棒性。在可靠性得分计算中,采用了加权平均的方式,将特征敏感性和反事实信号进行聚合,权重参数可以通过实验进行调整。损失函数方面,没有引入新的损失函数,而是将可靠性得分作为一种诊断工具,用于分析现有模型的幻觉问题。

🖼️ 关键图片

📊 实验亮点

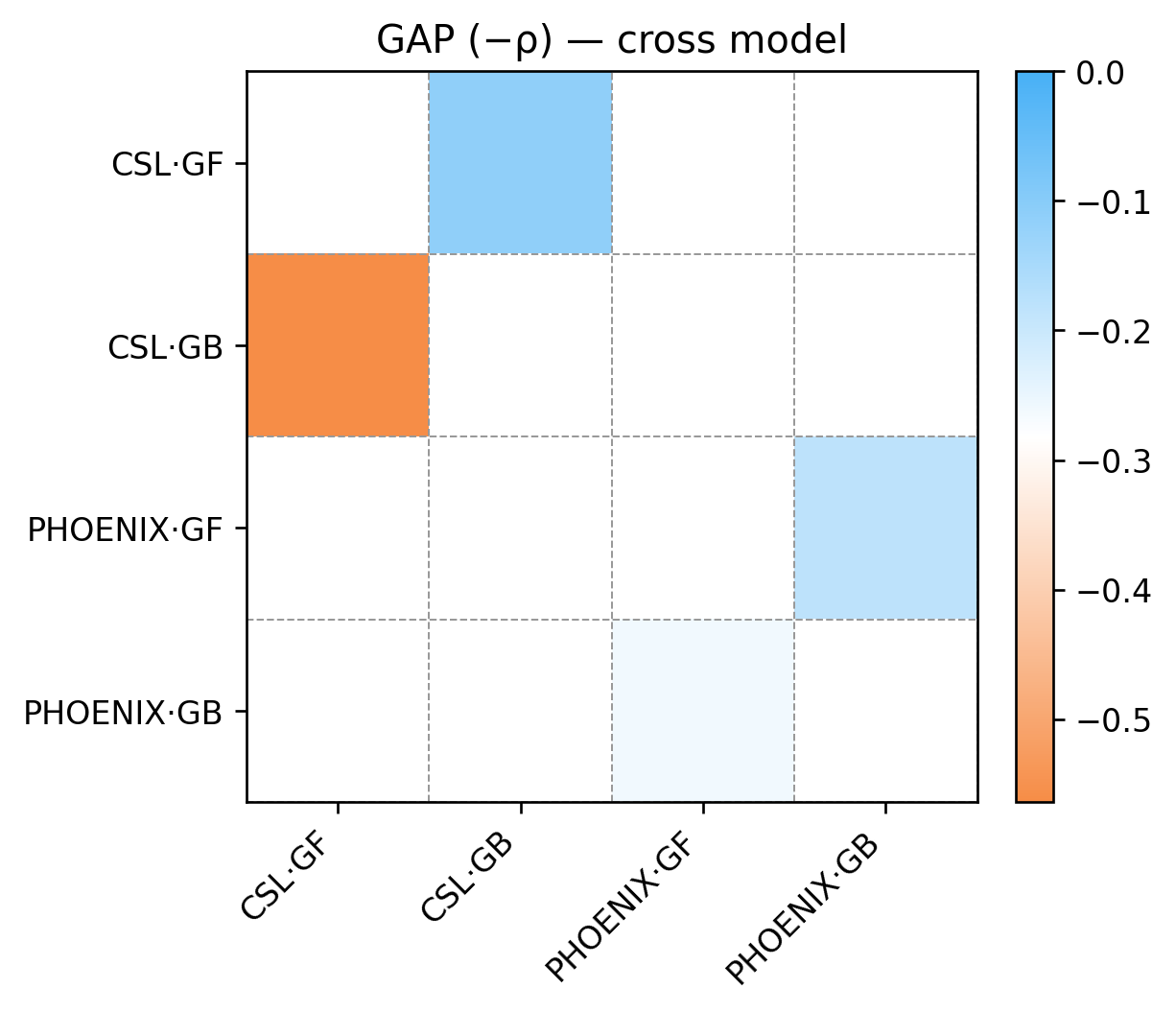

实验结果表明,提出的可靠性度量能够有效预测手语翻译中的幻觉率,并且可以泛化到不同的数据集和模型架构上。在PHOENIX-2014T和CSL-Daily数据集上,可靠性得分与幻觉率呈现显著负相关。此外,该方法能够区分有根据的和猜测的token,从而在没有参考翻译的情况下进行风险估计。与仅使用文本信息的基线方法相比,结合可靠性得分可以显著提高幻觉风险估计的准确性。

🎯 应用场景

该研究成果可应用于提升手语翻译系统的可靠性和准确性,尤其是在医疗、教育等对信息准确性要求高的领域。通过检测和纠正幻觉,可以提高聋哑人与健听人之间的沟通效率,促进社会融合。该方法也可推广到其他视觉-语言生成任务中,例如视频字幕生成、图像描述等。

📄 摘要(原文)

Hallucination, where models generate fluent text unsupported by visual evidence, remains a major flaw in vision-language models and is particularly critical in sign language translation (SLT). In SLT, meaning depends on precise grounding in video, and gloss-free models are especially vulnerable because they map continuous signer movements directly into natural language without intermediate gloss supervision that serves as alignment. We argue that hallucinations arise when models rely on language priors rather than visual input. To capture this, we propose a token-level reliability measure that quantifies how much the decoder uses visual information. Our method combines feature-based sensitivity, which measures internal changes when video is masked, with counterfactual signals, which capture probability differences between clean and altered video inputs. These signals are aggregated into a sentence-level reliability score, providing a compact and interpretable measure of visual grounding. We evaluate the proposed measure on two SLT benchmarks (PHOENIX-2014T and CSL-Daily) with both gloss-based and gloss-free models. Our results show that reliability predicts hallucination rates, generalizes across datasets and architectures, and decreases under visual degradations. Beyond these quantitative trends, we also find that reliability distinguishes grounded tokens from guessed ones, allowing risk estimation without references; when combined with text-based signals (confidence, perplexity, or entropy), it further improves hallucination risk estimation. Qualitative analysis highlights why gloss-free models are more susceptible to hallucinations. Taken together, our findings establish reliability as a practical and reusable tool for diagnosing hallucinations in SLT, and lay the groundwork for more robust hallucination detection in multimodal generation.