Chain-of-Conceptual-Thought Elicits Daily Conversation in Large Language Models

作者: Qingqing Gu, Dan Wang, Yue Zhao, Xiaoyu Wang, Zhonglin Jiang, Yong Chen, Hongyan Li, Luo Ji

分类: cs.CL

发布日期: 2025-10-21 (更新: 2025-11-17)

备注: PRICAI 2025

💡 一句话要点

提出概念链式思考(CoCT)提示方法,提升大语言模型在日常对话中的表现

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 概念链式思考 大语言模型 日常对话 情感支持 提示学习

📋 核心要点

- 现有CoT方法在开放域对话任务中表现受限,缺乏明确推理步骤和逻辑转换。

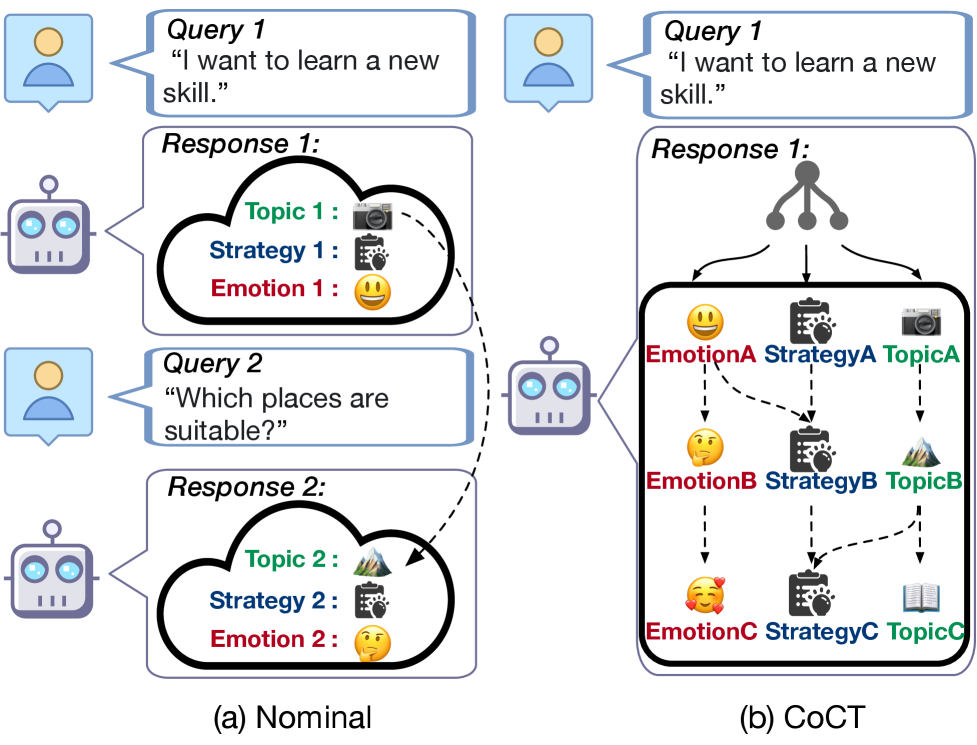

- 提出CoCT方法,引导LLM先生成概念标签,再根据概念生成详细内容,实现分层思考。

- 实验表明,CoCT在日常对话和情感支持对话中优于多种基线方法,提升了对话质量。

📝 摘要(中文)

链式思考(CoT)被广泛应用于增强大语言模型在数学、编程和推理任务中的能力。然而,当没有明确定义的推理步骤或逻辑转换时,其在开放领域任务中的性能受到限制。为了缓解这些挑战,我们提出了一种新的基于提示的范式,称为概念链式思考(CoCT),它建议大语言模型首先生成概念标签,然后按照概念完成详细内容。为了鼓励这种分层思维方式,我们使用情感、策略和主题来实现概念。我们在日常和情感支持对话中对该范式进行了实验,涵盖了具有领域内和领域外概念设置的任务。自动、人工和基于大语言模型的评估表明,CoCT优于几种基于提示的基线方法,如自我完善、ECoT、SoT和RAG,这表明CoCT为更广泛任务的大语言模型提示范式提供了一种潜在的解决方案。

🔬 方法详解

问题定义:论文旨在解决大语言模型在开放域日常对话中,由于缺乏明确的推理步骤和逻辑转换,导致链式思考(CoT)方法效果不佳的问题。现有方法难以有效地引导模型生成连贯、有意义的对话内容,尤其是在需要情感支持等复杂场景下。

核心思路:论文的核心思路是引入“概念链式思考”(CoCT),将对话生成过程分解为两个阶段:首先,让模型生成与对话相关的概念标签(例如情感、策略、主题等);然后,基于这些概念标签,生成详细的对话内容。这种分层思考的方式旨在模拟人类的思维过程,从而提高对话的质量和连贯性。

技术框架:CoCT框架主要包含两个阶段:概念生成阶段和内容生成阶段。在概念生成阶段,模型接收到用户输入,并生成一系列相关的概念标签。这些概念标签可以包括情感、策略、主题等。在内容生成阶段,模型将用户输入和生成的概念标签作为输入,生成详细的对话内容。整个过程通过特定的提示语(prompt)引导模型进行。

关键创新:CoCT的关键创新在于引入了概念标签作为中间层,将对话生成过程分解为概念化和内容生成两个步骤。这与传统的CoT方法直接生成对话内容不同,CoCT通过概念标签显式地引导模型的思考过程,使其更具结构性和可控性。此外,CoCT还鼓励模型在概念生成阶段考虑情感、策略和主题等因素,从而提高对话的丰富性和多样性。

关键设计:CoCT的关键设计在于提示语的设计,提示语需要引导模型首先生成概念标签,然后基于这些标签生成详细内容。论文中使用了特定的提示语模板,例如“首先思考对话中涉及的情感、策略和主题,然后生成对话内容”。此外,论文还探索了不同的概念标签表示方式,例如使用情感词汇、策略描述和主题关键词等。具体的参数设置和损失函数信息未知。

🖼️ 关键图片

📊 实验亮点

实验结果表明,CoCT在日常对话和情感支持对话任务中,优于多种基线方法,包括Self-Refine, ECoT, SoT和RAG。自动评估、人工评估和基于大语言模型的评估均显示,CoCT能够生成更连贯、更具情感表达能力的对话内容。具体的性能提升数据未知。

🎯 应用场景

CoCT方法可应用于智能客服、聊天机器人、情感支持系统等领域,提升对话系统的自然度和情感表达能力。该方法通过引导模型进行概念化思考,有望提高对话生成的质量和可控性,从而在人机交互领域发挥重要作用。未来,CoCT还可扩展到其他开放域任务,如故事生成、创意写作等。

📄 摘要(原文)

Chain-of-Thought (CoT) is widely applied to enhance the LLM capability in math, coding and reasoning tasks. However, its performance is limited for open-domain tasks, when there are no clearly defined reasoning steps or logical transitions. To mitigate such challenges, we propose a new prompt-based paradigm called Chain of Conceptual Thoughts (CoCT), which suggests the LLM first to produce the tag of concepts, then complete the detailed content following the concept. To encourage this hierarchical way of thinking, we implement the concepts with emotions, strategies and topics. We experiment with this paradigm in daily and emotional support conversations, covering tasks with both in-domain and out-of-domain concept settings. Automatic, human, and LLM-based evaluations reveal that CoCT surpasses several prompt-based baselines such as self-refine, ECoT, SoT and RAG, suggesting a potential solution of LLM prompting paradigm for a wider scope of tasks.