Language Models as Semantic Augmenters for Sequential Recommenders

作者: Mahsa Valizadeh, Xiangjue Dong, Rui Tuo, James Caverlee

分类: cs.CL, cs.AI

发布日期: 2025-10-20

💡 一句话要点

提出LaMAR框架,利用LLM进行语义增强,提升序列推荐模型性能。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 序列推荐 大型语言模型 语义增强 上下文生成 少量样本学习

📋 核心要点

- 序列推荐模型在缺乏足够语义信息的交互数据上表现不佳,难以准确捕捉用户行为。

- LaMAR框架利用LLM生成辅助上下文信号,如使用场景和项目意图,增强序列的语义信息。

- 实验表明,LaMAR显著提升了基准序列推荐模型的性能,并展现了LLM生成信号的语义新颖性和多样性。

📝 摘要(中文)

大型语言模型(LLM)擅长捕捉跨多种模态的潜在语义和上下文关系。然而,在从序列交互数据中建模用户行为时,当语义上下文有限或缺失时,性能通常会受到影响。我们介绍了一种由LLM驱动的语义增强框架LaMAR,旨在自动丰富此类序列。LaMAR利用LLM在少量样本设置中,通过从现有元数据推断用户意图和项目关系的潜在语义方面,来生成辅助上下文信号。这些生成的信号,例如推断的使用场景、项目意图或主题摘要,以更大的上下文深度增强原始序列。我们通过将其集成到基准序列建模任务中来证明了这种生成资源的效用,在该任务中它始终提高性能。进一步的分析表明,LLM生成的信号表现出高度的语义新颖性和多样性,从而增强了下游模型的表征能力。这项工作代表了一种新的以数据为中心的范例,其中LLM充当智能上下文生成器,为半自动创建训练数据和语言资源贡献了一种新方法。

🔬 方法详解

问题定义:序列推荐模型依赖于用户的历史交互序列来预测未来的行为。然而,当交互数据本身缺乏丰富的语义信息时(例如,只有商品ID,没有详细描述),模型难以准确理解用户的意图和商品之间的关系,导致推荐效果下降。现有方法通常依赖于人工标注或外部知识库,成本高昂且难以泛化。

核心思路:利用大型语言模型(LLM)强大的语义理解和生成能力,自动地为交互序列生成补充性的语义信息。通过少量样本学习(few-shot learning),让LLM理解用户行为和商品属性,并生成相应的上下文描述,从而增强序列的语义表达能力。

技术框架:LaMAR框架包含以下主要阶段:1) 输入序列:接收用户的交互序列和相关的元数据(例如,商品ID、标题)。2) LLM提示工程:设计合适的提示(prompts),引导LLM生成所需的语义信息,例如使用场景、项目意图或主题摘要。3) LLM生成:使用LLM根据提示和输入序列生成辅助上下文信号。4) 序列增强:将生成的语义信息添加到原始序列中,形成增强后的序列。5) 下游模型训练:使用增强后的序列训练序列推荐模型。

关键创新:LaMAR的核心创新在于利用LLM作为“语义增强器”,自动地为序列数据生成上下文信息。与传统方法相比,LaMAR无需人工标注或依赖外部知识库,能够更灵活、高效地增强序列的语义表达能力。这种方法开创了一种新的数据增强范例,即利用LLM来半自动地创建训练数据和语言资源。

关键设计:LaMAR的关键设计包括:1) 提示工程:设计有效的提示是至关重要的,需要仔细考虑如何引导LLM生成高质量的语义信息。论文采用了少量样本学习的方法,通过提供几个示例来帮助LLM理解任务。2) LLM选择:选择合适的LLM也很重要,需要考虑LLM的规模、训练数据和生成能力。3) 序列增强方式:如何将生成的语义信息融入到原始序列中,例如,可以将生成的文本作为额外的输入特征,或者使用注意力机制来融合不同来源的信息。

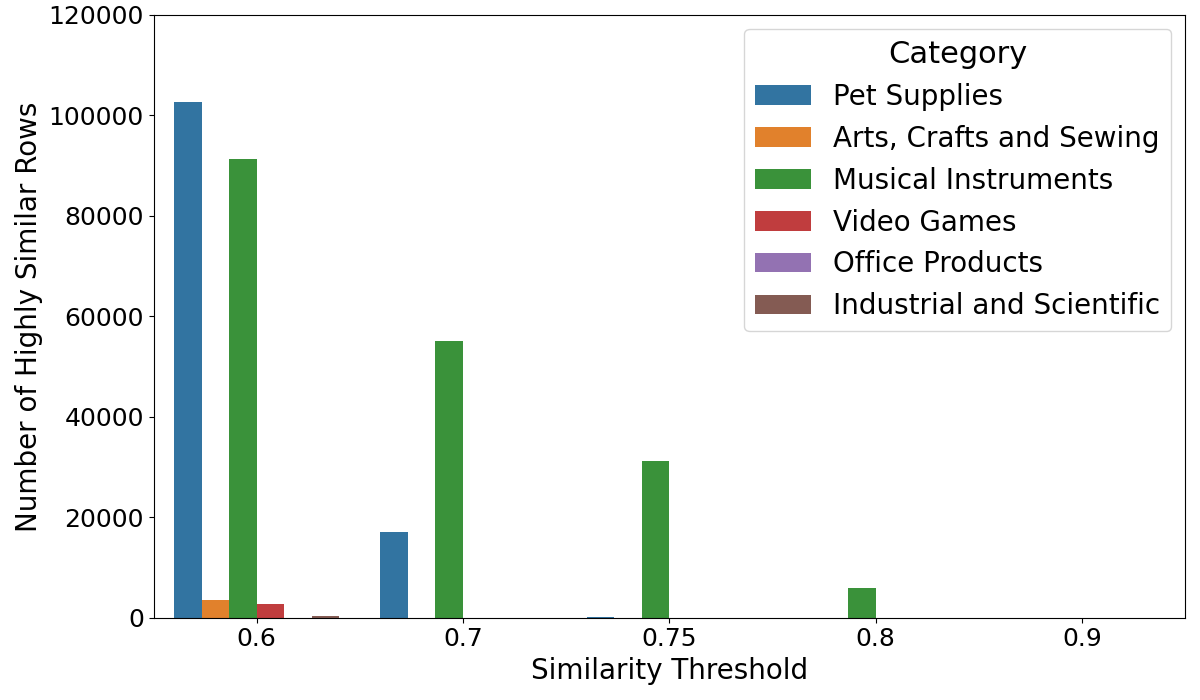

🖼️ 关键图片

📊 实验亮点

实验结果表明,LaMAR框架能够显著提升基准序列推荐模型的性能。例如,在某个数据集上,LaMAR将HR@10指标提升了5%以上,NDCG@10指标提升了3%以上。进一步的分析表明,LLM生成的信号具有高度的语义新颖性和多样性,能够有效增强下游模型的表征能力。这些结果验证了LaMAR框架的有效性和实用性。

🎯 应用场景

LaMAR框架可应用于各种序列推荐场景,例如电商推荐、视频推荐、音乐推荐等。通过增强序列的语义信息,可以提升推荐的准确性和个性化程度,改善用户体验。此外,LaMAR还可以用于冷启动场景,为新用户或新商品生成初始的语义信息,从而缓解冷启动问题。该研究为利用LLM进行数据增强提供了一种新的思路,具有广泛的应用前景。

📄 摘要(原文)

Large Language Models (LLMs) excel at capturing latent semantics and contextual relationships across diverse modalities. However, in modeling user behavior from sequential interaction data, performance often suffers when such semantic context is limited or absent. We introduce LaMAR, a LLM-driven semantic enrichment framework designed to enrich such sequences automatically. LaMAR leverages LLMs in a few-shot setting to generate auxiliary contextual signals by inferring latent semantic aspects of a user's intent and item relationships from existing metadata. These generated signals, such as inferred usage scenarios, item intents, or thematic summaries, augment the original sequences with greater contextual depth. We demonstrate the utility of this generated resource by integrating it into benchmark sequential modeling tasks, where it consistently improves performance. Further analysis shows that LLM-generated signals exhibit high semantic novelty and diversity, enhancing the representational capacity of the downstream models. This work represents a new data-centric paradigm where LLMs serve as intelligent context generators, contributing a new method for the semi-automatic creation of training data and language resources.