What Makes AI Research Replicable? Executable Knowledge Graphs as Scientific Knowledge Representations

作者: Yujie Luo, Zhuoyun Yu, Xuehai Wang, Yuqi Zhu, Ningyu Zhang, Lanning Wei, Lun Du, Da Zheng, Huajun Chen

分类: cs.CL, cs.AI, cs.LG, cs.MA, cs.SE

发布日期: 2025-10-20 (更新: 2026-01-21)

备注: Work in progress

🔗 代码/项目: GITHUB

💡 一句话要点

提出Executable Knowledge Graphs (xKG),提升AI研究的可复现性。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 可复现性 知识图谱 大型语言模型 代码生成 AI研究

📋 核心要点

- 现有AI研究复现方法难以生成可执行代码,缺乏足够的背景知识和对代码实现细节的有效利用。

- 论文提出Executable Knowledge Graphs (xKG),通过集成论文中的代码片段和技术细节,构建可执行的知识表示。

- 实验表明,xKG能够显著提升LLM智能体在PaperBench上的性能,验证了其在AI研究复现方面的有效性。

📝 摘要(中文)

AI研究的可复现性对于大型语言模型(LLM)智能体来说至关重要,但同时也极具挑战。现有方法通常难以生成可执行代码,这主要是由于背景知识不足以及检索增强生成(RAG)方法的局限性,RAG方法无法捕捉到参考文献中隐藏的潜在技术细节。此外,先前的方法倾向于忽略有价值的实现级代码信号,并且缺乏支持多粒度检索和重用的结构化知识表示。为了克服这些挑战,我们提出了Executable Knowledge Graphs (xKG),这是一个可插拔的、以论文为中心的知识库,可以自动集成从科学文献中提取的代码片段和技术见解。当与两个不同LLM的三个智能体框架集成时,xKG在PaperBench上显示出显著的性能提升(使用o3-mini提升10.9%),证明了其作为自动化AI研究复制的通用且可扩展解决方案的有效性。代码可在https://github.com/zjunlp/xKG获取。

🔬 方法详解

问题定义:现有AI研究复现方法,尤其是基于LLM的智能体,在生成可执行代码方面面临挑战。主要痛点在于:一是背景知识不足,LLM难以理解论文中隐含的技术细节;二是检索增强生成(RAG)方法无法有效提取和利用这些细节;三是缺乏对实现级代码信号的有效利用和结构化知识表示,导致难以进行多粒度检索和重用。

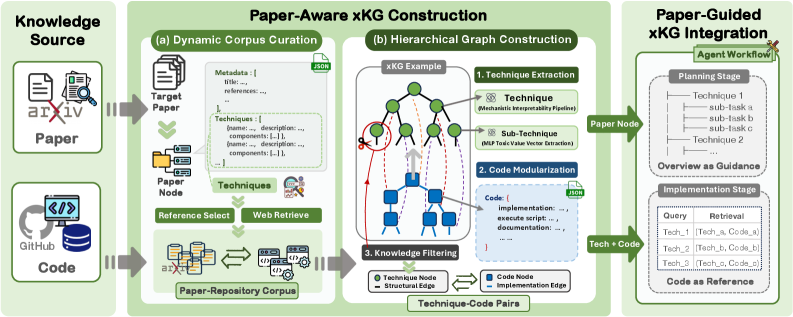

核心思路:论文的核心思路是构建一个Executable Knowledge Graph (xKG),将论文中的代码片段和技术见解进行结构化表示,形成一个可执行的知识库。通过将xKG集成到LLM智能体中,可以增强其背景知识,提高代码生成能力,从而提升AI研究的可复现性。

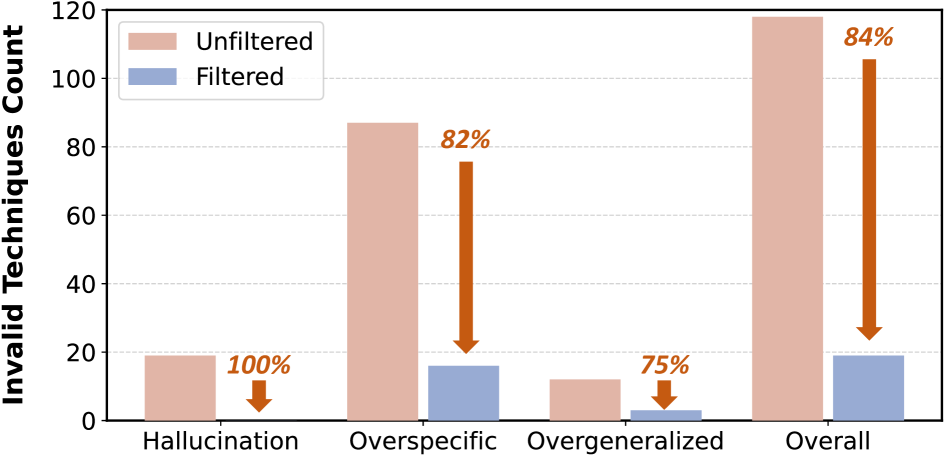

技术框架:xKG的构建流程包括:1) 从科学文献中提取代码片段和技术见解;2) 将提取的信息进行结构化表示,构建知识图谱;3) 将知识图谱集成到LLM智能体中,作为其外部知识来源。智能体在进行代码生成时,可以从xKG中检索相关知识,并将其融入到生成的代码中。

关键创新:xKG的关键创新在于其可执行性。传统的知识图谱主要关注概念之间的关系,而xKG则关注代码片段和技术细节,并将其与论文中的相关信息进行关联,从而形成一个可执行的知识库。这种可执行性使得LLM智能体能够更好地理解和利用论文中的知识,从而提高代码生成能力。

关键设计:xKG的设计包括:1) 代码片段的提取方法,需要能够准确地识别和提取论文中的代码片段;2) 知识图谱的构建方法,需要能够有效地表示代码片段和技术细节之间的关系;3) 知识检索方法,需要能够快速地检索到与当前任务相关的知识。论文中没有明确给出这些方法的具体技术细节,属于未知信息。

🖼️ 关键图片

📊 实验亮点

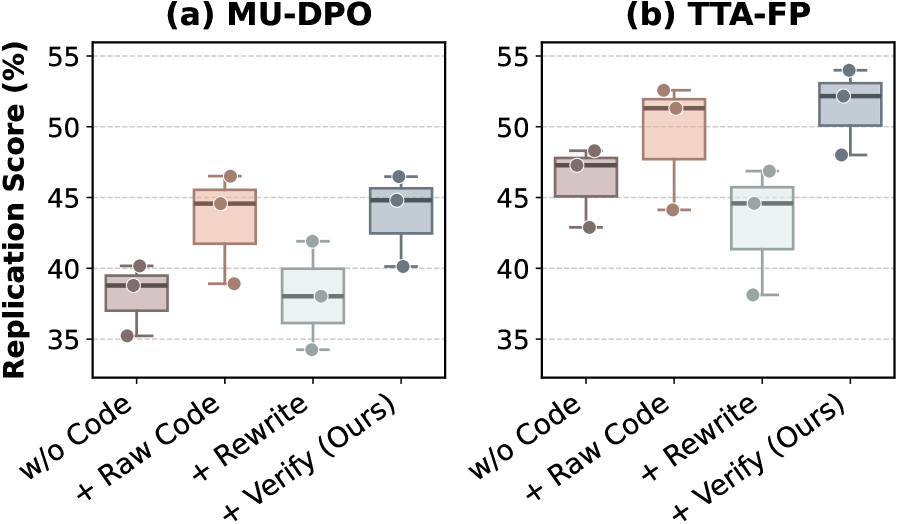

实验结果表明,将xKG集成到LLM智能体中,能够在PaperBench数据集上获得显著的性能提升。具体来说,使用o3-mini模型时,性能提升了10.9%。这表明xKG能够有效地增强LLM智能体的背景知识,提高代码生成能力,从而提升AI研究的可复现性。

🎯 应用场景

该研究成果可应用于自动化AI研究、代码生成、知识发现等领域。通过构建可执行的知识图谱,可以帮助研究人员更好地理解和复现已有的研究成果,加速AI技术的创新和发展。此外,xKG还可以作为LLM智能体的外部知识来源,提升其在特定领域的应用能力。

📄 摘要(原文)

Replicating AI research is a crucial yet challenging task for large language model (LLM) agents. Existing approaches often struggle to generate executable code, primarily due to insufficient background knowledge and the limitations of retrieval-augmented generation (RAG) methods, which fail to capture latent technical details hidden in referenced papers. Furthermore, previous approaches tend to overlook valuable implementation-level code signals and lack structured knowledge representations that support multi-granular retrieval and reuse. To overcome these challenges, we propose Executable Knowledge Graphs (xKG), a pluggable, paper-centric knowledge base that automatically integrates code snippets and technical insights extracted from scientific literature. When integrated into three agent frameworks with two different LLMs, xKG shows substantial performance gains (10.9% with o3-mini) on PaperBench, demonstrating its effectiveness as a general and extensible solution for automated AI research replication. Code is available at https://github.com/zjunlp/xKG.