EduAdapt: A Question Answer Benchmark Dataset for Evaluating Grade-Level Adaptability in LLMs

作者: Numaan Naeem, Abdellah El Mekki, Muhammad Abdul-Mageed

分类: cs.CL, cs.AI

发布日期: 2025-10-20

备注: 28 pages, 2 figures, 14 tables, 50 listings, EMNLP 2025 Main

🔗 代码/项目: GITHUB

💡 一句话要点

EduAdapt:构建用于评估LLM年级适应性的问答基准数据集

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 教育AI 年级适应性 问答数据集 基准测试

📋 核心要点

- 现有大型语言模型在教育领域应用广泛,但缺乏针对不同年级学生认知水平进行调整的能力,导致输出内容不适合低年级学生。

- EduAdapt通过构建包含近48k个年级标签问答对的数据集,涵盖九个科学学科,为评估LLM的年级适应性提供基准。

- 实验结果表明,现有LLM在处理低年级学生的提问时表现不佳,表明需要进一步优化模型以适应不同年级学生的学习需求。

📝 摘要(中文)

大型语言模型(LLM)正在通过回答问题、解释复杂概念和生成各种学科的内容来改变教育。尽管在学术基准测试中表现出色,但它们常常无法根据学生的年级水平调整答案。这在K-12教育中至关重要,因为适合年龄的词汇和解释对于有效的学习至关重要。现有模型经常产生对于年幼学习者来说过于高级或模糊的输出,并且没有标准化的基准来评估它们在认知和发展阶段进行调整的能力。为了解决这个差距,我们引入了EduAdapt,这是一个包含近48k个年级标记的QA对的基准,涵盖九个科学学科,跨越1-12年级,并分为四个年级水平。我们在EduAdapt上评估了一组不同的开源LLM,发现虽然较大的模型通常表现更好,但它们仍然难以生成适合早期年级学生(1-5年级)的答案。我们的工作提出了第一个数据集和评估框架,用于评估LLM中的年级适应性,旨在通过更好的训练和提示策略来促进更符合发展水平的教育AI系统。EduAdapt代码和数据集可在https://github.com/NaumanNaeem/EduAdapt公开获取。

🔬 方法详解

问题定义:论文旨在解决大型语言模型(LLM)在教育领域应用时,无法根据学生的年级水平调整回答内容的问题。现有LLM虽然在通用学术基准上表现良好,但对于低年级学生,其输出常常过于复杂或模糊,缺乏针对性。缺乏标准化的基准数据集来评估LLM的年级适应性,阻碍了相关研究的进展。

核心思路:论文的核心思路是构建一个大规模的、带有年级标签的问答数据集EduAdapt,用于评估LLM在不同年级水平上的表现。通过在EduAdapt上评估LLM,可以量化模型在年级适应性方面的能力,并为后续的模型优化提供指导。数据集的构建考虑了不同年级学生的认知发展水平,确保问题和答案的难度与年级相匹配。

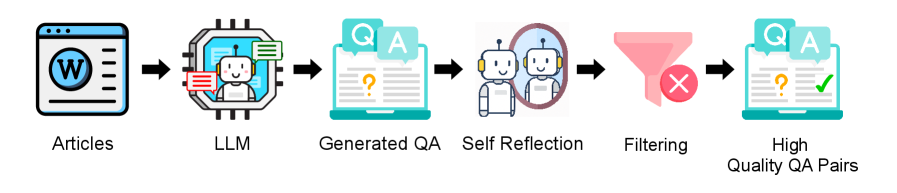

技术框架:EduAdapt数据集包含近48k个问答对,涵盖九个科学学科,跨越1-12年级,并被划分为四个年级水平(1-3年级、4-5年级、6-8年级、9-12年级)。数据集的构建过程包括问题收集、答案生成和年级标签标注。论文使用EduAdapt数据集评估了一系列开源LLM,并分析了模型在不同年级水平上的表现。

关键创新:EduAdapt是第一个专门用于评估LLM年级适应性的基准数据集。它填补了现有教育AI研究中缺乏针对不同年级学生认知水平进行评估的空白。该数据集的构建方法和评估框架为开发更符合发展水平的教育AI系统提供了新的思路。

关键设计:EduAdapt数据集的构建过程中,问题和答案的难度与年级水平相匹配。数据集涵盖了九个科学学科,保证了评估的全面性。论文使用了一系列开源LLM进行评估,包括不同大小和架构的模型,以评估模型规模和架构对年级适应性的影响。评估指标包括准确率和流畅度等,以全面评估模型的表现。

🖼️ 关键图片

📊 实验亮点

在EduAdapt数据集上的实验结果表明,虽然较大的LLM通常表现更好,但它们仍然难以生成适合早期年级学生(1-5年级)的答案。这表明现有LLM在年级适应性方面存在不足,需要进一步优化。EduAdapt数据集为评估和改进LLM的年级适应性提供了有效的工具。

🎯 应用场景

EduAdapt数据集可用于训练和评估针对不同年级学生的个性化教育AI系统。它可以帮助开发能够根据学生年级水平调整回答内容、解释复杂概念和生成学习材料的LLM。该研究成果有望提升在线教育、智能辅导和教育游戏等领域的应用效果,促进教育公平。

📄 摘要(原文)

Large language models (LLMs) are transforming education by answering questions, explaining complex concepts, and generating content across a wide range of subjects. Despite strong performance on academic benchmarks, they often fail to tailor responses to students' grade levels. This is a critical need in K-12 education, where age-appropriate vocabulary and explanation are essential for effective learning. Existing models frequently produce outputs that are too advanced or vague for younger learners, and there are no standardized benchmarks to evaluate their ability to adjust across cognitive and developmental stages. To address this gap, we introduce EduAdapt, a benchmark of nearly 48k grade-labeled QA pairs across nine science subjects, spanning Grades 1-12 and grouped into four grade levels. We evaluate a diverse set of open-source LLMs on EduAdapt and find that while larger models generally perform better, they still struggle with generating suitable responses for early-grade students (Grades 1-5). Our work presents the first dataset and evaluation framework for assessing grade-level adaptability in LLMs, aiming to foster more developmentally aligned educational AI systems through better training and prompting strategies. EduAdapt code and datasets are publicly available at https://github.com/NaumanNaeem/EduAdapt.